Deepak Bhaskar Acharya; Karthigeyan Kuppan; B. Divya

Departamento de Ingeniería Electrónica y de Comunicaciones, Instituto Tecnológico de Manipal, Academia de Educación Superior de Manipal, Manipal, Karnataka, India

Abstracto:

La IA Agentic, un paradigma emergente en inteligencia artificial, se refiere a sistemas autónomos diseñados para alcanzar objetivos complejos con mínima intervención humana. A diferencia de la IA tradicional, que depende de instrucciones estructuradas y una supervisión rigurosa, la IA Agentic demuestra adaptabilidad, capacidad avanzada para la toma de decisiones y autosuficiencia, lo que le permite operar dinámicamente en entornos cambiantes. Este estudio explora a fondo los conceptos fundamentales, las características únicas y las metodologías clave que impulsan el desarrollo de la IA Agentic. Examinamos sus aplicaciones actuales y potenciales en diversos campos, como la salud, las finanzas y los sistemas de software adaptativos, destacando las ventajas de implementar sistemas Agentic en escenarios reales. El artículo también aborda los desafíos éticos que plantea la IA Agentic, proponiendo soluciones para la alineación de objetivos, la limitación de recursos y la adaptabilidad al entorno. Describimos un marco para integrar la IA Agentic en la sociedad de forma segura y eficaz, destacando la necesidad de seguir investigando sobre consideraciones éticas para garantizar un impacto social positivo. Este estudio sirve como una introducción completa a la IA Agentic, guiando a investigadores, desarrolladores y legisladores para que aprovechen su potencial transformador de forma responsable y creativa.

Fundamentos técnicos de la IA agente, que ilustran los componentes clave: aprendizaje de refuerzo, arquitecturas orientadas a objetivos y mecanismos de control adaptativo.

Introducción

A. Motivación y antecedentes

Las IAs agénticas representan un avance cualitativo en el desarrollo de la inteligencia artificial, definidas por su capacidad para establecer objetivos complejos en situaciones cambiantes e incontroladas y alcanzarlos mediante la gestión autónoma de sus recursos. Sin embargo, la mayoría de los sistemas de IA se diseñaron y operaron como herramientas bajo supervisión, con restricciones y definiciones establecidas. Estos sistemas son eficaces para realizar tareas bien definidas dentro de ciertos límites, pero fallan notablemente cuando las tareas intentadas carecen de un estado final o parámetros específicos que manipular. Por otro lado, las IAs agénticas pueden ser operativas de bajo nivel, es decir, dirigidas a objetivos, incluso en situaciones con cambios drásticos y múltiples objetivos entre los que alternar.

Uno de los factores que motivó el diseño de las IA Agentic es la necesidad de herramientas diseñadas para operar en condiciones reales, aunque complejas, con un amplio margen de flexibilidad. Por ejemplo, en la ayuda ante desastres, la atención médica y la ciberseguridad, donde se requieren decisiones adecuadas y el caos es considerable, la capacidad de controlar una situación de forma independiente es crucial. Las IA Agentic no solo asisten en la acción humana, sino que la mejoran al asumir tareas que exigen una alta participación y multitarea sin intervención humana constante. Este cambio de paradigma promete ampliar el ámbito objetivo de la IA, pasando de ser pasiva y reactiva a centrarse en la planificación estratégica, el procesamiento de la información y la resolución de problemas, lo que posibilita una nueva era una vez que se cumplan las condiciones adecuadas.

El impacto de la IA Agentica [1] , [2] , [3] en la sociedad probablemente será considerable. A medida que la IA se integre en cada vez más sistemas e industrias clave, los sistemas de IA Agentica podrán trabajar en conjunto con los humanos y asumir tareas que permitan reasignar el esfuerzo humano, aumentar la productividad y participar en situaciones donde la presencia humana pueda ser indeseable o peligrosa. Este cambio podría transformar las estructuras laborales en los sectores, permitiendo un trabajo en conjunto donde las IA realizan tareas operativas y las personas desempeñan roles más complejos y estratégicos.

B. Definición y alcance

En este sentido, la IA Agentic incluye la clase de sistemas de IA autónomos [4] que se encargan de completar un conjunto de tareas complejas que se extienden a lo largo de largos periodos de tiempo sin supervisión humana. Aprende del contexto y toma decisiones. Dichos sistemas están diseñados para operar con cierto nivel de autonomía, lo que les permite adaptarse a entornos cambiantes, afrontar situaciones inesperadas y optimizar el rendimiento a lo largo del tiempo. Unidas por las características de autonomía y adaptabilidad para afrontar procesos orientados a tareas, están las características de autonomía y adaptabilidad. A diferencia de la IA clásica [5] , que se basa en reglas y requiere la ejecución de instrucciones, y la IA generativa, que modela y genera una imagen, la IA Agentic ofrece lo mejor de ambos mundos.

Resulta valioso comparar la IA agencial con los paradigmas actuales de IA para poner en perspectiva sus límites. Por ejemplo, la IA clásica nunca se centró en el reconocimiento de imágenes ni en la traducción de idiomas [6] , [7], sino que buscaba alcanzar objetivos muy específicos.

El primero es el funcionamiento de la IA Generativa [8] . En operaciones inversas, combina información obtenida mediante números y crea contenido, como palabras o imágenes. Por otro lado, la IA Agentic supera a los dos enfoques anteriores gracias a sus características orientadas a objetivos, basadas en entradas y adaptables, que le permiten realizar tareas complejas y de múltiples niveles en un periodo de tiempo sin necesidad de un conjunto de instrucciones cada vez.

En este punto del estudio, nos centramos en por qué debería interesarnos la IA Agentic. A partir de sus características estructurales y operativas, ¿por qué se basa en objetivos? ¿Cómo puede este tipo avanzado de IA aplicarse en diversos campos donde su aplicación es única? Además, este artículo también analiza las diversas cuestiones prácticas y morales que surgen del uso de sistemas basados en dicha IA y analiza enfoques que abordan la seguridad, la transparencia y la rendición de cuentas. La definición de IA Agentic proporcionada permite a los autores de este estudio analizar con precisión qué características de este tipo de sistema de IA lo distinguen de otros y facilitan su análisis eficaz e integrado.

C. Objetivos y contribuciones

Este estudio busca proporcionar una amplia recopilación de conocimientos sobre IA Agentic y definir sus límites para facilitar su comprensión por parte de un público más amplio de investigadores, desarrolladores y legisladores. Las principales contribuciones de este estudio incluyen:

- Una revisión sistemática de los principales elementos que componen los sistemas de IA Agentic con énfasis en cómo estos sistemas se diferencian de otros sistemas de IA generativos y de sentido común.

- Un estudio exhaustivo de las técnicas y conceptos utilizados en la construcción y evaluación de la IA Agentic, incluidas las arquitecturas, los enfoques de aprendizaje y los métodos de entrenamiento.

- Los usos actuales y potenciales en diferentes áreas, incluidos ejemplos prácticos de la eficacia de las aplicaciones de IA Agentic en la práctica.

- Destacando los problemas de ingeniería, pero no limitados a ellos: diseño y convergencia de objetivos, adaptación al contexto y recursos limitados.

- A considera las cuestiones éticas, sociales y regulatorias con la adopción de Agentic AI, incluidas las preocupaciones relevantes de responsabilidad, equidad y transparencia.

- Recomendaciones para futuras investigaciones, presentando sugerencias sobre cómo integrar mejor las cuestiones de escala, contexto y ética en la implementación de la IA Agentic.

Las contribuciones esperadas de este artículo van más allá de una simple revisión bibliográfica; más bien, deben ofrecer una base útil y bien organizada para desarrollar los problemas y los detalles de la IA Agentic. Este artículo busca proporcionar información importante sobre la gestión de prácticas operativas y soluciones tecnológicas que promuevan y sustenten el desarrollo de sistemas éticos de IA Agentic.

D. Organización del estudio

El resto de este documento está organizado de la siguiente manera:

- Sección II Introduce los conceptos y definiciones básicas que ayudan a entender la IA Agentic como una entidad específica en el contexto más amplio de la inteligencia artificial.

- Sección III Trata la estructura típica de la IA Agentic, incluyendo la independencia, la flexibilidad y la capacidad de elegir qué hacer.

- Sección IV Identifica y describe los métodos de construcción de IA Agentic: los diseños estructurales, los tipos de aprendizaje y las formas de evaluación y medidas de eficiencia.

- Sección V Analiza diferentes sectores en los que la IA agentiva ha encontrado aplicaciones, centrándose en aplicaciones en industrias y casos de trabajo conjunto con humanos.

- Sección VI Presenta un análisis comparativo de varios sistemas que ejemplifican la IA Agentic con un enfoque en las diferentes medidas de desempeño e indicadores empleados en la evaluación de estos sistemas.

- Sección VII Explica los aspectos técnicos y las dificultades de la IA Agentic sobre el establecimiento de objetivos y los aspectos de interacción con el entorno.

- Sección VIII Plantea las cuestiones sociales, éticas y de gobernanza, en lo que respecta a la responsabilidad, la equidad y el cumplimiento de la ley.

- Sección IX Analiza los sistemas existentes que facilitan la implementación constructiva y responsable de la IA Agentic, incluidos los componentes de supervisión y regulación.

- Sección X Describe las lagunas en el conocimiento y el trabajo prospectivo de Investigación y Desarrollo junto con la consideración de ideas refrescantes de IA Agentic.

- La Sección XI recomienda las observaciones finales del artículo, incluyendo una conclusión de los hallazgos y una observación de que se necesitan conexiones interdisciplinarias para hacer avanzar el campo de manera responsable.

Esta encuesta exhaustiva proporcionará información valiosa sobre el estado actual de Agentic AI, su potencial futuro y los desafíos que deben abordarse para garantizar su implementación segura y efectiva.SECCIÓN II.

Conceptos y definiciones fundamentales

A. IA agente y su papel en el ecosistema de IA

Dentro del campo de la IA, la IA Agentic sirve como una forma diferente de inteligencia que puede adoptar comportamientos agenticos de funcionamiento más autónomo que no se limitan a realizar tareas específicas o seguir algoritmos de generación de contenido. Cuando se ve en un contexto de ecosistema, la IA Agentic destaca por su propósito, flexibilidad y comportamiento, lo que permite a estas IA operar casi de forma independiente. En lugar de seguir directrices estrictas como otras IA robóticas, los sistemas de IA Agentic se promueven por tener racionalismo en ellos, lo que permite a cada sistema [9] razonar y adaptarse a diferentes escenarios y circunstancias de manera suficiente para lograr objetivos. Debido a su tendencia a mejorar sus funciones para prepararse para cualquier obstáculo, la IA Agentic se ha visto como un punto de anclaje potencial para tareas y objetivos que requieren altos niveles de interacción, por ejemplo, dispositivos autónomos, robots colaborativos y sistemas interactivos de apoyo a la toma de decisiones en las áreas de finanzas y atención médica.

La creciente demanda de sistemas capaces de gestionar de forma autónoma procesos complejos y dinámicos ha generado un creciente interés en la IA Agentic, especialmente en sectores con potencial para la automatización de la IA. Si bien se basa en principios básicos de IA, la IA Agentic amplía el alcance de sus logros al incorporar elementos de dependencia y acción independiente adaptativa. El ecosistema de la IA se sitúa entre las tecnologías de IA puramente reactivas y estrictamente basadas en reglas, y las ideas más amplias sobre la IAG, desempeñando una función esencial al permitir la toma de decisiones autónoma dentro de límites o estructuras definidos. Esta posición única acentúa la capacidad de la IA Agentic para adaptarse a escenarios donde la capacidad de tomar decisiones rápidas, gestionar objetivos a largo plazo y aprender sobre la marcha son fundamentales para el problema en cuestión.

B. Comparación con la IA tradicional

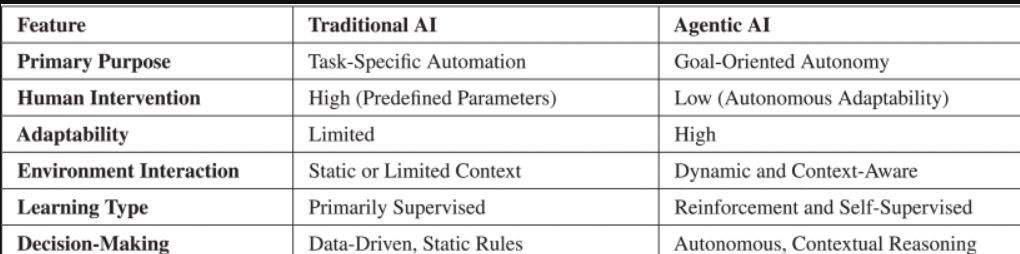

La IA, que puede describirse como «Agentic», presenta diferencias fundamentales con respecto a otros tipos avanzados de IA en términos de autonomía, función y alcance, entre otros. Dichos sistemas de IA se integran en tareas específicas como el análisis de imágenes [10] , la traducción de idiomas [11] y los motores de recomendación [12] , lo que les permite realizar tareas designadas de una manera muy específica, pero con un alcance limitado. Se basan principalmente en enfoques de aprendizaje supervisado sobre grandes conjuntos de datos, donde el comportamiento está determinado por la información y las instrucciones que reciben de las personas. Por lo tanto, las IA tradicionales se aplican mejor en entornos controlados con capacidad limitada para microgestionar situaciones y resultados mucho más significativos.

Por otro lado, los sistemas de IA Agentic pueden describirse como poseedores de la característica de final abierto donde no hay prescripción de cómo debe lograrse la tarea. Trabajan con y se adaptan a condiciones que cambian rápidamente. Por otro lado, mientras que los sistemas de IA convencionales pueden ser precisos, no tienen la conciencia situacional y la dinámica dirigida a objetivos inherentes a la IA Agentic. Un ejemplo de caso puede incluir el modelo de IA de una fábrica que se desarrolla para predecir fallas de equipo. Por mucho que la premisa sea buena, la IA no incorporará cambios adaptativos en la forma en que predice fallas debido a factores como cambios en el cronograma de fabricación o cambios en los patrones de desgaste en las máquinas. Por otro lado, la IA Agentic podría cambiar sus procesos de estimación de métricas dependiendo del contexto y adaptar sus estrategias tanto a corto como a largo plazo, lo cual es imposible con los modelos tradicionales.

Como se muestra en la Tabla 1 , los sistemas de IA Agentic no solo se adaptan al contexto en tiempo real, sino que también mantienen la flexibilidad para optimizar objetivos complejos a largo plazo. Estas distinciones ilustran el valor de la IA Agentic en escenarios donde la IA convencional, sujeta a reglas, resulta insuficiente, lo que enfatiza su papel transformador para abordar las demandas de entornos impredecibles y de alto riesgo.

TABLA 1 Comparación de la IA tradicional y la IA agencial

C. Comparación ampliada con agentes clásicos

Mientras que los sistemas de IA clásicos son principalmente modelos basados en reglas o de aprendizaje supervisado, diseñados para tareas específicas, la IA Agentic integra autonomía y adaptabilidad, lo que permite una funcionalidad más amplia. Las diferencias entre estos paradigmas se ilustran mejor con ejemplos.

1) Agentes clásicos

Estos agentes destacan en entornos controlados. Por ejemplo, los algoritmos de trading financiero basados en reglas funcionan eficazmente cuando los parámetros predefinidos se mantienen constantes. Sin embargo, presentan dificultades ante fluctuaciones del mercado o disrupciones impredecibles.

2) IA agente

Por el contrario, los sistemas comerciales impulsados por IA de Agentic ajustan dinámicamente las estrategias en función de datos en tiempo real, tendencias históricas y cambios inesperados del mercado, lo que los hace más resistentes y adaptables.

3) Aprendizaje por refuerzo versus agentes basados en modelos de lenguaje

Mientras que el aprendizaje por refuerzo se centra en optimizar las recompensas acumulativas en un entorno de tareas específico, los agentes basados en modelos de lenguaje amplían esta capacidad interpretando entradas complejas de lenguaje natural e interactuando con humanos sin problemas. Por ejemplo, un agente de aprendizaje por refuerzo destaca en la optimización de estrategias de juego, mientras que un agente basado en modelos de lenguaje puede generar diálogos, interpretar reglas y adaptar estrategias durante un juego en vivo. La Tabla 2 destaca las diferencias clave.

TABLA 2 Comparación de agentes clásicos, agentes de aprendizaje de refuerzo e IA agéntica

D. Fundamentos técnicos

El desarrollo de sistemas de IA Agentic se basa en algoritmos y marcos centrales que facilitan el comportamiento orientado a objetivos, la adaptación contextual y la toma de decisiones autónoma. Estos fundamentos técnicos incorporan avances en aprendizaje por refuerzo, arquitecturas orientadas a objetivos y mecanismos de control adaptativo.

El aprendizaje por refuerzo (AR) [13] es fundamental para muchos sistemas agénticos, ya que dota a los modelos de IA de la capacidad de aprender mediante ensayo y error. En el AR, los agentes se entrenan para maximizar las recompensas acumuladas al interactuar con un entorno y adaptar sus acciones para alcanzar objetivos específicos a lo largo del tiempo. Este paradigma de aprendizaje es particularmente útil para la IA agéntica, ya que permite a los sistemas refinar continuamente sus estrategias basándose en la retroalimentación. Como se ilustra en la Figura 1 , el aprendizaje por refuerzo promueve el aprendizaje mediante la interacción e implica un enfoque de ensayo y error para optimizar las decisiones a lo largo del tiempo.

Fundamentos técnicos de la IA agente, ilustrando componentes clave: aprendizaje de refuerzo, arquitecturas orientadas a objetivos y mecanismos de control adaptativo.

Las arquitecturas orientadas a objetivos [14] proporcionan un marco estructural para la gestión de objetivos complejos dentro de los sistemas de IA con agentes. A diferencia de las arquitecturas tradicionales, que suelen centrarse en tareas individuales, las arquitecturas orientadas a objetivos permiten a los agentes priorizar y perseguir múltiples objetivos simultáneamente. Estas arquitecturas admiten una estructura modular, donde los objetivos más amplios se dividen en subobjetivos manejables. En el contexto de la Figura 1 , las arquitecturas orientadas a objetivos facilitan la gestión de objetivos complejos, permitiendo a los agentes abordar las tareas en pasos estructurados.

Los mecanismos de control adaptativo [15] garantizan que los sistemas de IA agéntica se ajusten a entornos cambiantes. Al incorporar control adaptativo, los agentes recalibran sus parámetros en respuesta a variaciones externas, como cambios en los datos o interrupciones inesperadas. Técnicas como el metaaprendizaje, donde los agentes aprenden a adaptarse basándose en experiencias previas, permiten una mayor resiliencia y flexibilidad. Como se muestra en el diagrama de flujo, los mecanismos de control adaptativo proporcionan «adaptación al entorno», lo que permite a los agentes mantener un rendimiento óptimo incluso en condiciones cambiantes.

La Figura 1 ofrece una representación visual de estos marcos centrales, ilustrando cómo interactúan para permitir un comportamiento autónomo, adaptable y orientado a objetivos en los sistemas de IA Agentic. En conjunto, estos fundamentos técnicos dotan a la IA Agentic de las capacidades estructurales y funcionales necesarias para gestionar tareas complejas y en constante evolución de forma independiente, lo que la distingue de los sistemas de IA tradicionales que se basan en parámetros e instrucciones estrictamente definidos.

Al combinar el aprendizaje por refuerzo, las arquitecturas orientadas a objetivos y el control adaptativo, los sistemas de IA Agentic alcanzan un nivel de autonomía y resiliencia que les permite operar eficazmente en diversos entornos. Esta sección establece las bases técnicas para comprender las capacidades avanzadas de la IA Agentic, sentando las bases para las metodologías y aplicaciones que se describen en las siguientes secciones.SECCIÓN III.

Características principales de la IA agente

A. Autonomía y complejidad de objetivos

La autonomía es una de las cualidades más buscadas de la IA Agentic. Esto es especialmente necesario en escenarios complejos con múltiples objetivos. La mayoría de los sistemas de IA tradicionales se centran en completar una tarea y están programados con requisitos de entrada y salida sencillos para lograr ese único objetivo. En cambio, los sistemas impulsados por IA Agentic pueden realizar múltiples tareas necesarias y pasar de una tarea básica a múltiples objetivos finales complejos. Dichos sistemas poseen cierto grado de autogobierno, donde la supervisión continua de un ser humano no es obligatoria, aunque a veces se prefiere, y los agentes de IA funcionan de forma independiente según una estructura de objetivos predeterminada o en evolución. Sin embargo, es necesario reconocer un paso adicional: para la IA Agentic, la autonomía no se limita a la consecución de un único objetivo, sino que sustituye objetivos menores y estrategias individuales por objetivos más amplios a largo plazo. Un ejemplo se puede extraer de la robótica autónoma [16] , donde un sistema de inteligencia artificial (IA) de este tipo exigiría la travesía completa del punto A al punto B, con la posibilidad adicional de realizar desvíos en la ruta, modificando restricciones como la jerarquía de tareas, los plazos, las tasas de consumo de energía y los estándares de seguridad. Esta comprensión profundiza la comprensión de la complejidad de los objetivos, donde se utilizan modelos de decisión de alto nivel donde los objetivos guían el análisis, la planificación y la acción. Esto permite a los sistemas de IA de inteligencia artificial (IA) llevar a cabo objetivos complejos que se habían deconstruido en subtareas que podrían encajar de forma autónoma en una estrategia operativa, junto con ajustes.

B. Complejidad ambiental y operativa

Además, la capacidad de la IA Agentic para operar en circunstancias variadas y cambiantes es otra característica de esta IA. A diferencia de la IA anterior, diseñada para las funciones más óptimas en un entorno constante y fácilmente predecible [17] , las IA Agentic integran toda la variabilidad del mundo real. Esto implica adaptarse rápidamente a las condiciones ambientales, los cambios de datos o patrones, e incluso las demandas del usuario, ya sean antiguas o nuevas. En el caso de los agentes de IA para coches autónomos, el agente ideal no se ajustaría a Photoshop para cumplir únicamente con los límites artificiales contenidos en las leyes de tráfico, sino que aprendería nuevos diseños de carreteras e intentaría comprender cómo sería el comportamiento de otros conductores antes de decidir cómo actuar en una situación particular cuando surgiera la necesidad en un período muy corto.

Para ello, los sistemas de IA Agentic, por regla general, están equipados con medios para la interacción con el entorno, el procesamiento de datos in situ y la comprensión del contexto situacional. Estas capacidades permiten al sistema monitorizar y participar activamente en los parámetros operativos susceptibles de alteraciones, incluso en el último minuto. Por ejemplo, el control de cambios [18] en los sistemas de IA Agentic suele estar integrado en el agente como aprendizaje de refuerzo o algoritmos adaptativos, de modo que este pueda funcionar de forma óptima independientemente de las condiciones cambiantes. Estas características hacen que la IA Agentic sea idónea para entornos con múltiples dinámicas donde se requiere una reacción rápida, como en la gestión de desastres, la sanidad, las finanzas, etc.

C. Toma de decisiones independiente y adaptabilidad

La autonomía y la flexibilidad son requisitos fundamentales para que la IA Agentic trabaje de forma independiente durante largas jornadas. A diferencia de los sistemas basados en reglas, que simplemente obedecen las órdenes, la IA Agentic debe adaptarse a su contexto actual y tomar decisiones sobre la marcha, por lo que debe aprender con el tiempo y mejorar su comportamiento. Este tipo de toma de decisiones se realiza habitualmente mediante aprendizaje por refuerzo o metaaprendizaje, cuando el agente de IA recibe retroalimentación repetida y mejora su comportamiento.

La flexibilidad permite a la IA Agentic actuar de forma diferente en el mismo escenario y alcanzar los objetivos pertinentes. Por ejemplo, en una situación de atención al cliente, una IA Agentic podría adaptar sus estrategias de comunicación a las que mejor se adapten al estado de ánimo de los clientes para lograr su satisfacción. Esto requiere priorizar objetivos y evaluar posibles líneas de acción y sus resultados con respecto a los objetivos del sistema. Gracias a la flexibilidad y autonomía en la toma de decisiones [19] , la IA Agentic puede reconceptualizar sus estrategias y adaptarse a la nueva información adoptada en el modelo para operar en un entorno cambiante.

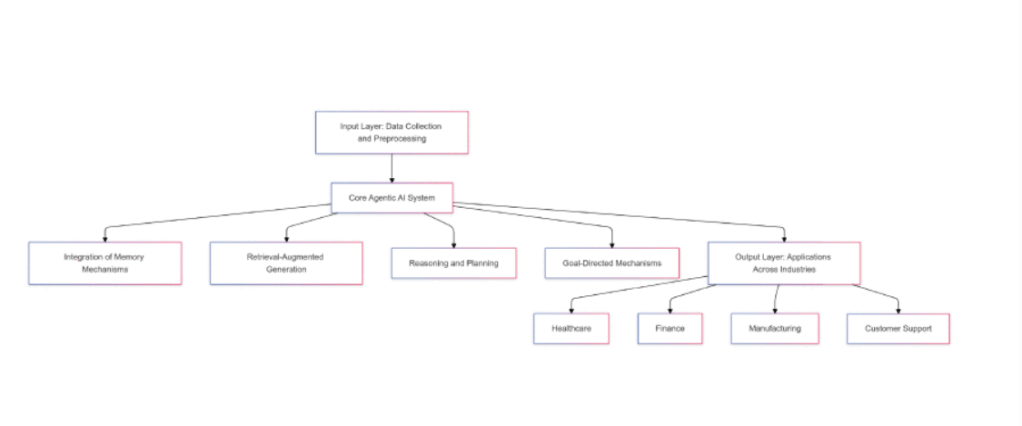

Para ilustrar mejor el proceso de integración de la IA Agentic en la sociedad, la Figura 2 describe las etapas clave. Esto incluye la recopilación y el preprocesamiento de datos, la funcionalidad principal del sistema de IA Agentic y su implementación en diversos sectores, como la salud, las finanzas, la manufactura y la atención al cliente. El diagrama de flujo representa visualmente la adaptabilidad e independencia de la IA Agentic en entornos dinámicos.

FIGURA 2.

Proceso de integración de la IA agencial en la sociedad.

D. Análisis comparativo

En comparación con los sistemas lineales de regulación, la IA Agentic destaca por su mayor capacidad para mantener su autonomía, funcionar en un contexto en constante cambio y afrontar múltiples objetivos. En la mayoría de los casos, los agentes operativos se crean donde el área funcional se define dentro de límites rígidos, con prerrequisitos infalibles y sencillos para un rendimiento exitoso. Por otro lado, los sistemas de IA Agentic están diseñados para trabajar con objetivos complejos que aún no se han estructurado y pueden definirse en un contexto amplio.

Como se muestra en la Tabla 3 , los agentes tradicionales destacan en tareas estructuradas, pero carecen de la flexibilidad necesaria para tareas adaptativas y orientadas a objetivos en entornos complejos. La IA Agentic mejora estos sistemas al introducir un alto grado de autonomía y adaptabilidad, lo que permite al agente interactuar con su entorno y responder a él de maneras que van más allá del simple seguimiento de reglas. Este análisis comparativo destaca las capacidades distintivas de la IA Agentic, posicionándola como un enfoque transformador en ámbitos donde el comportamiento independiente, orientado a objetivos y consciente del contexto es esencial.

Metodologías en el desarrollo de IA agente

A. Enfoques arquitectónicos

Los enfoques arquitectónicos en IA Agentica suelen implicar diseños modulares y jerárquicos que permiten al sistema gestionar objetivos complejos y adaptarse a entornos dinámicos. Las arquitecturas comunes incluyen sistemas multiagente (SAM), aprendizaje de refuerzo jerárquico (ARJ) y arquitecturas modulares orientadas a objetivos.

- Sistemas Multiagente (MAS) : Los MAS [20] dividen las tareas entre múltiples agentes autónomos que colaboran o compiten para lograr un objetivo común. Esta arquitectura es especialmente útil en escenarios donde los objetivos complejos pueden descomponerse en tareas más pequeñas que cada agente puede gestionar.

- Aprendizaje por Refuerzo Jerárquico (HRL) : El HRL [21] estructura la toma de decisiones jerárquicamente, donde los agentes de alto nivel definen subobjetivos y los agentes de bajo nivel los ejecutan. Este enfoque es eficaz para gestionar tareas con múltiples niveles de complejidad.

- Arquitecturas modulares orientadas a objetivos : Estas arquitecturas [22] organizan las funciones del agente en componentes modulares, donde cada módulo se especializa en aspectos específicos de la tarea. Esta modularidad proporciona flexibilidad y escalabilidad, permitiendo al agente gestionar diferentes tareas reconfigurando los módulos según sea necesario.

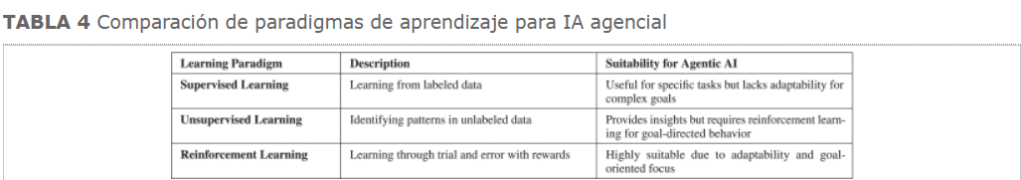

B. Paradigmas de aprendizaje

La IA agéntica se basa en varios paradigmas de aprendizaje, cada uno adaptado a diferentes tipos de tareas y objetivos. Los principales paradigmas utilizados en los sistemas agénticos son el aprendizaje supervisado, el no supervisado y el aprendizaje por refuerzo. La Tabla 4 ofrece una comparación.

TABLA 4 Comparación de paradigmas de aprendizaje para IA agencial

C. Avances en las metodologías

Los avances recientes en las metodologías de IA Agentic se han centrado en capacidades clave esenciales para el diseño de agentes modernos. Estas incluyen el razonamiento y la planificación, el uso de herramientas, los mecanismos de memoria, la Generación Aumentada por Recuperación (RAG) y el ajuste fino de instrucciones [23] .

1) Razonamiento y planificación

Estos marcos permiten a los agentes anticipar resultados, priorizar tareas y adaptar estrategias dinámicamente. Son fundamentales para gestionar tareas complejas con múltiples objetivos en entornos en constante evolución, como la gestión de desastres y la navegación autónoma.

2) Uso e integración de herramientas

Los agentes equipados con la capacidad de interactuar con herramientas externas y API pueden realizar cálculos, recuperar datos en tiempo real y simular escenarios, mejorando significativamente los procesos de toma de decisiones.

3) Mecanismos de memoria

Los modelos de memoria episódica y semántica permiten que los sistemas de IA Agentic retengan información contextual, mejorando su capacidad para recordar interacciones pasadas y optimizar las tareas en curso.

4) Generación aumentada por recuperación (RAG)

RAG permite a los agentes recuperar conocimiento externo de forma dinámica, mejorando la relevancia y el contexto de sus resultados. Esta capacidad es especialmente significativa en agentes conversacionales y sistemas de toma de decisiones en tiempo real.

5) Ajuste fino de instrucciones

Este proceso garantiza que los agentes comprendan y ejecuten directivas matizadas, lo que les permite realizar tareas de varios pasos con alta precisión y adaptabilidad.

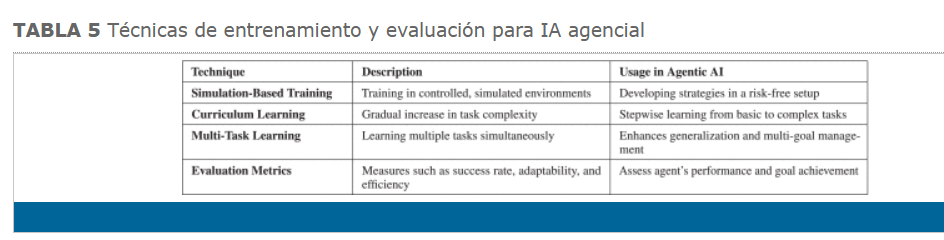

D. Técnicas de capacitación y evaluación

El entrenamiento de sistemas de IA con agentes requiere técnicas que permitan a los agentes aprender de las interacciones con entornos complejos. Entre las técnicas de entrenamiento más comunes se incluyen la formación basada en simulación, el aprendizaje curricular y el aprendizaje multitarea.

- Entrenamiento basado en simulación : Las simulaciones brindan a los estudiantes un contexto seguro para investigar numerosas situaciones sin consecuencias reales [24] . Esto es muy eficaz en el aprendizaje por refuerzo [25], ya que permite a los agentes diseñar políticas transferibles a la tarea real.

- Aprendizaje curricular : Estructurar las tareas en orden creciente de complejidad para que el agente desarrolle habilidades básicas que puedan desarrollarse en nuevas tareas más complejas [26] . Esta estructura de tareas progresivamente más complejas es fundamental en un entorno orientado a múltiples objetivos.

- Aprendizaje multitarea : En el aprendizaje multitarea [27] , los agentes adquieren la capacidad de realizar varias tareas simultáneamente, lo que amplía su capacidad de generalización a múltiples objetivos, tareas y escenarios. El problema es de suma importancia en el diseño de sistemas de IA agénticos que aborden múltiples objetivos en paralelo.

Las técnicas de evaluación de la IA Agentic suelen incluir métricas como la tasa de éxito de las tareas, la adaptabilidad, la eficiencia de los recursos y el logro de objetivos a largo plazo. La Tabla 5 ofrece una descripción general de estas técnicas de entrenamiento y evaluación.

TABLA 5 Técnicas de entrenamiento y evaluación para IA agencial

E. Herramientas y marcos

El desarrollo de IA Agentic requiere herramientas y marcos especializados que admitan el aprendizaje por refuerzo, la simulación y el desarrollo de sistemas multiagente. Herramientas como OpenAI Gym, Unity ML-Agents, TensorFlow Agents y Rasa ofrecen plataformas para desarrollar, entrenar y evaluar sistemas de IA Agentic en diversas aplicaciones. Cada herramienta ofrece capacidades únicas, desde entornos de aprendizaje por refuerzo hasta simulaciones multiagente, lo que permite a investigadores y desarrolladores experimentar con diferentes arquitecturas y técnicas de entrenamiento. La Figura 3 presenta un resumen de las herramientas y marcos más populares de las diferentes metodologías de desarrollo de IA Agentic , que se emplean en el desarrollo y la mejora de estos sistemas de IA autónomos que pueden contribuir al logro de objetivos de alto nivel. Los enfoques se resumen en cuatro categorías:

- Enfoques Arquitectónicos : Esta rama se ocupa de las diferentes arquitecturas que utilizan los agentes autónomos para lograr sus objetivos. Entre los métodos clave se encuentran los Sistemas Multiagente , que consisten en agentes que trabajan en colaboración y competencia entre sí; el Aprendizaje por Refuerzo Jerárquico , que se centra en jerarquizar las tareas para facilitar el proceso de aprendizaje; y las Arquitecturas Modulares Orientadas a Objetivos , que implican la configuración del sistema según la especificación de un objetivo o módulo.

- Paradigmas de Aprendizaje : Esta sección se centra en el estudio de agentes autónomos derivados de diferentes fuentes de aprendizaje automático. Estos incluyen el Aprendizaje Supervisado , basado en el uso de datos etiquetados; el Aprendizaje No Supervisado , en el que el modelo busca relaciones en datos no etiquetados; y el Aprendizaje por Refuerzo , basado en prueba y error, donde el agente se entrena para tomar decisiones temporales.

- Técnicas de Entrenamiento y Evaluación : En este caso, el enfoque se centra en métodos diseñados para el entrenamiento y la evaluación del rendimiento de la IA agéntica. Estas técnicas incluyen el Entrenamiento Basado en Simulación , que permite entrenar a varios agentes en entornos controlados; el Aprendizaje Curricular, en el que los agentes pueden realizar una serie de tareas sencillas y posteriormente otras más complejas; y el Aprendizaje Multitarea , que permite a los agentes realizar varias tareas simultáneamente. El entrenamiento o la evaluación de agentes en el entorno simulado se realiza mediante OpenAI Gym [28] y Unity ML-Agents [29] .

- Herramientas y marcos computacionales : La última subsección describe más herramientas o marcos computacionales relevantes para el proceso de desarrollo de sistemas de IA autónomos. Herramientas como los algoritmos de aprendizaje por refuerzo (RL) pueden implementarse utilizando TensorFlow Agents , PyMARL (una biblioteca de RL multiagente) y Rasa [30] (un marco para agentes conversacionales).

FIGURA 3.

Descripción general de las metodologías de desarrollo de IA agente, incluidos enfoques arquitectónicos, paradigmas de aprendizaje, técnicas de entrenamiento y herramientas.

El desglose estructural descrito en los párrafos anteriores describe la gama de metodologías y herramientas que se pueden utilizar para crear sistemas de IA agentes y cómo también pueden mejorar la adaptabilidad, la eficiencia y la funcionalidad de los sistemas autónomos en entornos complejos.

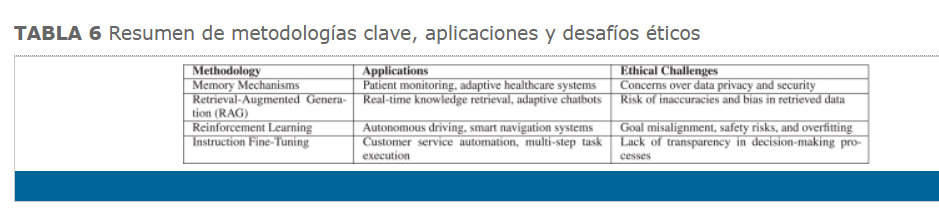

Las metodologías analizadas en esta sección abarcan diversas aplicaciones y consideraciones éticas. La Tabla 6 resume las metodologías clave en IA Agentic, sus aplicaciones prácticas en diferentes ámbitos y los desafíos éticos asociados. Este resumen proporciona una referencia concisa para comprender las técnicas fundamentales que impulsan el desarrollo de la IA Agentic.

TABLA 6 Resumen de metodologías clave, aplicaciones y desafíos éticos

Aplicaciones de la IA Agentic

A. Aplicaciones industriales

La IA Agentic puede revolucionar potencialmente múltiples industrias, como la salud, las finanzas, la educación y la manufactura. En el ámbito de la salud, por ejemplo, la IA Agentic puede utilizarse para analizar los datos entrantes de los pacientes, identificar patrones anormales y alertar al personal médico correspondiente sobre posibles daños. Los dispositivos basados en IA podrían, por ejemplo, prevenir el retraso en diagnósticos vitales al monitorizar los indicadores clave de salud de los pacientes y notificarles cuando la situación empeore. En el ámbito financiero, por ejemplo, los algoritmos de IA Agentic pueden ayudar a realizar transacciones de inversión, detectar actividades fraudulentas y ofrecer soluciones de inversión a medida. Son capaces de evaluar la situación en la bolsa, tomar decisiones independientes sobre la compra o venta de valores y ajustar sus estrategias a las condiciones cambiantes en tiempo real, lo que mejora significativamente la calidad del desempeño gerencial y reduce la participación humana [1] .

En el ámbito educativo, los sistemas de tutoría inteligente que utilizan la tecnología de IA Agentic ayudan a los estudiantes a adaptar el contenido educativo [31] a sus necesidades y a abordar su progreso y solicitudes. Este enfoque mejora el rendimiento académico y reduce la presión sobre el profesorado, ya que tareas repetitivas como la calificación y la búsqueda de materiales adecuados se realizan automáticamente. En el sector manufacturero, la IA Agentic se aplica al mantenimiento predictivo, donde se evalúa el estado de las máquinas, se anticipan futuras averías y se realiza el mantenimiento cuando es necesario sin intervención humana, para que la producción se desarrolle sin problemas y con la mínima demora. Es evidente que, una vez implementada, la IA Agentic permite a las industrias operar con mayor eficacia, flexibilidad y escalabilidad.

B. Colaboración entre humanos e IA

La IA Agentic amplía el alcance de la productividad humana en ámbitos colaborativos y cognitivos [32] . En ámbitos que requieren un alto nivel de conocimiento, como el jurídico o la investigación, puede apoyar a los profesionales condensando automáticamente documentos, extrayendo documentos relevantes o realizando investigaciones de antecedentes profesionales para que los usuarios puedan concentrarse en aspectos más complejos del trabajo. Por ejemplo, en la práctica jurídica [33] , la IA Agentic puede examinar un corpus de textos legales, recordar documentos esenciales y ayudar a los abogados a recuperar casos con leyes similares.

En las industrias creativas, la IA de Agentic puede redactar textos, desarrollar conceptos de diseño o realizar modificaciones creativas basándose en ediciones previas o en las aportaciones del cliente. Se espera que las herramientas de IA de Agentic reduzcan estas tareas innecesarias y mejoren la productividad del desarrollo de contenido. Asimismo, en la atención al cliente, la IA de Agentic puede responder preguntas sencillas, ofrecer asistencia y derivar problemas complejos a agentes humanos, mejorando así el tiempo de respuesta y la satisfacción del cliente. Esta integración fluida de la colaboración entre humanos e IA permite a los trabajadores dedicar su tiempo a un espacio de trabajo más estratégico y creativo. Al mismo tiempo, la IA de Agentic se encarga de los aspectos operativos.

C. Sistemas de software adaptativos

Existe una tendencia gradual hacia la IA Agentic en sistemas de software adaptativos o «vivos» [34] , que pueden cambiar sus características sin las limitaciones habituales y modificar dinámicamente sus funcionalidades según la evolución del entorno. Estas variables hacen que el sistema se reconfigure rápida o automáticamente para garantizar que el autoaprendizaje mejore con cada uso. Esto incluye actualizaciones en tiempo real de las sugerencias de los usuarios en función de las recomendaciones, así como actualizaciones dinámicas de las sugerencias basadas en la evolución de las recomendaciones del usuario.

Otros casos incluyen actividades automatizadas en la casa inteligente donde, gracias a la IA de Agentic, los huéspedes pueden modificar la iluminación, la temperatura y los protocolos de seguridad para que la IA integrada registre el comportamiento de los usuarios. En los procesos de desarrollo de proyectos, por ejemplo, los bots de gestión de proyectos con IA de Agentic pueden centrarse en la secuenciación de tareas, la distribución de la carga de trabajo y la complejidad del cronograma de tareas para modificar dinámicamente los plazos [35] cuando sea necesario, lo que permite a los usuarios adaptarse a los diversos cambios del proyecto con gran eficacia. Estas aplicaciones de software adaptativas reducen la necesidad de intervención humana y mejoran la usabilidad y la funcionalidad del sistema.

D. Áreas de aplicación emergentes

Ante las necesidades dinámicas de los pacientes, que exigen una capacidad de respuesta continua, existen nuevos casos de uso específicos para la aplicación de la IA Agentic en ámbitos específicos. Entre ellos, se incluye la medicina personalizada [36] , donde un sistema de IA Agentic podría gestionar pacientes crónicos mediante la supervisión de su historial clínico, el envío de recordatorios de medicación [37] y la modificación de las recomendaciones de tratamiento en función de otros indicadores de salud. Estos sistemas proporcionarían un protocolo individualizado de gestión de la atención e incluso monitorizarían los indicadores tempranos de otras afecciones de salud en progresión, especialmente en personas mayores que probablemente requieran atención máxima.

Para la creación de literatura, se espera que la IA Agentic adquiera nuevas funciones en la generación automática de contenido, dirigiéndose a audiencias más amplias y cumpliendo con parámetros precisos en la creación de contenido. Por ejemplo, en marketing, los sistemas de IA Agentic enviarían correos electrónicos y anuncios personalizados según la actividad del usuario y generarían contenido para los anuncios en primer lugar. Además, en el contexto de la investigación autorreguladora, los científicos que utilizan IA Agentic pueden lograr los objetivos de una búsqueda bibliográfica, desarrollar nuevas líneas de pensamiento e incluso crear diseños de investigación. Se podrían observar períodos de investigación más rápidos en los campos de la investigación del desarrollo de fármacos [38] o la investigación del cambio climático. A través de la expansión en estas nuevas direcciones, la IA Agentic muestra una mayor capacidad para penetrar en mercados de alto valor que requieren aplicaciones personalizadas, dinámicas y de autoservicio.

La Tabla 7 ofrece una visión general de las aplicaciones de la IA Agentic en diversos ámbitos, ilustrando la diversa gama de tareas y contextos donde los sistemas autónomos y orientados a objetivos pueden optimizar las operaciones y generar valor. Desde la atención médica hasta el marketing personalizado, la versatilidad y adaptabilidad de la IA Agentic abren posibilidades para soluciones innovadoras en todos los sectores.

TABLA 7 Descripción general de las aplicaciones de IA agenética en todos los dominios

E. Escenarios que demuestran adaptabilidad

1) Gestión de desastres

Un sistema de IA de Agentic, implementado en la gestión de desastres, analiza de forma autónoma datos ambientales en tiempo real durante una inundación. Redistribuye recursos, como equipos de rescate y suministros médicos, a las zonas más necesitadas, ajustando dinámicamente las estrategias en función de las condiciones meteorológicas cambiantes y los datos recibidos.

2) Atención al cliente

En un entorno de comercio electrónico, un chatbot de inteligencia artificial de Agentic adapta su tono y sus estrategias de resolución de problemas en función del análisis de sentimientos en tiempo real de las interacciones del cliente, mejorando la satisfacción del usuario.

3) Monitoreo de la atención médica

Un sistema de inteligencia artificial de Agentic basado en hospitales detecta patrones en los signos vitales de los pacientes, predice posibles complicaciones y notifica de forma autónoma a los proveedores de atención médica, lo que permite intervenciones oportunas sin intervención humana.

Estos escenarios resaltan las capacidades dinámicas y orientadas a objetivos de Agentic AI en aplicaciones del mundo real.SECCIÓN VI.

Análisis comparativo de las implementaciones de IA de Agentic

A. Métricas de comparación

Para evaluar y triangular exhaustivamente las implementaciones de IA Agentic, es necesario identificar métricas acordes con su rendimiento, flexibilidad y apalancamiento. Las siguientes métricas son las predominantes en el sector:

- Adaptabilidad : Esta métrica considera la propensión o capacidad del sistema de IA para reaccionar de forma activa a modificaciones del entorno, ya sean inmediatas o abruptas. Una puntuación alta de adaptabilidad [39] significa que el sistema de IA puede experimentar pérdidas de rendimiento debido a condiciones nuevas, como cambios en las medidas estadísticas, pero sin llegar a incurrir en pérdidas significativas.

- Eficiencia en el Logro de Objetivos : Esta métrica refleja la inclinación o capacidad de la IA para alcanzar sus objetivos con un uso mínimo de recursos, como tiempo y horas-persona. Esta métrica resulta crucial en aplicaciones donde la provisión del determinismo del modelo de IA tiene importantes consecuencias en la viabilidad de la aplicación.

- Tasa de aprendizaje y convergencia : Mide el tiempo que la IA tarda en aprender y acoplarse a una tarea específica. Una tasa de aprendizaje y una convergencia rápidas son siempre preferibles, ya que permiten a la IA trabajar eficazmente en entornos dinámicos que requieren aprendizaje continuo [40] , [41] .

- Robustez y Resiliencia : Esta medida determina el nivel de rendimiento del sistema cuando sus parámetros cambian o durante perturbaciones. La robustez [42] , [43] es un atributo que permite el diseño eficaz de la IA Agentic, capaz de operar en diversas circunstancias adversas, como escenarios inesperados, muy comunes en los sectores de la salud y la conducción autónoma.

- Escalabilidad : Se refiere a las características del sistema, que no deben cambiar con la variación del alcance o la complejidad de las tareas. Esta es una característica importante en industrias con volúmenes significativos de datos o procesos operativos, como las finanzas o la manufactura [44] .

- Satisfacción del usuario y eficiencia de la colaboración humano-IA : La satisfacción del usuario con los sistemas de IA agéntica que dependen de la interacción humana [45] , [46] es un indicador clave de rendimiento. Esta métrica examina cómo el lenguaje, en particular la participación de la IA, se traduce en productividad, usabilidad y calidad de soporte para los usuarios.

La Tabla 8 resume estas métricas y proporciona una base para evaluar las implementaciones de Agentic AI en diversas aplicaciones.

TABLA 8 Métricas de comparación para implementaciones de IA de Agentic

B. Estudios de caso

Los casos prácticos presentados en esta subsección ilustran los usos prácticos y el rendimiento de los sistemas de IA agéntica en diversos escenarios. Estos ejemplos resaltan las capacidades de la IA agéntica para lograr objetivos complejos en un entorno cambiante.

- Monitoreo y Diagnóstico de la Salud : Un sistema de monitoreo de la salud basado en la IA de Agentic, desarrollado para el monitoreo de la salud, puede identificar de forma independiente el deterioro del estado de un paciente mediante el seguimiento constante de sus signos vitales. Este sistema se ha probado en un hospital para optimizar la rapidez de las intervenciones sanitarias [47] . Su importancia se está volviendo crucial, ya que mejora el tiempo de respuesta a diversos problemas de salud. Gracias a su versatilidad, puede operar bajo diferentes condiciones y problemas del paciente, ofreciendo alta robustez y confiabilidad.

- Análisis del Mercado Financiero y Trading Algorítmico : En el sector financiero [48] , [49] , se utilizó un sistema de IA agentic para desarrollar estrategias de trading y optimizar el mercado en tiempo real con mínima interacción humana. Para minimizar las estrategias, la IA las ajusta basándose en datos históricos y actuales para mejorar los resultados de las operaciones en momentos de alta volatilidad del mercado. Este caso práctico demuestra la eficacia y flexibilidad de la IA agentic en entornos dinámicos y de alto riesgo, ya que pequeñas mejoras en la velocidad y precisión en la toma de decisiones generan importantes retornos financieros.

- Atención al cliente autónoma en comercio electrónico : En una plataforma de comercio electrónico, un agente de atención al cliente, posible gracias a la tecnología de IA de Agentic, solicita atención sin asistencia [50] , conociendo a la perfección las necesidades del usuario individual gracias a su comportamiento previo y preferencias. Con el tiempo, el agente de IA se adapta a las interacciones y entradas pasadas del sistema para mejorar sus respuestas a las preguntas; este es un ejemplo clásico de una buena relación humano-IA [51] . En general, los clientes han estado más satisfechos con la atención adaptativa individualizada y adaptada al contexto, y este caso demuestra las ventajas de incorporar IA de Agentic en las iniciativas de atención al cliente.

- Fabricación inteligente y mantenimiento predictivo : En una planta, la IA de Agentic calcula el tiempo previsto hasta el fallo de la máquina, su vida útil restante y cuándo realizar actividades de mantenimiento [52] para maximizar la disponibilidad operativa. Este sistema aprovecha los datos de un clúster de máquinas para predecir proactivamente fallos futuros y optimizar la distribución de recursos, lo que, a su vez, impulsa el proceso de producción. Implementaciones de ejemplo demuestran la robustez y escalabilidad del sistema de IA de Agentic para funcionar eficientemente en operaciones a gran escala basadas en datos.

Estos casos prácticos destacan la aplicabilidad de las tecnologías de IA de Agentic en diversos sectores, desde la salud hasta el financiero y el manufacturero. Todos demuestran diversos aspectos de estas tecnologías en la práctica, que pueden escalarse para problemas de distintos niveles de complejidad.

C. Evaluación comparativa

La evaluación comparativa es uno de los procedimientos más importantes para evaluar el rendimiento de la IA de Agentic y su modelo estándar. Este paso es fundamental, ya que permite a los investigadores y desarrolladores de modelos modelar. Se han desarrollado varios conjuntos de datos y entornos de evaluación comparativa estandarizados que ahora se utilizan para implementar la IA de Agentic:

- Conjuntos de datos de atención médica (p. ej., MIMIC-III, PhysioNet) : Los conjuntos de datos de atención médica [53] , [54] se aplican en el entrenamiento y la evaluación de sistemas de IA para la monitorización de pacientes, la predicción de diagnósticos clínicos y el apoyo a la toma de decisiones clínicas. La afirmación de que un sistema de IA Agentic está teniendo un excelente rendimiento en los parámetros de referencia de la atención médica demuestra que es posible crear sistemas de IA que puedan trabajar con precisión con información tan sensible y crucial para la vida.

- Datos financieros (p. ej., Yahoo Finanzas, datos históricos del NASDAQ) : Los conjuntos de datos fundamentales de encuestados con historial de ventas [55], como el historial de precios de las acciones, son muy útiles para una IA de tipo agente, capaz de realizar análisis predictivo y trading algorítmico. Estos conjuntos de datos también pueden utilizarse para evaluar el rendimiento en cuanto a capacidad de predicción, robustez en mercados volátiles y rentabilidad de las operaciones.

- Simuladores de Conducción Autónoma (p. ej., CARLA, OpenAI Gym) : Estos entornos permiten realizar pruebas de conducción para tareas de navegación autónoma y para la IA en vehículos. La tasa de aprendizaje de los sistemas de IA, así como su capacidad adaptativa, también se evalúan en estos entornos [56] , [57] . Los simuladores son especialmente útiles en pruebas que exigen que los sistemas realicen tareas similares de seguridad y toma de decisiones en diversas condiciones.

- Conjuntos de datos de atención al cliente (p. ej., MultiWOZ, reseñas de clientes de Amazon) : Las interacciones con el cliente eficientes y personalizadas, optimizadas con IA, se evalúan en la dimensión de colaboración entre usuarios y sistemas o soporte. Este conjunto de datos facilita la estimación de dichas medidas. El buen desempeño en estos parámetros es un indicador directo de la capacidad del agente para atender las inquietudes de los usuarios y responder a consultas complejas.

- Conjuntos de datos de fabricación e IoT (p. ej., Repositorio de datos de pronóstico de la NASA) : Esta fuente de datos consta de datos de sensores de equipos industriales que se utilizan para entrenar la aplicación de IA para el mantenimiento predictivo [58] , [59] . La evaluación del rendimiento de estos conjuntos de datos busca evaluar la predicción de fallos, la asignación de recursos y la eficacia con la que las operaciones responden a diferentes condiciones.

En la Tabla 9 se resumen estos puntos de referencia, destacando las diversas áreas de aplicación y el enfoque específico de cada conjunto de datos o entorno.

TABLA 9 Puntos de referencia y conjuntos de datos para evaluar las implementaciones de IA agencial

Este enfoque de evaluación comparativa integral permite evaluar y perfeccionar los sistemas de IA de Agentic en función del rendimiento en áreas de aplicación clave, lo que garantiza que cumplan con los estándares de la industria en cuanto a eficiencia, precisión y adaptabilidad en escenarios del mundo real.

D. Evaluación crítica de las implementaciones existentes

Las implementaciones de inteligencia artificial agente existentes resaltan su potencial transformador y los desafíos asociados con su implementación.

Éxitos

- En el ámbito sanitario, los sistemas de IA de Agentic han monitorizado con éxito a pacientes, identificado señales de alerta temprana y sugerido intervenciones en tiempo real. Estos sistemas optimizan la prestación de servicios de salud, especialmente en situaciones de alta demanda.

- En finanzas, el trading algorítmico impulsado por Agentic AI ha demostrado un rendimiento superior durante condiciones de mercado volátiles al ajustar dinámicamente las estrategias comerciales.

- En la industria manufacturera, los sistemas de mantenimiento predictivo han reducido el tiempo de inactividad al anticipar de forma proactiva las fallas de los equipos y programar el mantenimiento.

Limitaciones

- Los sistemas de atención sanitaria a menudo requieren un preprocesamiento extenso de datos y tienen dificultades con la heterogeneidad de los datos.

- Los modelos de IA financiera pueden sobreajustarse a las tendencias históricas, lo que limita la adaptabilidad a eventos nuevos.

- Los sistemas de fabricación enfrentan problemas de integración con equipos heredados y limitaciones de escalabilidad.

Lecciones aprendidas

- Las implementaciones efectivas de inteligencia artificial agente requieren canales de datos robustos y conjuntos de datos de entrenamiento de alta calidad.

- La incorporación de mecanismos de retroalimentación y supervisión humana mejora el desempeño y garantiza el cumplimiento ético.

- Los modelos híbridos que combinan paradigmas clásicos y agentes a menudo producen resultados superiores, como se observa en entornos complejos con múltiples partes interesadas.

Abordar estas limitaciones y aprovechar las lecciones aprendidas será fundamental para avanzar la IA agente en diversos dominios.SECCIÓN VII.

Desafíos y limitaciones técnicas

A. Alineación de objetivos y complejidad

Una consideración crucial en el diseño de cualquier sistema es cómo los objetivos autónomos de la IA concuerdan con las diversas perspectivas de la moral social y los objetivos de los usuarios humanos. En resumen, no es como el funcionamiento general de la IA actual, donde existen comandos predefinidos. Por el contrario, la IA agencial se beneficia de poseer una serie de objetivos altamente complejos, que pueden evolucionar con el tiempo. Existe un problema de diseño evidente: los objetivos de las personas no siempre conducen a los resultados previstos, lo que podría, por ejemplo, requerir el desarrollo de objetivos, técnicas o estrategias inapropiadas.

Sin embargo, la cuestión de la desalineación de objetivos a veces se aborda con mayor facilidad que cuando los objetivos centrales de los proyectos son multidimensionales y dependen del contexto del proyecto. Por ejemplo, en el caso de la ética médica, un agente de IA que opera para una tasa de recuperación máxima de los pacientes podría centrarse en aquellas estrategias que funcionan rápidamente y dan resultados incluso a corto plazo, pero que pueden no ser lo mejor a largo plazo. Además, estos problemas están entrelazados con los objetivos éticos y las estructuras de valores, que son difíciles de articular e integrar dentro del sistema de objetivos debido a particularidades interculturales o de la industria. Abordar este problema es un requisito porque otros investigadores están investigando marcos alineados como la alineación de valores y el aprendizaje de refuerzo inverso, donde los sistemas éticos son congruentes con los sistemas de recompensa emic. Sin embargo, estas explicaciones aún se encuentran en la comprensión muy básica y requieren mucho trabajo para abordar los cambios complejos en los objetivos humanos.

B. Adaptabilidad ambiental y situacional

Como se mencionó anteriormente, las IAs agénticas tienden a utilizarse en entornos dinámicos y altamente complejos. Este desafío de adaptabilidad se relaciona con la adaptación a las condiciones del mundo real, que pueden cambiar en un plazo breve sin intervención humana. En la práctica, es bastante difícil ser altamente adaptativo, ya que muchas dinámicas del mundo real son altamente impredecibles, como las tendencias del mercado en la inversión financiera, las tendencias epidemiológicas en la atención médica o incluso los eventos de viaje en vehículos autónomos.

Para la mayoría de los sistemas de IA agéntica, las barreras tecnológicas o contextuales exigen la acción incluso con información incompleta, lo que aumenta las ambigüedades en la fiabilidad del rendimiento. Por ejemplo, en el caso de la conducción autónoma, la IA agéntica puede no estar familiarizada con las condiciones del tráfico circundante o con patrones climáticos como la nieve o las fuertes lluvias, lo que requiere una adaptación segura para mantener la eficiencia. Si bien el metaaprendizaje y el aprendizaje por refuerzo pueden ayudar a aumentar la adaptabilidad de los agentes al permitirles aprender de su pasado, las limitaciones también residen en los enfoques, ya que la adaptación y la robustez son objetivos difíciles de alcanzar. Además, la implementación de modelos de aprendizaje automático basados en procesos generalizados en entornos tan complejos suele requerir un alto tiempo de computación, lo cual solo es práctico en ocasiones.

C. Limitaciones de recursos

Las IAs con agentes son sistemas complejos que requieren una gran cantidad de recursos computacionales y energéticos para sus fases de entrenamiento e implementación en espacios navegables. Uno de ellos es el aprendizaje por refuerzo, que depende en gran medida de la simulación y el procesamiento de datos, lo que, en consecuencia, aumenta el coste y el tiempo de entrenamiento. Asignar tiempo a las demandas de recursos en circunstancias de toma de decisiones en tiempo real supone un gran reto en aplicaciones como el sector financiero y los vehículos autónomos.

Además, el hardware es otro recurso para la IA Agentic, ya que estos sistemas suelen requerir instalaciones especializadas cuando se implementan en entornos reales. Por ejemplo, si se utiliza un dron o robot autónomo, se requerirán GPU de alto rendimiento, sensores de baja latencia y una fuente de energía esencial para permitir una toma de decisiones rápida. Asimismo, la proliferación de sistemas Agentic, especialmente aquellos basados en control y monitorización centralizados, puede generar una presión creciente sobre los recursos de almacenamiento, procesamiento y ancho de banda de la red. A estos desafíos se suman los métodos de optimización del hardware y los algoritmos de eficiencia energética que se requerirán para implementar sistemas de IA Agentic de forma eficiente, rentable y a gran escala.

D. Escalabilidad

Con la creciente complejidad del diseño, el escalado mejora el rendimiento del sistema. Algunas aplicaciones de IA de agentes, ya sea en ciudades inteligentes, sanidad o servicios financieros, son de gran escala y requieren una mayor proporción de IA por agente, tareas multifacéticas o la gestión de grandes cantidades de datos. Sin embargo, es fundamental garantizar que estos sistemas puedan escalarse a un nivel superior sin perder métricas clave de rendimiento, ya que suele implicar una multitud de tareas y fuentes de datos concurrentes.

El diseño de múltiples agentes o componentes y su interacción presenta un desafío importante en términos de escalabilidad. Por ejemplo, en una ciudad inteligente, puede haber una IA que gestione el tráfico, la energía y la recolección de residuos. Diferentes arquitecturas deben ser capaces de lograr que los subsistemas necesarios colaboren y realicen tareas complejas simultáneamente. Además, como la mayoría de los arquitectos entienden, el escalado de la IA de agentes también agrava problemas como la dependencia de objetivos, el uso de recursos y la capacidad de actuar en diversos escenarios. Hoy en día, el control descentralizado, el aprendizaje federado y las estructuras jerárquicas se utilizan o investigan para mejorar la escalabilidad. Sin embargo, el problema persiste, ya que el escalado horizontal de técnicas fluidas es una limitación tecnológica relacionada con la IA que opera a mayor escala.

La Tabla 10 presenta un resumen de los principales desafíos y limitaciones técnicas que se enfrentan en el desarrollo e implementación de la IA Agentic. Abordar estos desafíos es esencial para el avance del campo y garantizar que los sistemas de IA Agentic funcionen de forma eficaz y responsable en situaciones reales.

TABLA 10 Desafíos técnicos y limitaciones en la IA agente

Implicaciones éticas, sociales y de gobernanza

A. Rendición de cuentas y responsabilidad

Dada la independencia en la toma de decisiones que muestran estos sistemas, comprender la responsabilidad en los sistemas de IA Agentic es un desafío complejo. En los sistemas de IA más tradicionales, las herramientas son responsabilidad de las personas (el desarrollador, el operador o el usuario), y la responsabilidad recae en quien las utiliza. Con la IA Agentic, la cuestión de la responsabilidad es más controvertida debido a la naturaleza de una IA de acción independiente. En situaciones donde la IA autónoma toma una decisión que resulta en un resultado negativo, la cuestión de la responsabilidad suele estar mal planteada: ¿es el desarrollador, el proveedor de servicios que implementa la IA o el sistema de IA?

Este problema en particular se manifiesta claramente en áreas como las finanzas y la salud, donde estos sistemas gestionan la toma de decisiones de alto riesgo con grandes repercusiones. Es necesario que exista una brecha más significativa entre los marcos de atribución de responsabilidad y las complejidades del comportamiento presentes en los sistemas de IA agencial. Por lo tanto, es necesario invocar regulaciones y, posiblemente, nuevas estructuras legales para delimitar la responsabilidad o la rendición de cuentas, especialmente en entornos donde múltiples partes interesadas participan en la ejecución del sistema, lo que ocurre la mayor parte del tiempo.

B. Sesgo, imparcialidad y transparencia

También se sabe que los sistemas de IA agéntica pueden replicar y exacerbar los sesgos en los datos de entrenamiento disponibles. El concepto de sesgo es especialmente preocupante en lo que respecta al uso de IA agéntica en prácticas de contratación, vigilancia policial y concesión de préstamos. No solo es necesario reconocer estos sesgos, sino que también deben abordarse mediante una gestión adecuada de los datos, una implementación cuidadosa de algoritmos y programas activos de reducción de sesgos. Sin embargo, es fundamental destacar que abordar y mitigar los sesgos en sistemas autónomos es una tarea mucho más difícil que en la IA tradicional debido a la naturaleza de las tareas que dichos sistemas están diseñados para realizar.

Otro aspecto importante que también contribuye a mejorar la equidad y la confianza en los sistemas de IA agéntica [60] es la transparencia. El funcionamiento de estos sistemas debe explicarse mediante enfoques XAI, y debe procurarse la transparencia de los procesos de toma de decisiones para los usuarios finales y las partes interesadas. Esta exposición puede ayudar a verificar eficazmente las acciones de una IA y crear un marco para abordar el sesgo o la injusticia. Sin embargo, la explicabilidad es bastante difícil de lograr, y se espera que se logre un grado mayor en los casos de sistemas de IA agéntica, que tienden a utilizar modelos de aprendizaje de refuerzo profundo. Esta área de preocupación siempre ha sido encontrar el equilibrio adecuado entre la complejidad estructural y la transparencia.

C. Cuestiones de privacidad y seguridad

Los agentes pueden desempeñar sus funciones eficazmente en diferentes entornos basándose en información relevante, a menudo privada en ámbitos como la salud y las finanzas, que ya son áreas sensibles. Esta dependencia de la información personal genera preocupaciones sobre la privacidad, ya que los datos pueden manipularse indebidamente e incluso accederse ilegalmente, lo que conlleva una grave vulneración de la privacidad del usuario. Además, en este contexto, la autonomía de la IA de Agentic puede suponer un desafío, ya que el uso de los datos puede ser difícil de rastrear, lo que aumenta la probabilidad de abuso de la privacidad.

También existe un desafío de seguridad, ya que los ciberataques pueden amenazar estos sistemas, socavando su propósito original y exponiendo las debilidades del sistema existente. Si los sistemas de IA con agentes son hackeados, podrían causar una gran destrucción, principalmente cuando los sistemas controlan infraestructura crítica o tareas sensibles que deben decidirse en ese contexto. Existe una gran necesidad de mantener un enfoque sólido e integral hacia la ciberseguridad, ya que es necesario para proteger la información de la que dependen estos sistemas y su funcionalidad. Si bien técnicas como la privacidad diferencial y la computación multipartita segura pueden parecer prometedoras, aún existen amenazas a la privacidad y la seguridad, por lo que su implementación debe realizarse con cuidado para mantener la privacidad funcional requerida.

D. Perspectivas regulatorias y legales

La perspectiva regulatoria y legal sobre la IA Agentic aún está en desarrollo, ya que los reguladores intentan simplificar los desafíos únicos que presentan los sistemas autónomos. La normativa actual sobre IA aborda principalmente cuestiones de privacidad, transparencia y rendición de cuentas, pero no necesariamente aborda los desafíos que plantea la autonomía de la IA Agentic. Por ejemplo, el Reglamento General de Protección de Datos (RGPD) de la UE [61] impone obligaciones estrictas con respecto a los datos y el consentimiento del usuario, pero estos requisitos pueden no ser adecuados para la gestión de sistemas de IA que operan en tiempo real con decisiones autónomas.

Los responsables políticos [62] también están investigando otros marcos, en particular para sistemas de IA de alto riesgo. Algunos enfoques exigen una «cadena de responsabilidad de la IA», que puede ayudar a las partes interesadas a determinar la responsabilidad de cada parte de los sistemas de IA. En cambio, otros recomiendan una explicabilidad obligatoria para algunas aplicaciones de IA. Es probable que las normas legales para la IA Agentic incluyan planes de gestión de riesgos que contengan requisitos para la realización de evaluaciones de riesgos, auditorías periódicas y certificaciones para sistemas que operan en sectores vulnerables como la salud, las finanzas y la seguridad. Sin embargo, se prevé que, a medida que la IA Agentic avance, será crucial desarrollar marcos legales que faciliten la innovación y, al mismo tiempo, mejoren la seguridad y la responsabilidad.

La Tabla 11 resume las principales consideraciones éticas y de gobernanza para la IA Agentic, destacando las complejidades que surgen a medida que estos sistemas se vuelven cada vez más autónomos.

TABLA 11 Consideraciones éticas y de gobernanza para la IA agente

Marcos actuales para una IA agente segura y responsable

A. Protocolos de seguridad

Se han creado diversas medidas y marcos de seguridad como requisito para prevenir los riesgos autónomos asociados a la toma de decisiones. Uno de los métodos más básicos son los protocolos de seguridad de objetivos , que consisten en procedimientos orientados a objetivos que sugieren a la IA qué objetivos son aceptables y cuáles son perjudiciales. Estos protocolos previenen daños al garantizar que la IA se esfuerce por alcanzar objetivos legales, seguros y éticos. Además, para evitar que la IA se salga de los límites o se encuentre con situaciones peligrosas imprevistas, se implementan mecanismos de seguridad [63] que pueden ajustar o incluso interrumpir por completo las actividades de la IA.

Un marco de trabajo de este tipo, empleado principalmente, es el protocolo de evaluación y gestión de riesgos [64] , que permite revisar los riesgos que plantean las acciones de la IA y, posteriormente, implementar las medidas de control. Esto es especialmente importante en los ámbitos de la atención médica y la conducción autónoma, donde la IA realiza acciones que afectan la vida de las personas. Además, algunos sistemas de IA Agentic utilizan barreras éticas [65] , que impiden que la IA tome decisiones que generen inquietudes éticas y promueven su comportamiento conforme a las normas sociales y la ética. Los protocolos de seguridad ilustrados funcionan como un sistema de capas, ofreciendo un buen nivel de protección contra el abuso ético de la IA Agentic.

B. Mecanismos de seguimiento y control

La acción autónoma de los sistemas de IA con agentes requiere mecanismos de monitorización y control que rijan dichas acciones y permitan la intervención humana cuando sea necesario. Los sistemas de monitorización en tiempo real [66] , [67] supervisan las actividades y decisiones de la IA y permiten la intervención humana si es necesario. Por ejemplo, en el caso de los sistemas de negociación financiera, la IA puede emplearse para identificar patrones comerciales inusuales en tiempo real, alertando a las autoridades pertinentes y permitiendo que dichas actividades se realicen con niveles de riesgo aceptables.

Marcos como Human-in-the-loop (HITL) [68] y Human-on-the-loop (HOTL) [69] se han diseñado con la idea de mantener un equilibrio entre el grado de autonomía experimentado y la necesidad de control humano. Cuando se implementan configuraciones HITL, los operadores humanos tienden a aprobar algunas acciones e interactuar directamente con la IA al tomar ciertas decisiones. Por otro lado, en los sistemas HOTL, el supervisor humano supervisa la IA sin decidir sobre cada acción, pero puede intervenir cuando sea necesario. Estos mecanismos son esenciales para la atención médica y otras decisiones importantes que involucran IA, donde la presencia de inteligencia humana aún es necesaria.

Los sistemas de IA agéntica también incorporan protocolos de anulación para detener o modificar las acciones de la IA si una situación se clasifica como imprevista o se sale del rango razonable de comportamiento esperado. Los sistemas de última línea ofrecen otro nivel de defensa al permitir que la IA sea dominada por un humano si su comportamiento autónomo resulta perjudicial. En combinación con lo anterior, estas medidas de monitoreo y control están diseñadas para ofrecer una defensa exhaustiva que garantice que la inteligencia artificial agéntica no exceda los entornos controlados y supervisados, con todo tipo de procedimientos de intervención humana firmemente establecidos.

C. Mecanismos de transparencia

La confianza y la rendición de cuentas son fundamentales para el despliegue de la IA Agentic, y ambas pueden verse erosionadas por la falta de transparencia. Se han propuesto técnicas de IA Explicable (XAI) [70] , [71] para ofrecer una visión más transparente del funcionamiento interno de estos modelos de IA multicapa para la toma de decisiones. Como resultado, la XAI enriquece la rendición de cuentas de los procesos involucrados en la toma de decisiones, ya que los líderes en un campo específico, como el financiero y el sanitario, donde las decisiones tienen profundas consecuencias, están informados sobre las premisas en las que se basaron las acciones específicas.

Más allá de su transparencia, los registros de auditoría pueden añadirse como una capa adicional a los sistemas de IA de Agentic para documentar cada lógica y decisión, de modo que las acciones de la IA puedan examinarse posteriormente. Estos registros son ideales para el cumplimiento normativo, ya que ayudan a las organizaciones a garantizar que las decisiones anteriores cumplieran con la ley. Los algoritmos de autodocumentación [72] también contribuyen a la IA autoexplicativa mediante la preparación automática de informes y explicaciones sobre las decisiones del sistema durante su funcionamiento. Estos mecanismos no solo fomentan la transparencia, sino que también facilitan la retroalimentación, ya que permiten a los desarrolladores y a las partes interesadas mejorar y comprender el proceso de toma de decisiones de la IA a lo largo del tiempo.

D. Estudios de caso de enfoques de gobernanza

Diversos esfuerzos de la industria y la academia han creado marcos de gobernanza para garantizar el uso seguro, responsable y ético de la IA. A continuación, se presentan varios ejemplos que merecen la pena mencionar [73] :

- Principios de IA y Estándar de IA Responsable de Microsoft : Estos incluyen equidad, confiabilidad, privacidad, inclusión y transparencia, que rigen el desarrollo de los sistemas de IA según el Estándar de IA Responsable de Microsoft. También incluye el Comité Aether, que aborda de forma justa los problemas éticos y sociales que plantea la IA. Este marco se ha utilizado en otros productos de la empresa para desarrollar sólidos procesos de gestión de riesgos de IA en toda la oferta de Microsoft.

- Principios de IA y Tarjetas Modelo de Google para la Transparencia : Google define los principios de IA para el desarrollo y la implementación de IA, garantizando al mismo tiempo la privacidad, la seguridad y la responsabilidad en todas sus plataformas. La compañía también utiliza Tarjetas Modelo , que contienen información sobre el rendimiento, las limitaciones y la aplicación prevista de un modelo, lo que permite a los usuarios apreciar las fortalezas y debilidades de los sistemas de IA.

- Carta y Estándares de Seguridad de OpenAI : OpenAI se comprometió a adoptar una carta que contiene estándares éticos y de seguridad que deben observarse en el desarrollo de IA de propósito general. OpenAI adopta un enfoque centrado en el ser humano y se centra en el valor para alinearse con estos objetivos, la investigación en seguridad y el desarrollo abierto de la IA. La investigación en seguridad de esta organización se centra en el desarrollo de modelos diseñados para interactuar y operar en entornos impredecibles, lo que permite un futuro responsable de la IA Agentic.

- Iniciativa Global del IEEE sobre Ética de Sistemas Autónomos e Inteligentes : Esta iniciativa del IEEE ha formulado estándares [74] con sus correspondientes directrices sobre IA ética y ha abordado áreas como la transparencia, la rendición de cuentas y la integridad de los datos. Su objetivo es ayudar a los desarrolladores a establecer el estándar para los sistemas de IA del Reino Unido que desarrollan, de modo que estos sistemas no solo sean funcionales, sino que también sean éticos y sociales, garantizando la confianza y la seguridad en las tecnologías de IA autónomas.

Estos estudios de caso ilustran diversos enfoques de gobernanza que equilibran la innovación con la seguridad, la rendición de cuentas y la transparencia. La Tabla 12 resume estos marcos, comparando los principios clave y las áreas de enfoque.

TABLA 12 Marcos de gobernanza para una IA agente segura y responsable

Desafíos de la investigación abierta y direcciones futuras

El desarrollo y la implementación de sistemas de IA Agentic presentan varios desafíos de investigación que requieren atención para garantizar una IA segura, eficaz y éticamente correcta. Esta sección explora estos desafíos y describe posibles direcciones futuras para el avance de la IA Agentic.

A. Mayor adaptabilidad y resiliencia

En contextos dinámicos e inciertos, los sistemas de IA Agentic deben demostrar adaptabilidad y resiliencia al operar en el entorno. La mayoría de los modelos existentes no se generalizan en diferentes entornos ni cambian significativamente sin reentrenamiento. Por lo tanto, el trabajo futuro podría incluir la resolución de problemas de metaaprendizaje y transferencia de aprendizaje específicos para sistemas de IA Agentic, lo que les permitirá adaptarse rápidamente a nuevas situaciones basándose en sus experiencias previas. Además, sería interesante investigar plataformas que permitan el aprendizaje en tiempo real, donde los agentes aprenden y se modifican en respuesta a los cambios, sin que sus funciones principales se vean afectadas. Esto mejoraría enormemente tanto la resiliencia como la adaptabilidad.

B. Mejorar la alineación de los objetivos con los valores humanos