Daniel Nasef 1 , Demarcus Nasef 1 , Viola Sawiris 1 , Brett Weinstein 2 , Jodan García 3 , Milan Toma 1

1Departamento de Medicina Manipulativa Osteopática, Facultad de Medicina Osteopática, Instituto Tecnológico de Nueva York, Old Westbury,Nueva York,EE.UU; 2Departamento de Ciencias Clínicas, Facultad de Medicina Osteopática, Instituto de Tecnología de Nueva York, Old Westbury,Nueva York,EE.UU; 3Facultad de Enfermería y Profesiones de la Salud Byrdine F. Lewis,Universidad Estatal de Georgia,Edificio de vida urbana,Atlanta, Georgia,EE.UU

Antecedentes y objetivo: La inteligencia artificial (IA) es un campo en rápida evolución en el ámbito sanitario, con nuevas publicaciones que surgen a diario y aportan nuevas perspectivas y resultados. La IA ha adquirido una importancia cada vez mayor en el ámbito sanitario, ofreciendo el potencial de mejorar los resultados de los pacientes, optimizar las operaciones hospitalarias e informar sobre las políticas sanitarias. Su integración en la práctica clínica, la gestión hospitalaria y las políticas sanitarias presenta oportunidades y desafíos que requieren una comprensión integral y una implementación responsable. Este artículo consiste en una revisión bibliográfica realizada con el objetivo de evaluar las implicaciones de la IA en el ámbito sanitario.

Métodos: Los artículos seleccionados para este estudio fueron artículos revisados por pares, publicados en inglés entre enero de 2023 y diciembre de 2024, centrados en aplicaciones de IA en la práctica clínica, la gestión hospitalaria o las políticas sanitarias. Los artículos se seleccionaron de diversas bases de datos, como PubMed/Medline, Scopus, EMBASE, Web of Science, Google Académico y ResearchGate. Tras el proceso de filtrado, se seleccionaron 159 artículos para la revisión.

Contenido clave y hallazgos:

Los resultados revelaron que la IA mejora significativamente la práctica clínica al mejorar la precisión diagnóstica, ofrecer recomendaciones de tratamiento personalizadas y facilitar la monitorización de los pacientes.

En la gestión hospitalaria, se ha demostrado que la IA contribuye a la eficiencia operativa al automatizar las tareas administrativas, optimizar la asignación de recursos y apoyar la toma de decisiones mediante análisis predictivos.

En cuanto a las políticas sanitarias, se ha demostrado que la IA facilita la formulación de políticas basadas en la evidencia, la generación de información basada en datos para la gobernanza y tiene el potencial de mejorar la equidad sanitaria al identificar y abordar las disparidades en la atención médica.

A pesar de estos beneficios, se identificaron varias limitaciones, como el riesgo de falsos positivos y negativos en aplicaciones clínicas, el sobreajuste de modelos debido a una validación inadecuada, las preocupaciones éticas relacionadas con la privacidad y la equidad de los datos, y los desafíos en el cumplimiento normativo.

Conclusiones:

La IA ofrece un gran potencial para el avance de la atención médica en múltiples ámbitos, pero para alcanzar su máximo potencial es necesario abordar consideraciones éticas, garantizar una validación robusta de los modelos y fomentar la colaboración entre profesionales sanitarios y expertos en IA. Establecer marcos regulatorios adecuados e integrar la formación en IA en la formación médica son pasos importantes hacia una integración responsable y eficaz de la IA en la atención médica.

Palabras clave: Inteligencia artificial (IA) ; atención sanitaria ; práctica clínica ; gestión hospitalaria ; política sanitaria

doi: 10.21037/jhmhp-24-138

Introducción

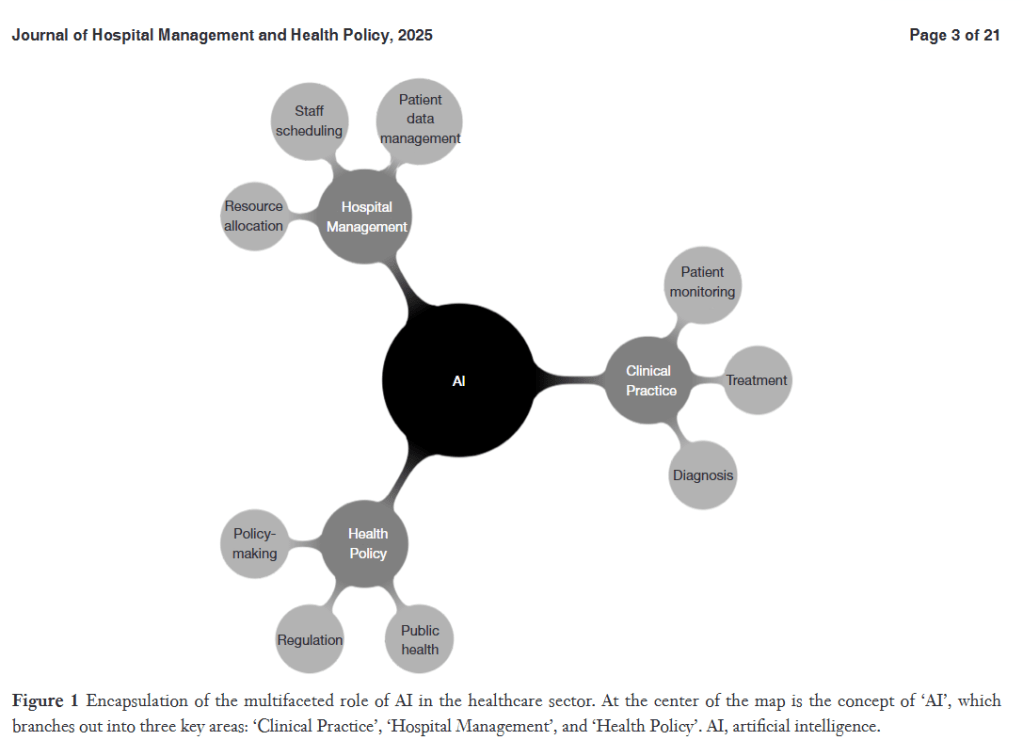

Un informe de la Academia Nacional de Medicina destacó tres ventajas potenciales de la inteligencia artificial (IA) en la atención médica: mejorar los resultados para los pacientes y los equipos clínicos, reducir los costos de la atención médica y promover una mejor salud de la población ( 1 ). Por lo tanto, en el complejo mundo de la atención médica, la IA sirve como un centro fundamental, extendiendo su influencia a tres áreas importantes ( Figura 1 ): práctica clínica, gestión hospitalaria y política sanitaria. Esta revisión se centra en la literatura que analiza la aplicación de la IA en estos entornos. El elemento de práctica clínica dilucida el papel multifacético de la IA en la atención al paciente ( 2 ). Comienza con el diagnóstico, donde la IA, específicamente el aprendizaje automático (ML), es instrumental en la imagenología y la patología, proporcionando resultados precisos y oportunos. Esto se extiende más allá en el tratamiento, donde las capacidades de la IA en la medicina personalizada se hacen evidentes en la adaptación de los tratamientos a las necesidades individuales del paciente. El elemento de práctica clínica culmina con la monitorización del paciente, lo que subraya la posibilidad de la integración de la IA en la tecnología portátil que permite el seguimiento en tiempo real de las métricas de salud del paciente. El componente de gestión hospitalaria retrata la importante contribución de la IA a las operaciones hospitalarias eficientes. Comienza con la asignación de recursos, donde se aprovechan las capacidades predictivas de la IA para anticipar el flujo de pacientes, garantizando un uso óptimo de los recursos. A continuación, la IA aborda la programación del personal, optimizando los turnos y contribuyendo a una mejor productividad y atención al paciente. Finalmente, la gestión de datos de pacientes, destacando el papel de la IA en la gestión de historiales clínicos electrónicos (HCE), garantizando un manejo seguro y eficiente de los datos de los pacientes. Finalmente, en las políticas sanitarias, la IA demuestra su profunda influencia en la formulación de políticas y la regulación. Comienza con la formulación de políticas, donde se utilizan los modelos predictivos de la IA para anticipar los resultados de las políticas, lo que facilita la formulación de políticas sanitarias eficaces. A continuación, está la regulación, donde las capacidades de monitorización de la IA garantizan el cumplimiento de las regulaciones sanitarias. Este componente concluye con la salud pública, donde la IA demuestra su papel en el seguimiento de brotes de enfermedades, contribuyendo a respuestas de salud pública oportunas y eficaces.

Figura 1. Resumen del rol multifacético de la IA en el sector sanitario. En el centro del mapa se encuentra el concepto de «IA», que se divide en tres áreas clave: «Práctica Clínica», «Gestión Hospitalaria» y «Política Sanitaria». IA, inteligencia artificial.

A pesar de los rápidos avances en la atención médica, persisten varios desafíos, como las imprecisiones diagnósticas, las ineficiencias en la gestión hospitalaria y la falta de formulación de políticas basadas en datos. Estos obstáculos dificultan la prestación de una atención óptima al paciente y la asignación eficiente de recursos. La IA se ha convertido en una posible solución, ofreciendo mejorar la precisión diagnóstica, agilizar los procesos administrativos e informar sobre políticas sanitarias basadas en la evidencia. Sin embargo, la integración de la IA en la atención médica también enfrenta desafíos significativos, como la necesidad de informes estandarizados alineados con los estándares regulatorios, garantizar la generalización de los modelos y abordar las preocupaciones éticas relacionadas con la privacidad y la equidad de los datos. Este estudio busca explorar el papel multifacético de la IA para abordar estos desafíos críticos y proporcionar una comprensión integral de sus implicaciones en la práctica clínica, la gestión hospitalaria y las políticas sanitarias, al tiempo que destaca los problemas actuales con la integración de la IA y la necesidad de marcos regulatorios sólidos.

La integración de la IA en la atención médica no es solo un cambio tecnológico, sino también un cambio significativo en cómo se llevan a cabo las prácticas clínicas y cómo se formulan las políticas de salud. La IA puede mejorar la precisión del diagnóstico, agilizar la gestión hospitalaria y mejorar los resultados de los pacientes. Sin embargo, también plantea inquietudes y desafíos éticos con respecto a la privacidad de los datos, las barreras de implementación y la necesidad de marcos regulatorios para garantizar un uso seguro y efectivo. El papel de la IA en la atención médica se ha discutido ampliamente en la literatura reciente. Por ejemplo, un estudio de Abubaker Bagabir et al. analiza la integración de la IA en entornos clínicos, centrándose en sus aplicaciones en la secuenciación del genoma, el desarrollo de fármacos y el descubrimiento de vacunas, particularmente en el contexto de la enfermedad del coronavirus 2019 (COVID-19) ( 3 ). Una revisión de Giordano et al. destaca varios roles que desempeña la IA en la atención médica, incluido su impacto en la gestión del paciente y la toma de decisiones clínicas ( 4 , 5 ). Una publicación de Secinaro et al. examina cómo las tecnologías de IA están remodelando las operaciones hospitalarias y las prácticas clínicas, enfatizando la eficiencia y las mejoras en la atención al paciente ( 6 ). Un artículo de Amini et al. Se analizan las consideraciones éticas y los desafíos que enfrenta la implementación de la IA en entornos de enfermería y atención médica ( 7 ). Un estudio cualitativo de entrevistas con líderes de atención médica realizado por Petersson et al. analiza los beneficios y desafíos de la IA en la atención médica, centrándose en los procesos administrativos y médicos ( 8 ).

Considerando estas contribuciones, es evidente que la IA, a pesar de ser un motor de innovación en la atención médica, también requiere una estrategia equilibrada para su uso ético y responsable. Los debates e investigaciones en curso destacan la importancia de la evaluación y la adaptación continuas para gestionar las complejidades que la IA introduce en el ámbito de la atención médica. Presentamos este artículo de acuerdo con la lista de verificación para la elaboración de informes de la Revisión Narrativa (disponible en https://jhmhp.amegroups.com/article/view/10.21037/jhmhp-24-138/rc ).

Métodos

La búsqueda bibliográfica para esta revisión se diseñó para recopilar las publicaciones más relevantes y recientes sobre las implicaciones de la IA en la atención médica, con especial atención a la gestión hospitalaria y las políticas sanitarias. Los criterios de inclusión exigieron que cada publicación contara con un Identificador de Objeto Digital (DOI) para garantizar su trazabilidad y credibilidad. Solo se consideraron artículos publicados en inglés entre enero de 2023 y diciembre de 2024 para garantizar la relevancia de la información. Se incluyeron artículos de investigación revisados por pares, revisiones y estudios clínicos que abordaron directamente el uso de la IA en los ámbitos específicos de la atención médica.

El diagrama de flujo que se muestra en la Figura 2 ilustra el proceso de búsqueda y selección. La búsqueda inicial arrojó un total de 1616 artículos, de los cuales se eliminaron 263 duplicados, lo que dejó 1353 artículos únicos. De los resultados de la búsqueda inicial, el 69,9 % (1129 artículos) se excluyó durante la revisión de títulos y resúmenes. Estas exclusiones se debieron principalmente a la irrelevancia para la IA en la gestión/política hospitalaria (n = 750, 66,4 % de los artículos excluidos), seguidas de fechas de publicación anteriores a 2023 (n = 262, 23,2 %), la falta de DOI (n = 86, 7,6 %) y publicaciones en idiomas distintos del inglés (n = 31, 2,8 %). Los 224 artículos restantes se sometieron a una evaluación de texto completo, que excluyó a 65 artículos adicionales, principalmente debido a métodos de validación inadecuados (n=23), ausencia de aplicaciones de IA en ámbitos clínicos, hospitalarios y de políticas (n=19), trazabilidad insuficiente (n=12) y otras razones (n=11). Un total de 159 artículos cumplieron todos los criterios de inclusión y se incluyeron en la revisión final. La estrategia de búsqueda detallada, incluyendo las bases de datos consultadas, los términos de búsqueda y los criterios de inclusión, se resume en la Tabla 1 .

Figura 2. Diagrama de flujo que ilustra el proceso de búsqueda y selección. Los números entre paréntesis indican los resultados iniciales de la búsqueda en cada base de datos. DOI: Identificador de Objeto Digital.

Tabla 1

Resumen de la estrategia de búsqueda empleada en la revisión de la literatura que describe los componentes clave del proceso de búsqueda, incluida la fecha de la búsqueda, las bases de datos y fuentes consultadas, los términos de búsqueda específicos y los filtros utilizados, el plazo de inclusión y el proceso de selección.

| Artículo | Especificación |

|---|---|

| Fecha de búsqueda | 15/01/2025 |

| Bases de datos y otras fuentes buscadas | PubMed/Medline, Scopus, EMBASE, Web of Science, Google Académico, ResearchGate |

| Términos de búsqueda utilizados | Palabras clave y frases como «Inteligencia artificial en la atención sanitaria», «IA en la gestión hospitalaria» e «Implicaciones de la IA para las políticas sanitarias». |

| Periodo de tiempo | 01/2023–12/2024 |

| Criterios de inclusión | Artículos de investigación revisados por pares, revisiones y estudios clínicos con DOI, publicados en inglés |

| Proceso de selección | Los autores trabajaron juntos para revisar y evaluar la pertinencia de cada publicación. Se llegó a un consenso mediante discusiones grupales, garantizando que todos los estudios seleccionados cumplieran con los criterios de inclusión y fueran relevantes para los ámbitos específicos de la atención médica. |

IA, inteligencia artificial; DOI, Identificador de Objeto Digital.

Avances críticos en la atención médica impulsada por IA

La literatura reciente subraya el potencial transformador de la IA en la atención médica en la práctica clínica ( 9 , 10 ), la gestión hospitalaria ( 11 ) y la política sanitaria ( 6 , 12 , 13 ). Las tecnologías de IA han demostrado la capacidad de mejorar la precisión diagnóstica, personalizar el tratamiento, mejorar la eficiencia operativa e informar la formulación de políticas. Sin embargo, la realización de estos beneficios requiere una cuidadosa atención a las consideraciones éticas, una validación sólida de los modelos de IA y esfuerzos colaborativos entre los profesionales de la salud, los expertos en IA y los responsables de la formulación de políticas para garantizar una implementación responsable y eficaz. Como se resume en la Tabla 2 , la revisión identifica avances críticos en el diagnóstico, la eficiencia operativa y la formulación de políticas basadas en la evidencia en los dominios de la práctica clínica, la gestión hospitalaria y las políticas sanitarias.

Tabla 2

Resumen de los principales resultados de la integración de la IA en la atención sanitaria

| Dominio | Hallazgos/resultados clave | Referencias |

|---|---|---|

| Práctica clínica | La IA mejora la precisión diagnóstica en imágenes médicas y análisis de patología | ( 9 , 14 ) |

| La integración de IA mejora la toma de decisiones en la gestión de enfermedades crónicas y el descubrimiento de fármacos | ( 10 ) | |

| La IA mejora la detección temprana de tumores malignos en la mamografía | ( 15 ) | |

| La IA predice el deterioro de la función renal mediante el análisis del volumen renal total | ( 16 ) | |

| Un inhibidor diseñado con IA para el carcinoma hepatocelular entra en ensayos clínicos | ( 17 ) | |

| Gestión hospitalaria | Combina modelos de simulación y ML para optimizar la asignación de recursos y la programación del personal. | ( 11 ) |

| La IA automatiza las tareas administrativas (programación, facturación), reduciendo errores y carga de trabajo. | ( 18 ) | |

| La optimización del flujo de pacientes impulsada por IA reduce las estadías hospitalarias y mejora el rendimiento | ( 19 ) | |

| Mejora la seguridad del EHR e identifica riesgos de cumplimiento a través de análisis predictivos | ( 20 , 21 ) | |

| Política de salud | La IA transforma la formulación de políticas mediante modelos predictivos y conocimientos basados en datos | ( 6 ) |

| Identifica los riesgos éticos en la implementación de la inteligencia artificial en la atención médica, incluida la privacidad de los datos y el sesgo algorítmico. | ( 7 , 22 ) | |

| Permite la respuesta ante pandemias mediante la distribución de vacunas optimizadas por IA y simulaciones de políticas. | ( 23 ) | |

| Identifica disparidades en la atención médica utilizando aprendizaje automático para promover políticas equitativas | ( 24 ) |

IA, inteligencia artificial; EHR, historial clínico electrónico; ML, aprendizaje automático.

Innovaciones impulsadas por IA en la práctica clínica

En la práctica clínica, las aplicaciones de IA, como los algoritmos de ML y las redes neuronales, han mejorado la precisión diagnóstica en áreas como la imagenología médica ( 9 , 25 ), la patología y el manejo de enfermedades crónicas ( 10 , 26 , 27 ). Por ejemplo, la IA se ha utilizado en exámenes de detección de cáncer para producir resultados más rápidos y precisos ( 15 , 28 , 29 ) y para predecir el deterioro de la función renal mediante el análisis del volumen renal total ( 16 ). Además, la IA respalda la medicina personalizada al optimizar las dosis de los medicamentos y adaptar los planes de tratamiento a los perfiles individuales de los pacientes ( 9 , 12 ), lo que conduce a mejores resultados para los pacientes y a una reducción de los costos de atención médica.

La IA también ha contribuido a los avances en el descubrimiento y desarrollo de fármacos. Mediante sistemas de experimentación autónoma impulsados por IA y plataformas de química generativa, los investigadores han acelerado la identificación de nuevos fármacos candidatos y materiales ( 17 , 30-45 ). Además, la IA ha mejorado la seguridad del paciente al reducir la posibilidad de error humano y facilitar el manejo de enfermedades crónicas como el asma, la diabetes y la hipertensión ( 46-49 ) .

Por lo tanto, la IA está logrando avances significativos en la práctica clínica ( 10 , 50 ) , ofreciendo capacidades de diagnóstico mejoradas ( 51-54 ) , recomendaciones de tratamiento personalizadas ( 55 , 56 ) y una mayor seguridad del paciente ( 57-59 ) . Los artículos revisados demuestran las diversas aplicaciones de la IA ( 60 ), desde el descubrimiento de fármacos ( 31-34 ) y el manejo de enfermedades crónicas ( 61 ) hasta la asistencia quirúrgica ( 62-66 ) y las imágenes médicas ( 67-69 ) . A medida que la tecnología de la IA continúa evolucionando, su integración en la práctica clínica promete revolucionar la atención al paciente y la gestión de la salud ( 9 , 10 , 46 ).

La IA se utiliza en pruebas de detección de cáncer, como mamografías ( 15 ) y de cáncer de pulmón ( 29 ), para producir resultados más rápidos. En la enfermedad renal crónica, la IA ayuda a predecir el deterioro de la función renal analizando el volumen renal total ( 16 ). La IA también identifica a las personas con riesgo de disfunción ventricular izquierda ( 70 ), incluso sin síntomas notables ( 71 ). Además, la IA ayuda a controlar enfermedades crónicas como el asma ( 47 ), la diabetes ( 48 ) y la hipertensión arterial ( 49 ) conectando a los pacientes con pruebas y terapias pertinentes ( 46 ).

El papel de la IA se extiende a la predicción de brotes de enfermedades ( 72 ) y a la ayuda en la comunicación ( 73 ) y la toma de decisiones ( 74 ) para prevenir la propagación ( 75 , 76 ). También ha demostrado una mayor precisión que los métodos de patología tradicionales para predecir las tasas de supervivencia del mesotelioma maligno ( 14 ) y mejorar la precisión de la colonoscopia ( 77 ) al identificar pólipos de colon ( 78 ).

La IA, junto con la optimización de algoritmos y los experimentos de alto rendimiento, ha permitido el descubrimiento rápido de nuevos productos químicos ( 31 , 32 , 35-37 ) y materiales ( 38 ). Los sistemas de experimentación autónomos, impulsados por IA, mejoran la investigación y el desarrollo al ejecutar numerosos experimentos químicos de forma autónoma ( 39-41 ) .

Un avance notable fue el descubrimiento de un inhibidor de la proteína quinasa, diseñado mediante IA, que entró en ensayos clínicos por sus propiedades antitumorales ( 17 ). El estudio utilizó AlphaFold ( 42 ), un programa de IA para la predicción de la estructura de proteínas ( 43 ), integrado con un motor biocomputacional y una plataforma de química generativa para identificar nuevos fármacos para el carcinoma hepatocelular.

Se espera que los sistemas de experimentación autónomos impulsados por IA tengan un impacto significativo en la investigación biomédica, en particular en el descubrimiento de fármacos y la ingeniería de sistemas moleculares ( 44 , 45 ).

Transformaciones impulsadas por IA en la gestión hospitalaria

La IA ha sido fundamental en la transformación de la gestión hospitalaria al mejorar la eficiencia operativa y la asignación de recursos. La literatura revisada indica que los sistemas impulsados por IA automatizan tareas administrativas rutinarias como la programación, la facturación y el mantenimiento de registros, reduciendo así las cargas administrativas y minimizando los errores ( 11 , 18 , 20 , 60 , 79-82 ) . Las herramientas de IA analizan grandes conjuntos de datos para proporcionar recomendaciones basadas en evidencia y análisis predictivos, lo que permite a los administradores de hospitales optimizar la asignación de recursos, pronosticar el flujo de pacientes y mejorar la gestión de la fuerza laboral ( 6 , 9 , 12 , 26 ). Por ejemplo, las aplicaciones de IA en la programación del personal y la planificación de la capacidad han contribuido a mejorar la productividad y la atención al paciente ( 19 , 83 ).

Además, la IA se ha utilizado para mejorar la gestión de datos de pacientes, garantizando el manejo seguro de los registros médicos electrónicos (HCE) y el cumplimiento normativo ( 20 , 21 , 80 ) . El análisis predictivo ayuda a identificar riesgos de incumplimiento y a prevenir errores costosos ( 84-88 ). En general, la integración de la IA en la gestión hospitalaria permite optimizar los procesos, ahorrar costes y mejorar la experiencia del paciente ( 6 , 11 , 60 ).

La integración de soluciones impulsadas por IA en la gestión hospitalaria está transformando significativamente las operaciones ( 11 , 19 , 89 , 90 ). Las tecnologías de IA automatizan tareas repetitivas como la programación ( 79 ), la facturación ( 18 ) y el mantenimiento de registros ( 20 , 80 ), lo que ayuda a reducir las cargas administrativas ( 60 ) y minimizar los errores ( 81 , 82 ). Las herramientas de IA son capaces de analizar grandes conjuntos de datos rápidamente ( 91 ), proporcionar recomendaciones basadas en evidencia ( 92 ) e identificar patrones que pueden no ser obvios para los profesionales de la salud ( 93 ). Además, estas herramientas ayudan a reconocer los riesgos de cumplimiento ( 84 ) y las anomalías en la facturación ( 94 ) y la codificación, lo que garantiza que los centros de salud sigan cumpliendo con las regulaciones ( 21 ) y eviten errores costosos ( 95 ). Al optimizar los procesos ( 96 ) y disminuir las cargas de trabajo manuales ( 97-99 ), la IA mejora la eficiencia ( 100 , 101 ) y puede generar ahorros de costos sustanciales para los hospitales ( 102 ). Las herramientas de análisis predictivo pueden identificar áreas de posible cumplimiento ( 85 , 86 ) y riesgo de auditoría ( 87 ), lo que permite medidas proactivas para mitigar errores costosos ( 88 , 103 ). En general, los sistemas impulsados por IA reducen significativamente la probabilidad de error humano ( 104 ), mejoran la productividad y liberan al personal para que se concentre en responsabilidades de mayor valor, incluida la detección y prevención del fraude en la atención médica ( 105 ).

Los sistemas de IA han demostrado su eficiencia en la revisión de EHR ( 106 ) y la actualización de las pautas de tratamiento ( 107 ), acelerando significativamente el procesamiento de la información de atención médica ( 108 ). Las técnicas de ML se están aprovechando para analizar datos no estructurados ( 109 ), mejorando la toma de decisiones ( 110 ) y la eficiencia operativa en las organizaciones de atención médica ( 111 ). Las diversas aplicaciones de IA se extienden al diagnóstico de pacientes ( 112 , 113 ) , la transcripción de documentos médicos ( 114 ) y el desarrollo de fármacos ( 17 , 30-45 ), con varios tipos de IA como las redes neuronales ( 115 , 116 ) y el procesamiento del lenguaje natural ( 117 , 118 ) que desempeñan un papel en la gestión de la atención médica ( 11 , 20 , 26 , 57 , 79 , 80 , 119 ). Por último, los avances impulsados por IA prometen mejorar la atención médica con tecnologías como las exploraciones por resonancia magnética (IRM) de cuerpo entero ( 120-122 ) para exámenes preventivos ( 123-125 ) y el potencial de mejorar significativamente la productividad del proveedor al tiempo que se reducen los costos ( 126-128 ).

La IA también ha demostrado potencial para ayudar en la optimización personalizada del flujo de pacientes ( 129 , 130 ), la planificación predictiva de la capacidad ( 131 ) y las herramientas avanzadas de gestión de la fuerza laboral ( 11 ). Los algoritmos de programación de IA se están aprovechando para personalizar las rutas de los pacientes individuales en tiempo real ( 132 ), teniendo en cuenta los perfiles específicos de los pacientes y los cronogramas de tratamiento ( 133 ), lo que puede reducir la duración de la estancia y mejorar el rendimiento de los pacientes ( 19 ). Estudios recientes han destacado el potencial de la IA para predecir y gestionar la demanda máxima integrando datos hospitalarios con factores externos como eventos sociales ( 134 ), patrones estacionales ( 135 , 136 ) y tendencias epidemiológicas ( 137 ), lo que permite a los administradores implementar recursos de forma más eficaz ( 89 ). La integración de modelos de aprendizaje de refuerzo para la gestión de la cadena de suministro de inventario y productos farmacéuticos está permitiendo a los hospitales predecir la escasez y los excedentes ( 138 ), manteniendo niveles óptimos de existencias sin sobrecargar sus sistemas de almacenamiento ( 90 ). La asignación de personal también se ha mejorado, gracias a que la IA identifica patrones de agotamiento del personal ( 99 , 139 , 140 ) y sugiere horarios de rotación óptimos para minimizar la fatiga ( 26 , 83 ). Gracias a la capacidad de aprender y adaptarse constantemente a partir de la evolución de los datos, el papel de la IA en la gestión hospitalaria está trascendiendo la automatización básica de tareas hacia la toma de decisiones y la planificación estratégica ( 60 , 141 ), mejorando en última instancia la resiliencia operativa y la atención centrada en el paciente ( 142 , 143 ).

Perspectivas basadas en IA para políticas sanitarias

En el contexto de las políticas sanitarias, la IA ofrece nuevas oportunidades para la formulación de políticas basadas en la evidencia, la obtención de información basada en datos y la promoción de la equidad en la salud. La literatura destaca que la IA facilita la recopilación y el análisis precisos de datos, lo que respalda la formulación de políticas sanitarias eficaces ( 6 , 12 , 13 , 144 ). Los modelos de IA ayudan a los responsables de las políticas a simular posibles resultados de políticas y a ajustar las estrategias en respuesta a las crisis sanitarias emergentes, como la preparación para pandemias y la distribución de vacunas ( 23 , 145 ). Además, la IA ayuda a identificar las disparidades en la atención sanitaria mediante el análisis de patrones en los datos sanitarios, lo que orienta las intervenciones para abordar las desigualdades sistémicas y mejorar el acceso a los servicios de atención sanitaria ( 7 , 22 , 24 , 146 ).

La IA está cambiando la formulación de políticas sanitarias al brindar nuevas oportunidades para abordar desafíos sanitarios complejos de forma más eficaz. Por ejemplo, la integración de la IA en las políticas sanitarias ha permitido una recopilación y un análisis de datos más precisos, lo que apoya directamente la formulación de políticas basadas en la evidencia ( 144 ). Al automatizar el análisis de datos sanitarios, la IA reduce el error humano y proporciona información en tiempo real que permite a los responsables políticos ajustar las estrategias con rapidez, como al responder a crisis sanitarias emergentes ( 145 ). Esta capacidad es especialmente crucial para abordar preocupaciones de salud pública como la preparación ante pandemias y la distribución de vacunas ( 23 ), ya que los modelos de IA pueden optimizar la logística y la asignación de recursos ( 147 ). Sin embargo, desafíos como la privacidad de los datos y las cuestiones éticas, incluida la garantía del cumplimiento de normativas como el Reglamento General de Protección de Datos (RGPD) ( 148 ), siguen siendo fundamentales en los debates sobre políticas, lo que requiere marcos de gobernanza de la IA bien estructurados ( 7 ).

La IA también contribuye a políticas sanitarias más equitativas al descubrir disparidades en la atención médica ( 22 ). Los algoritmos de ML pueden identificar patrones en los datos de atención médica, revelando brechas en la prestación de servicios a poblaciones marginadas ( 24 ), que luego pueden abordarse mediante intervenciones sanitarias específicas ( 146 ). Por ejemplo, la capacidad de la IA para analizar grandes conjuntos de datos permite la identificación de determinantes sociales de la salud ( 149 ), lo que guía a los responsables de las políticas en la formulación de políticas más inclusivas que aborden las desigualdades sistémicas ( 7 ). Además, los conocimientos impulsados por la IA ayudan a desarrollar políticas proactivas destinadas a reducir las desigualdades en la atención médica en diferentes grupos demográficos ( 24 , 150 ), lo que garantiza que los recursos se asignen donde más se necesitan ( 151 ) en función de las tendencias y los resultados emergentes ( 152 ).

Además, la IA desempeña un papel fundamental en la evaluación de la eficacia de las políticas sanitarias. A través del modelado predictivo, la IA permite a los responsables políticos simular el impacto de los posibles cambios en las políticas antes de su implementación ( 153 ), optimizando así las decisiones y minimizando los riesgos ( 154 ). Este enfoque es particularmente útil para evaluar los efectos a largo plazo de las políticas relacionadas con el manejo de enfermedades crónicas ( 155 ) o las iniciativas de salud pública ( 156 , 157 ). La IA también proporciona un mecanismo de retroalimentación continua, lo que permite ajustar las políticas en tiempo real en función de los resultados sanitarios reales ( 7 ). Sin embargo, las implicaciones legales y éticas de la IA en las políticas sanitarias siguen siendo motivo de preocupación, especialmente en lo que respecta a la rendición de cuentas y la transparencia en los procesos de toma de decisiones, lo que destaca la necesidad de una normativa exhaustiva que guíe el papel de la IA en la formulación de políticas ( 145 ).

A pesar de estos beneficios, las consideraciones éticas relacionadas con la privacidad de los datos, la equidad y el cumplimiento normativo siguen siendo desafíos críticos que deben abordarse para garantizar la integración responsable de la IA en las políticas sanitarias ( 6 , 7 , 145 ). El desarrollo de marcos regulatorios adecuados y la convergencia global en la gobernanza de la IA en la atención médica son pasos esenciales para mitigar los riesgos y aprovechar al máximo el potencial de la IA ( 7 , 158 ).

Desafíos y limitaciones de la IA en la atención médica

En el campo de la atención médica, la integración de sistemas de IA confiables es esencial, particularmente para respaldar los procesos de toma de decisiones clínicas. Estos sistemas de IA aprovechan los datos de los pacientes, incluidas varias formas de imágenes médicas, para ayudar a los profesionales de la salud a diagnosticar y tratar enfermedades de manera más efectiva. Un metaanálisis exhaustivo de las herramientas de IA en la atención médica destaca sus diversas aplicaciones, desde el diagnóstico de enfermedades hasta la educación médica, al tiempo que enfatiza la importancia de abordar las consideraciones éticas en su implementación ( 159 ). Sin embargo, la implementación exitosa de la IA en entornos clínicos requiere un enfoque colaborativo entre los profesionales de la salud y los expertos en IA. No establecer esta colaboración puede conducir a riesgos significativos, incluida la posibilidad de falsos positivos y falsos negativos, que pueden tener consecuencias nefastas para la atención al paciente.

Falsos positivos/negativos en los sistemas de diagnóstico de IA

Cuando un sistema de IA identifica incorrectamente una enfermedad inexistente, puede generar ansiedad innecesaria en los pacientes, pruebas invasivas adicionales y tratamientos potencialmente perjudiciales. Por ejemplo, si un modelo de IA clasifica erróneamente un tumor benigno como maligno, el paciente podría someterse a cirugía o quimioterapia innecesarias, exponiéndolo a los riesgos y efectos secundarios de estas intervenciones sin ningún beneficio real. Esto no solo afecta la salud física del paciente, sino que también puede tener profundas repercusiones psicológicas, generando estrés y una disminución de su calidad de vida.

Por el contrario, un falso negativo se produce cuando un sistema de IA no detecta una enfermedad presente. Esto puede ser especialmente peligroso en casos de enfermedades graves como el cáncer, donde la detección temprana es crucial para un tratamiento eficaz. Si un modelo ignora un tumor maligno, el paciente puede perder la oportunidad de una intervención oportuna, lo que provoca la progresión de la enfermedad y desenlaces potencialmente fatales. Las consecuencias de los falsos negativos pueden ser devastadoras, provocando una pérdida de confianza en los profesionales médicos y el sistema sanitario.

Para mitigar estos riesgos, los profesionales sanitarios deben colaborar estrechamente con expertos en IA que comprendan las complejidades de los algoritmos de aprendizaje automático (ML) y sus limitaciones. Los sistemas de IA no son infalibles; requieren un ajuste, validación y monitorización constantes para garantizar su precisión y fiabilidad. Al colaborar con especialistas en IA, los profesionales sanitarios pueden interpretar mejor la información generada por la IA, comprender el contexto de los datos y tomar decisiones informadas que prioricen la seguridad del paciente. Investigaciones recientes subrayan el potencial de las aplicaciones de IA en la gestión de riesgos clínicos, demostrando su capacidad para mejorar los resultados en materia de seguridad del paciente mediante un mejor apoyo a la toma de decisiones y la prevención de errores ( 160 ).

Además, la integración de la IA en los flujos de trabajo clínicos debe ir acompañada de sólidos programas de formación para los profesionales sanitarios. Esta formación debe centrarse en comprender el funcionamiento de los sistemas de IA, sus posibles dificultades y la importancia de la supervisión humana en el proceso de toma de decisiones. Al fomentar una cultura de colaboración y aprendizaje continuo, las organizaciones sanitarias pueden mejorar la eficacia de las herramientas de IA y minimizar los riesgos asociados a su uso.

Evaluación de la calidad de los datos y validación del modelo

Muchos estudios sobre IA en el ámbito sanitario reportan índices de precisión impresionantemente altos, a menudo superiores al 90%. Sin embargo, sin una adecuada segmentación y validación de los datos, estos resultados pueden ser demasiado optimistas debido al riesgo de sobreajuste. El sobreajuste ocurre cuando un modelo aprende demasiado bien los datos de entrenamiento, incluyendo el ruido, y no funciona adecuadamente con datos nuevos e inéditos.

La correcta división de datos es esencial para desarrollar modelos que se generalicen adecuadamente a datos nuevos e inéditos. Esto implica dividir un conjunto de datos en diferentes subconjuntos, como los conjuntos de entrenamiento, validación y prueba ( 161-163 ) . Una práctica común es dividir el conjunto de datos en un 80 % para entrenamiento y un 20 % para prueba, pero muchos estudios omiten un conjunto de validación independiente. Sin un conjunto de validación, los hiperparámetros pueden ajustarse en función del conjunto de prueba, que debe permanecer intacto hasta la evaluación final. Esta práctica conlleva el riesgo de fuga de datos y sobreajuste, ya que impide la capacidad de detectar el sobreajuste durante el entrenamiento y plantea inquietudes sobre la optimización y el ajuste del modelo ( 164 ).

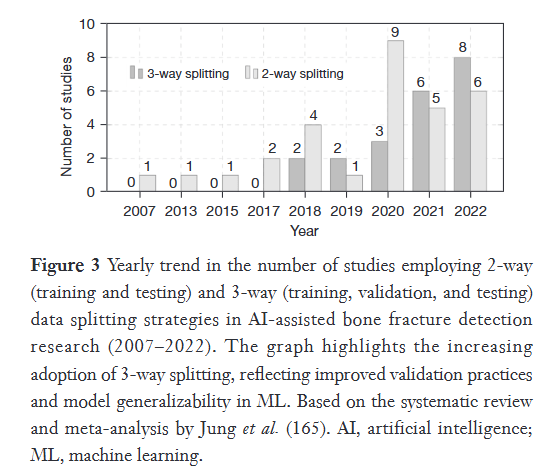

El gráfico de la Figura 3 ilustra el número de estudios publicados anualmente utilizando estrategias de división de datos bidireccionales y tripartitas entre 2007 y 2022. Este gráfico destaca un cambio significativo en el enfoque de la comunidad investigadora respecto a la división de datos en estudios de aprendizaje automático (ML). En años anteriores, en particular entre 2007 y 2017, la mayoría de los estudios empleaban la división bidireccional, donde el conjunto de datos se divide en un conjunto de entrenamiento y un conjunto de prueba. Este método carece de un conjunto de validación, esencial para ajustar los hiperparámetros y evitar el sobreajuste. Sin un conjunto de validación, los modelos podrían no generalizarse adecuadamente a datos no analizados, lo que resulta en un entrenamiento de ML ineficiente.

Figura 3. Tendencia anual en el número de estudios que emplean estrategias de división de datos bidireccionales (entrenamiento y prueba) y tridireccionales (entrenamiento, validación y prueba) en la investigación de detección de fracturas óseas asistida por IA (2007-2022). El gráfico destaca la creciente adopción de la división tridireccional, lo que refleja mejoras en las prácticas de validación y la generalización de modelos en el aprendizaje automático (ML). Basado en la revisión sistemática y el metanálisis de Jung et al. ( 165 ). IA: inteligencia artificial; ML: aprendizaje automático.

A partir de 2018, aproximadamente, el gráfico muestra varios estudios que adoptan la división de tres vías. Este enfoque implica dividir los datos en tres conjuntos: entrenamiento, validación y prueba. El conjunto de validación se utiliza durante el desarrollo del modelo para ajustar los hiperparámetros y seleccionar el mejor modelo antes de la evaluación final en el conjunto de prueba. Para 2022, el número de estudios que utilizan la división de tres vías supera a los que utilizan la división de dos vías, lo que indica una tendencia positiva hacia prácticas de aprendizaje automático más robustas.

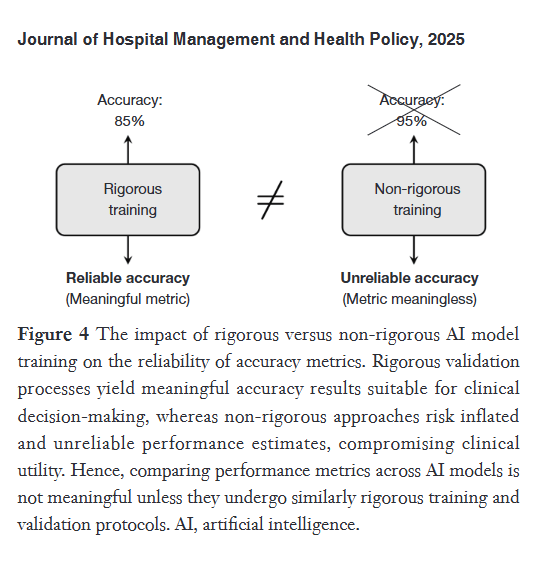

La creciente adopción de la división de 3 vías refleja una mayor conciencia de las trampas del sobreajuste y la importancia de la validación del modelo. Sin un conjunto de validación, existe el riesgo de ajustar inadvertidamente el modelo para que funcione bien en el conjunto de prueba, lo que puede llevar a estimaciones de rendimiento demasiado optimistas y una generalización deficiente ( 162 , 163 , 166 ). Cuando los estudios no demuestran que sus modelos están correctamente convergidos y bien validados, se vuelve difícil confiar en las métricas informadas ( Figura 4 ). Esto se debe a que puede ocurrir sobreajuste, donde el modelo se ajusta demasiado a los datos de entrenamiento y no se generaliza a datos nuevos no vistos. Sin prácticas de validación robustas, como el uso de un conjunto de validación separado para monitorear el rendimiento del modelo durante el entrenamiento, el sobreajuste puede pasar desapercibido. En consecuencia, la alta precisión informada puede no reflejar el verdadero rendimiento del modelo en aplicaciones del mundo real, lo que socava la confiabilidad de los hallazgos del estudio ( 167-169 ) . Por lo tanto, es esencial que los estudios adopten estrategias de validación adecuadas para garantizar que sus modelos se generalicen bien y que las métricas informadas sean confiables.

Figura 4. Impacto del entrenamiento riguroso y no riguroso de modelos de IA en la fiabilidad de las métricas de precisión. Los procesos de validación rigurosos producen resultados de precisión significativos, adecuados para la toma de decisiones clínicas, mientras que los enfoques no rigurosos conllevan el riesgo de estimaciones de rendimiento infladas y poco fiables, lo que compromete la utilidad clínica. Por lo tanto, comparar las métricas de rendimiento entre modelos de IA no es significativo a menos que se sometan a protocolos de entrenamiento y validación igualmente rigurosos. IA, inteligencia artificial.

Además, sin probar en datos externos, no se puede evaluar la generalización del modelo. Los datos de los pacientes pueden variar significativamente entre individuos debido a diferencias en la fisiología, la colocación de los dispositivos, la geografía, la socioeconomía, las características del ruido y muchos otros factores. Un modelo que se generaliza bien debe funcionar de manera consistente en diversos conjuntos de datos. Sin embargo, muchos estudios no incluyen el uso de un conjunto de prueba externo (o conjunto de retención) ( 170 ). Un conjunto de prueba externo, idealmente obtenido de un conjunto de datos diferente o recopilado en diferentes condiciones, es vital para evaluar la generalización del modelo. Sin él, los modelos pueden funcionar bien en un conjunto de datos específico, pero no generalizarse a datos de diferentes poblaciones de pacientes o entornos de registro. Por lo tanto, al no incluir un conjunto de prueba externo, es difícil determinar cómo funcionaría el modelo propuesto en entornos clínicos del mundo real.

Además, muchos modelos de IA, especialmente los modelos de aprendizaje profundo, a menudo se consideran «cajas negras», lo que dificulta la interpretación de su proceso de toma de decisiones. Esta falta de transparencia puede obstaculizar la adopción clínica ( 171-173 ). Integrar herramientas de IA en flujos de trabajo clínicos existentes puede ser un desafío, lo que requiere cambios en la forma en que operan los profesionales de la salud. Existe la necesidad de métricas de rendimiento estandarizadas para evaluar y comparar diferentes modelos de IA de manera efectiva. Los estudios actuales a menudo utilizan métricas variadas, lo que dificulta la evaluación de su rendimiento relativo ( 174 , 175 ) . La Tabla 3 resume los desafíos clave en la adopción de IA en la atención médica y proporciona recomendaciones para abordar estos problemas.

Tabla 3

Resumen de los desafíos clave en la adopción de IA en la atención médica y recomendaciones para abordarlos

| Desafío | Recomendaciones para abordar el desafío |

|---|---|

| Disponibilidad limitada de datos anotados de alta calidad | Invierta en la creación de conjuntos de datos completos, diversos y bien anotados. Garantice el preprocesamiento y la estandarización de los datos para mejorar el rendimiento del modelo. |

| Sobreajuste y diseño de modelos subóptimos | Desarrolle arquitecturas de IA robustas con técnicas como la normalización por lotes, la eliminación de capas y la regularización para evitar el sobreajuste. Utilice la validación cruzada para garantizar la fiabilidad del modelo. |

| Divisiones sesgadas de conjuntos de datos que afectan la confiabilidad | Emplear estrategias rigurosas de división de datos, como la validación cruzada de K-fold, para garantizar conjuntos de datos de entrenamiento, validación y prueba equilibrados y representativos. |

| Falta de generalización a datos no vistos | Realizar una validación externa en conjuntos de datos independientes para confirmar la aplicabilidad del modelo en diversos entornos clínicos y poblaciones de pacientes. |

| Garantizando un alto rendimiento y fiabilidad | Establecer métricas de desempeño estandarizadas (por ejemplo, sensibilidad, especificidad, precisión) y realizar pruebas rigurosas en conjuntos de datos externos para validar el desempeño del modelo. |

| Integración en los flujos de trabajo clínicos | Centrarse en herramientas de IA fáciles de usar que se adapten a los flujos de trabajo clínicos existentes. Involucrar a los profesionales sanitarios en el proceso de diseño e implementación para garantizar una integración fluida. |

| Interpretabilidad y transparencia del modelo | Desarrollar modelos de IA explicables (XAI) que proporcionen información clara sobre los procesos de toma de decisiones. Esto contribuirá a generar confianza entre los profesionales clínicos y a mejorar su adopción. |

| Preocupaciones éticas y regulatorias | Abordar cuestiones éticas como la privacidad de los datos, los sesgos y la equidad. Establecer marcos regulatorios claros para garantizar el uso responsable de la IA en la atención médica. |

La tabla destaca las limitaciones de la IA en la atención médica, incluyendo la calidad de los datos, la interpretabilidad de los modelos, la generalización y la integración en los flujos de trabajo clínicos. IA, inteligencia artificial.

Al abordar aspectos críticos de la IA en la atención médica, esta revisión destaca la importancia de desarrollar sistemas de IA confiables que puedan integrarse eficazmente en la práctica clínica. Enfatiza la necesidad de una validación rigurosa, transparencia y consideraciones éticas para garantizar que las herramientas de IA sean efectivas y confiables. Las secciones posteriores proporcionan una descripción detallada de las implicaciones de estos desafíos y analizan el futuro de la IA en la atención médica. Una revisión reciente describe la rápida evolución de las tecnologías de IA en la atención médica, enfatizando su potencial transformador y enfatizando la necesidad de una implementación responsable para garantizar la seguridad del paciente y el cumplimiento ético ( 176 ).

La integración de la IA en la atención médica presenta numerosos desafíos que deben abordarse para garantizar su eficacia y ética. Una de las principales limitaciones es la disponibilidad limitada de datos anotados de alta calidad, esencial para el entrenamiento de modelos de IA fiables. Sin conjuntos de datos completos y diversos, los sistemas de IA pueden tener dificultades para generalizarse en diferentes poblaciones de pacientes y entornos clínicos. Además, el sobreajuste sigue siendo un problema importante: los modelos funcionan bien con los datos de entrenamiento, pero no se generalizan a datos nuevos e inéditos. Esto se puede mitigar mediante un diseño robusto de modelos y técnicas de validación cruzada. Otro problema crítico es la falta de generalización de los modelos de IA. Muchos modelos se entrenan con conjuntos de datos específicos y pueden no funcionar bien al aplicarse a diferentes entornos sanitarios o grupos demográficos de pacientes. La validación externa con conjuntos de datos independientes es crucial para confirmar la aplicabilidad del modelo en diversos entornos clínicos. Asimismo, garantizar un alto rendimiento requiere el establecimiento de métricas de rendimiento estandarizadas y protocolos de prueba rigurosos para validar la fiabilidad del modelo.

La integración en los flujos de trabajo clínicos es otro gran reto. Las herramientas de IA deben diseñarse para alinearse con las prácticas y flujos de trabajo clínicos existentes y garantizar una adopción fluida por parte de los profesionales sanitarios. Esto requiere la colaboración entre desarrolladores de IA y profesionales sanitarios para crear herramientas intuitivas que optimicen, en lugar de interrumpir, los procesos clínicos. La interpretabilidad de los modelos también supone un obstáculo importante para la adopción de la IA en el ámbito sanitario. Muchos modelos de IA, en particular los de aprendizaje profundo, se consideran a menudo «cajas negras», lo que dificulta que los profesionales sanitarios comprendan y confíen en sus procesos de toma de decisiones. El desarrollo de modelos de IA explicables (XAI) que proporcionen información clara sobre cómo se toman las decisiones puede contribuir a generar confianza y mejorar la adopción.

Finalmente, se deben abordar las preocupaciones éticas y regulatorias para garantizar el uso responsable de la IA en la atención médica. Cuestiones como la privacidad de los datos, el sesgo y la equidad deben gestionarse con cuidado, y se deben establecer marcos regulatorios claros para guiar el desarrollo y la implementación de los sistemas de IA. Una revisión sistemática destaca que las fuentes de datos sesgadas y la representación insuficiente en los conjuntos de datos de entrenamiento de IA pueden exacerbar las desigualdades en la prestación de atención, lo que subraya la necesidad de enfoques más inclusivos en el desarrollo de la IA en la atención médica ( 177 ). Por el contrario, una revisión de alcance sugiere métodos para abordar los desafíos éticos y sociales asociados con la IA en la atención médica, proporcionando información sobre estrategias para la integración responsable ( 178 ).

Desafíos en la comparabilidad entre estudios

Una limitación metodológica persistente en la evaluación del rendimiento clínico de la IA reside en la práctica errónea de comparar métricas de precisión entre estudios. Dichas comparaciones carecen de validez porque la mayoría de los modelos de IA se desarrollan sin adherirse a marcos de validación estandarizados, como los que se describen en la guía de la Administración de Alimentos y Medicamentos (FDA) emitida recientemente ( 179 ). Esta guía enfatiza la documentación rigurosa de los procesos de desarrollo de modelos (incluyendo la justificación de las elecciones algorítmicas, la procedencia y el preprocesamiento de los datos de entrenamiento, los protocolos de división de conjuntos de datos, el proceso de evaluación del modelo y las estrategias de validación externa); sin embargo, pocos estudios reconocen esta guía y mucho menos la cumplen. Sin transparencia en estas áreas, las métricas informadas corren el riesgo de mezclar la generalización genuina con resultados artefactos de sobreajuste, fuga de datos o validación sesgada. Por ejemplo, un modelo que afirma una precisión del 98% después de una validación cruzada incorrecta en datos no representativos puede parecer superior a una contraparte rigurosamente validada probada en diversas cohortes, pero su utilidad clínica se ve fundamentalmente comprometida. Esta variabilidad dificulta la distinción entre avances reproducibles y afirmaciones exageradas, sobre todo cuando los estudios omiten análisis de modos de fallo o pasos de calibración. Hasta que se generalicen los informes estandarizados, alineados con los estándares regulatorios, las comparaciones de rendimiento entre estudios siguen siendo, en el mejor de los casos, especulativas y, en el peor, clínicamente engañosas, lo que dificulta la identificación de herramientas de IA verdaderamente eficaces para la implementación en el ámbito sanitario.

Discusión

La integración de la IA en la atención médica va más allá de la mera tecnología y abarca importantes consideraciones morales y éticas ( 180 , 181 ). Para hacer que la IA sea más transparente, regulada y utilizable, la IA explicable sirve como un avance fundamental en los modelos de ML, mejorando su claridad y aplicabilidad en varios dominios ( 182 , 183 ). En el panorama regulatorio global actual, la mayoría de las regulaciones que rigen la IA se centran principalmente en el software como dispositivo médico, que cae dentro de la categoría de productos de salud digitales ( 158 ). Sin embargo, es crucial reconocer que estas regulaciones existentes pueden ser insuficientes. Las tecnologías de IA poseen la capacidad de operar de forma autónoma, adaptar sus algoritmos y mejorar su rendimiento con el tiempo en función de los nuevos datos del mundo real que encuentran. Para abordar estos desafíos, sería ventajoso establecer una convergencia regulatoria global para la IA en la atención médica. Este enfoque podría reflejar el código de conducta voluntario de IA que está desarrollando el Consejo de Comercio y Tecnología de EE. UU. y la UE ( 184 ). El uso de IA para la toma de decisiones presenta desafíos éticos debido a sus características complejas, que pueden resultar en errores, una pérdida de control humano y dificultades para asignar responsabilidad, lo que lleva a la necesidad de una evaluación cuidadosa de los costos y beneficios en situaciones de alto riesgo ( 185 ). La integración de IA en la atención médica plantea preocupaciones sobre la imposición injusta de responsabilidad legal a los médicos por errores y resultados adversos, ya que pueden ser considerados responsables de fallas del sistema sobre las cuales tienen un control limitado ( 186 ). Para abordar las complejidades de la responsabilidad en los sistemas de atención médica integrados con IA, se han propuesto varias soluciones potenciales. Estas incluyen reconocer que la responsabilidad no debe recaer únicamente en los médicos, ya que muchas personas participan en el diseño, la implementación y el funcionamiento de la IA. Se ha sugerido la agrupación de riesgos entre los médicos y las empresas de desarrollo de software a través de planes de seguros para cubrir los daños relacionados con la IA ( 187 ). Además, existe un llamado a un cambio en la forma en que se tratan legalmente los sistemas de IA, posiblemente viéndolos como parte del equipo clínico en lugar de meros productos ( 188 ), lo que podría ayudar a aclarar la responsabilidad. Sin embargo, los marcos legales actuales presentan desafíos significativos, lo que dificulta establecer una responsabilidad clara por errores relacionados con la IA. Por lo tanto, un marco de validación estandarizado para los modelos clínicos de IA es importante para establecer una rendición de cuentas clara, aumentar la confianza y facilitar el cumplimiento normativo en las aplicaciones sanitarias.

Marco de validación estandarizado para modelos de IA clínica

El diagrama en la Figura 5 ilustra un marco de validación estandarizado para modelos clínicos de IA alineados con la guía de la FDA ( 179 ), que aborda fallas metodológicas críticas en las comparaciones de desempeño entre estudios. El flujo de trabajo comienza definiendo la pregunta clínica de interés y delimitando rigurosamente el contexto de uso (COU) de la IA; especificando las poblaciones objetivo, el alcance de la toma de decisiones y las limitaciones operativas. Estos pasos iniciales informan una evaluación de la matriz de riesgos que combina la influencia del modelo (el impacto relativo de la IA en las decisiones) y la consecuencia de la decisión (daño potencial de los errores), determinando si la estratificación del riesgo produce clasificaciones de riesgo de modelo alto, medio o bajo. Después del perfil de riesgo, el marco exige la creación de un plan de credibilidad con cinco componentes interrelacionados: justificación de las opciones de arquitectura algorítmica en relación con los requisitos del COU, documentación de la procedencia de los datos de entrenamiento incluyendo estrategias de mitigación de sesgo, protocolos predefinidos de división de conjuntos de datos para prevenir fugas, métricas de evaluación con cuantificación de la incertidumbre y estrategias prospectivas de validación externa. Las dependencias verticales conectan estos componentes; Las opciones de algoritmo dictan el preprocesamiento de datos requerido, que informa las reglas de división de la validación, lo que a su vez configura las métricas de rendimiento y los parámetros de prueba externos. La ejecución de este plan alimenta la documentación formal de desviaciones y resultados, que culmina en decisiones de adecuación de go/no-go. Los elementos de bucle cerrado refuerzan la trazabilidad, requiriendo actualizaciones a las definiciones de COU si ocurre un reentrenamiento del modelo. Al institucionalizar la presentación de informes transparentes de flujos de trabajo de datos, límites de validación y análisis de modos de fallo, este marco contrarresta directamente los riesgos de sobreajuste de las afirmaciones debido a una validación cruzada incorrecta, efectos de lote en datos de entrenamiento no representativos e inflación del rendimiento mediante un ajuste incontrolado de hiperparámetros. La progresión horizontal desde la definición del problema, pasando por la estratificación de riesgos, hasta la documentación del ciclo de vida crea cadenas de evidencia auditables, lo que permite una comparación significativa de herramientas de IA en diferentes estudios, a la vez que cumple con los nuevos estándares regulatorios para la validación clínica de IA.

Figura 5. Este flujo de trabajo describe un enfoque sistemático para validar modelos de IA en el ámbito sanitario, con énfasis en el cumplimiento normativo y el rigor metodológico. A partir de la definición de la pregunta clínica y el CDU, el marco avanza a través de la estratificación del riesgo (combinando la influencia del modelo y las consecuencias de la decisión) y el desarrollo de un plan de credibilidad. Los componentes críticos incluyen la justificación algorítmica, la procedencia de los datos de entrenamiento, los protocolos de división de conjuntos de datos, las métricas de evaluación y las estrategias de validación externa. El marco exige la documentación de las desviaciones y culmina en una decisión de aprobación o rechazo para la implementación clínica. Diseñado para abordar los desafíos de la comparabilidad entre estudios, garantiza la transparencia, mitiga los riesgos de sobreajuste y fuga de datos, y fortalece la reproducibilidad, lo que permite una evaluación significativa de la utilidad clínica y la alineación normativa de las herramientas de IA. IA, inteligencia artificial; CDU, contexto de uso.

Preparando a los futuros profesionales de la salud para una era impulsada por la IA

Afortunadamente, las facultades de medicina están reconociendo la importancia de preparar a los futuros profesionales de la salud para esta nueva era. Muchas instituciones están integrando proactivamente la educación en IA en sus planes de estudio, asegurando que los estudiantes cuenten con los conocimientos y las habilidades necesarias para abordar las complejidades de la IA en la práctica clínica. Al incorporar la IA en la educación médica, los estudiantes aprenden cómo funcionan estos sistemas, incluyendo los algoritmos y las entradas de datos que impulsan su funcionalidad. Este conocimiento fundamental es esencial para interpretar con precisión los conocimientos generados por la IA y tomar decisiones clínicas informadas. La educación en IA también incluye debates sobre sus limitaciones y posibles sesgos. Comprender estos factores ayuda a los futuros profesionales de la salud a evaluar críticamente las recomendaciones de IA y a evitar la dependencia excesiva de la tecnología, que puede conducir a errores en el diagnóstico y el tratamiento. Los programas de capacitación deben enfatizar la importancia de la supervisión humana en el proceso de toma de decisiones. Los estudiantes aprenden que, si bien la IA puede mejorar la precisión y la eficiencia del diagnóstico, debe complementar, no reemplazar, la experiencia y el criterio de los profesionales de la salud. Al fomentar una mentalidad colaborativa, las facultades de medicina preparan a los estudiantes para trabajar junto a expertos en IA y científicos de datos ( 189 ). Este enfoque interdisciplinario es vital para optimizar el uso de la IA en entornos clínicos y garantizar que la atención al paciente siga siendo el enfoque principal. Una revisión sistemática reciente enfatizó el papel crucial de los organismos reguladores en el desarrollo de competencias en IA entre los profesionales de la salud, destacando la necesidad de programas de capacitación integrales para garantizar la integración efectiva de la IA en la práctica clínica ( 190 ). El campo de la IA está evolucionando rápidamente y la educación continua es necesaria para mantenerse al día con los nuevos desarrollos. Las facultades de medicina tradicionalmente inculcan una cultura de aprendizaje continuo, animando a los futuros profesionales de la salud a mantenerse informados sobre los avances en la tecnología sanitaria y sus aplicaciones en la medicina.

Fortalezas y limitaciones de esta revisión

Esta revisión adopta un enfoque metodológicamente riguroso para evaluar el papel de la IA en los sistemas de salud contemporáneos. La estrategia de búsqueda, realizada en seis bases de datos académicas (PubMed/Medline, Scopus, EMBASE, Web of Science, Google Scholar, ResearchGate), priorizó los estudios recientes revisados por pares publicados a partir de 2023, lo que garantiza la alineación con los avances de la IA en rápida evolución. Exigir números DOI para todos los artículos incluidos mejoró la trazabilidad y la credibilidad académica, a la vez que redujo la dependencia de fuentes no reproducibles. El análisis sintetiza de forma única el impacto de la IA en tres dominios interconectados: práctica clínica, gestión hospitalaria y política sanitaria. Clínicamente, la revisión documenta el potencial transformador de la IA para acelerar el descubrimiento de fármacos a través de sistemas de experimentación autónomos ( 30-37 ) y mejorar la gestión de enfermedades crónicas mediante análisis predictivos ( 46-49 ). Operativamente, destaca la capacidad de la IA para optimizar los flujos de trabajo hospitalarios, como la gestión del flujo de pacientes en tiempo real ( 129-131 ) y los modelos predictivos de dotación de personal para reducir el agotamiento ( 139 , 140 ). En cuanto a las políticas, la revisión explora cómo las simulaciones basadas en IA permiten la toma de decisiones basada en la evidencia para la preparación ante pandemias y la asignación equitativa de recursos ( 23 , 145 ). Al interconectar las innovaciones técnicas con las reformas sistémicas, este trabajo cierra la brecha entre la promesa teórica de la IA y sus aplicaciones prácticas en la atención médica.

A pesar de su alcance, esta revisión identifica desafíos críticos inherentes a la adopción de IA. La confiabilidad diagnóstica sigue siendo precaria debido a los riesgos de falsos positivos (p. ej., intervenciones innecesarias de tumores benignos mal clasificados) y falsos negativos (neoplasias malignas no detectadas), que surgen de datos de entrenamiento sesgados o de una colaboración insuficiente entre el médico y la IA. Las deficiencias de validación socavan aún más la confianza: muchos estudios informan métricas de precisión infladas (95-100 %) pero carecen de cohortes de pruebas externas, lo que genera inquietudes sobre el sobreajuste y la generalización en el mundo real. La demografía heterogénea de los pacientes y los problemas de interoperabilidad de los dispositivos agravan estos desafíos, en particular en los modelos de IA que analizan poblaciones socioeconómicamente diversas. Si bien la revisión analiza las tensiones éticas, como el riesgo de que los médicos se vuelvan responsables de errores inducidos por la IA ( 185 ) y los desafíos para establecer marcos de responsabilidad adecuados ( 186 ), persisten preguntas sin resolver sobre el acceso equitativo a la atención impulsada por la IA en las comunidades marginadas. Por último, el enfoque en la literatura posterior a 2023, si bien garantiza la actualidad, puede subrepresentar los conocimientos longitudinales sobre el cambiante panorama regulatorio de la IA.

Conclusiones

La integración de la IA en la atención médica está marcando una nueva era en la práctica médica, la gestión hospitalaria y las políticas sanitarias. Esta revolución tecnológica está mejorando significativamente la precisión diagnóstica, la eficiencia operativa y la toma de decisiones basada en la evidencia. Al aprovechar las capacidades de la IA, los profesionales sanitarios pueden ofrecer recomendaciones de tratamiento personalizadas, lo que se traduce en mejores resultados para los pacientes. Además, la implementación de la IA en las operaciones hospitalarias, mediante la automatización y el análisis predictivo, está permitiendo procesos más eficientes. Estos avances no son solo mejoras incrementales, sino que representan un cambio fundamental en la prestación y la gestión de la atención médica.

Sin embargo, es importante reconocer que el camino hacia la plena integración de la IA en la atención médica no está exento de desafíos. Las preocupaciones éticas, en particular las relacionadas con la privacidad de los datos y la posibilidad de errores de diagnóstico, subrayan la necesidad de una validación robusta de los modelos y una implementación cuidadosa. Para abordar estas complejas cuestiones, es esencial una estrecha colaboración entre los profesionales sanitarios y los expertos en IA. Además, el establecimiento de marcos regulatorios integrales y la incorporación de la formación en IA en los programas de formación médica son pasos vitales para garantizar el uso responsable de esta tecnología. Al abordar estos desafíos, el sector sanitario puede aprovechar al máximo el potencial de la IA, manteniendo al mismo tiempo los altos estándares de atención al paciente y la práctica ética.