Autor: Carlos Alberto Díaz. Profesor Titular de la Universidad ISALUD. Agradecimiento al CoDirector de la diplomatura en Seguridad de Paciente El Dr. Fabían Vitolo.

Entender, interpretar, la causa de las causas de los eventos adversos en la seguridad de los pacientes, ayuda a quienes hacemos gestión en actuar en los equipos de salud y sus integrantes. En evitar comportamientos y abordajes erróneos. El diseño de los procesos, las respuestas, los controles, la cultura. Se inicia el análisis por los caminos tradicionales, para luego incorporar la seguridad II.

En la diplomatura de Seguridad de Pacientes de la universidad ISALUD, cuando damos la clase sobre este tema proyectamos un cortometraje: Creemos en nuestra capacidad de atención, y suponemos que nada importante se nos puede estar escapando. El test desarrollado por Chabris y Simons, y tan difundido en Internet del gorila invisible (www.theinvisiblegorilla.com) pone en entredicho este supuesto. Puestos a contar cuántos pases de pelota se hacen entre sí los integrantes de un equipo de basquetbol, la mitad de nosotros no reparará en la aparición entre los jugadores de un extraño disfrazado de gorila. Este porcentaje de fracaso es independiente de sexo, edad, nivel socioeconómico, etc. Y es que la atención es un juego de suma cero: la atención específicamente dirigida en un sentido genera ceguera por falta de atención hacia el resto de las cosas. Todos recordamos ejemplos de hallazgos de cosas que “siempre estuvieron allí”. Los ejemplos más sonoros vienen del campo de las imágenes, no porque los dedicados a ese tipo de estudios tengan mayor proporción de falla, sino justamente porque los resultados de su práctica quedan congelados en el tiempo, y a ellos podemos volver una y otra vez.

«Vemos lo que esperamos ver, vemos lo que “queremos” ver. Suelo citar un ejemplo que me toca de cerca. Recibimos un paciente con cuadro de palpitaciones muy rápidas. El médico de la ambulancia vio en el monitor taquicardia ventricular. Al momento del examen se encuentra en ritmo sinusal. Tiene antecedente de arritmia ventricular compleja, y enfermedad coronaria conocida. Una nueva coronariografía no revela lesión actual que justifique origen isquémico de la arritmia; en el ecocardiograma diámetros y función del ventrículo izquierdo son normales. Decidimos avanzar con una resonancia magnética cardíaca, en busca de un sustrato de fibrosis o infiltración que explique todo; y el operador señala que es cierto, que el ventrículo izquierdo es normal y no hay hallazgo patológico de importancia, pero que el derecho está dilatado, disfuncionante y con trombo. Revisado el ecocardiograma, la disfunción derecha estaba allí, pero ninguno de los que vimos el estudio reparamos en ella. Simplemente porque estábamos todos convencidos del origen izquierdo de la arritmia y toda nuestra búsqueda se orientó en ese sentido».

Thierer J. Error medico error humano Revista SAC. 2017

Se podría elaborar entonces “la fisiopatología del error expresando que la mayoría de los errores provienen de aberraciones en el funcionamiento mental. Para comprender por qué se producen los errores debemos primero comprender el mecanismo cognitivo normal. La mayor parte del funcionamiento mental es automático, rápido y sin esfuerzo. Esto es posible porque llevamos esquemas mentales que son expertos en algunos aspectos recurrentes de nuestra práctica, procesando información en paralelo sin esfuerzo consciente o mediante estímulos sensoriales. Además de estos mecanismos automáticos inconscientes, las actividades cognitivas pueden ser conscientes y controladas. Este modo de pensamiento consciente es utilizado para resolver problemas o para monitorear la función. Esta forma de pensamiento se pone en marcha cuando enfrentamos un problema, ya sea nuevo o como resultado de fallas en el modelo esquemático.

Según Reason y Rasmussen los errores han sido clasificados en 2 grupos fundamentales: los que se producen por desliz, olvido o desconocimiento (son llamados «slips») y los que son provocados por descuido, despreocupación ante un proceder (denominados «Mistakes»). Estos últimos son también llamados errores conscientes del aprendizaje (Concius Thought).

- desliz, olvido o desconocimiento

- provocados por descuido, despreocupación ante un proceder

Los primeros ocurren inconscientemente, al romperse la rutina mientras la atención está desviada y puede ser porque no se realice correcta identificación, porque la acción se realice en el objeto equivocado, por asociación mental de ideas, o por pérdida temporal del sueño.

El enfoque de «El error humano» estuvo muy influenciado por la Psicología Cognitiva y por la necesidad de abordar el fenómeno del fallo de la conducta antes de todo definiendo una taxonomía que ayude a identificar e interpretar el error mismo. La metáfora del ser humano como procesador de información simbólica transformada en planes de acción y consecuente ejecución era tan dominante en ese momento que no habría podido dejar de guiar la creación de la taxonomía. De hecho, la contribución de Rasmussen (1983) a la clasificación de los niveles de actuación humana se completa en este sentido con una clasificación de la actuación errónea, concentrándose en el proceso mental entendido como causa de dicha actuación.

En las conceptualizaciones posteriores, Reason empezó a dejar la perspectiva demasiado estricta de la Psicología académica para contribuir en manera fundamental a la ergonomía. El nacimiento de los primeros modelos organizativos relacionados con el error humano, la inclusión de los gestores en las causas de los accidentes, la conceptualización de un contexto como propenso al error son puntos que expresan la asunción básica de que aunque la mente humana es falible: el tema fundamental es averiguar dónde y cómo puede fallar.

Existen errores automáticos o de acción (slips o de fugas) y errores por mecanismos conscientes no automáticos son errores del conocimiento. Los primeros Ocurren cuando hay una desviación de la atención. La persona posee los requisitos para realizar la tarea pero omite un chequeo a tiempo, desoye una alarma, una advertencia, una barrera, un límite. Son actos no intencionales donde falla el monitoreo. Hay infinidad de ejemplos en el accionar médico de todos los días: equivocaciones del paciente o de lado, errores de medicación o gasas olvidadas. Ocurren por tres mecanismos: cautividad del hábito, errores de asociación o pérdida de la activación.

Errores automáticos, de acción, slips o fugas:

- Cautividad del hábito.

- Errores de asociación.

- Pérdida de la activación.

La cautividad en el hábito: es estar acostumbrados a la rutina, a traccionar en pull determinadas acciones, como estamos acostumbrados lo hacemos. Un ejemplo es un paciente politraumatizado, al cual le corresponde por norma clínica liberación de la vía aérea y colocación de sonda nasogástrica. Lo que ocurre que este paciente tiene fractura de la base de cráneo y está contraindicado. Fallas los mecanismos conscientes, se coloca la sonda y se produce un daño cerebral. Se está tan acostumbrado a ejecutar un proceso, que no identifica las alternativas al proceso tradicional: como en este caso asegurar la permeabilidad en la vía aérea con sospecha de fractura de base de cráneo.

Los errores de asociación: es por asociación mental de ideas, como atender el teléfono cuando suena el timbre de la puerta, mala interpretación de las alarmas, o una pérdida de activación. Son pérdidas temporarias de memoria, como entrar a una habitación y no acordarse para qué se ingresó. Paciente con registro plano en el monitor y tiene el mismo desconectado, asumir que está en paro cardiaco.

Las pérdidas de activación, son provocadas por distracciones, en general por interrupción. Por ejemplo, nos olvidamos de preguntar un dato que era importante porque fuimos interrumpidos durante la consulta. Error durante la preparación de un medicamento en el área limpia de enfermería por la interrupción, de un médico que pide elementos para una curación o un procedimiento. Los segundos estarán determinados por factores fisiológicos que derivan del control de la atención, ejemplo: fatiga, alcohol, sueño, drogas, enfermedades, etc. También estados emocionales como: frustraciones, ansiedad, disgustos, crean preocupación y desviar la atención; y finalmente factores psicológicos como el stress, relaciones interpersonales, susceptibilidad a los ruidos, etc.[1] [2]

Los errores por mecanismos conscientes no automáticos son errores del conocimiento, ya no son fugas como los anteriores. Se trata lisa y llanamente de equivocaciones que ocurren durante el proceso de resolución de un problema, generalmente por una mala percepción de la situación que lleva a aplicar la solución equivocada. Estos errores ocurren cuando la persona se encuentra en una situación nueva, para lo cual no tiene programada ninguna solución. Sobrevienen por falta de conocimiento o mala interpretación. Esto son errores sobre los que hay que actuar todos los días, evitar con supervisión que no ocurran, en general los médicos buscan el camino de menor resistencia, de incusive hacer las cosas de una determinada manera, por sesgo profesional.

Existen algunos hábitos de pensamiento que son poco conocidos por la persona pero que llevan al error, como por ejemplo la memoria sesgada: Basamos las decisiones en lo que tenemos presente en la memoria, pero esta está sesgada hacia lo que es más común y general; se asumen conclusiones que generalmente funcionan, vemos lo que conocemos. Paradójicamente, la memoria también tiene una tendencia a desviarse hacia la discrepancia, dándole a un caso aislado que alguna vez tuvimos una importancia significativa. Estiste tendencia a utilizar la primera información que viene a mano y a buscar evidencias que apoyen hipótesis tempranas. Exceso de confianza en el curso de acción iniciado. Los errores del conocimiento son afectados por los mismos mecanismos que afectan a las fugas, la fatiga, las condiciones de trabajo y las preocupaciones.

El abordaje del error centrado en la persona o el agente tiene la visión que los errores se producen por olvidos, desatención, falta de motivación, descuidos, negligencia, impericia, imprudencia de las personas que están en la primera línea de atención: médicos, enfermeras, anestesistas, personal de apoyo, farmacéuticos, etc. La consecuencia natural de esta percepción es apelar a que estos individuos modifiquen sus conductas. Asumiendo que las cosas malas les pasan a malos profesionales, lo que los psicólogos han denominado “la hipótesis del mundo justo”.

Allí instalamos las medidas de defensa o barreras para que no acontezca el error o el daño no deseado al paciente y el centro de nuestra acción. Cuantas más salvaguardas adoptemos menores serán las posibilidades de eventos adversos. Las barreras defensivas no deben tener fallas, porque si estas acontecen se producirá un evento. Cuando acontece un daño, entonces, hay que preguntarse por qué fallaron las barreras.

Los sistemas de atención médica han desarrollado varios tipos de defensas para evitar que los errores produzcan daños. Tienen que ver con capacitación permanente, alarmas, normas institucionales, supervisión, coordinación, continuidad de cuidado y presencia de decisores[1] especialmente los fines de semana[2], etc. En general estas barreras funcionan efectivamente, pero siempre hay debilidades. Usualmente los accidentes ocurren sólo cuando los agujeros o fallas en las barreras coinciden o se alinean momentáneamente. Permiten una trayectoria de accidente, llevando a que el peligro termine dañando al paciente. [3]

Los agujeros en las defensas o barreras se forman por fallas activas o por condiciones latentes.

Casi todos los eventos adversos se dan por la combinación entre factores latentes o condicionantes y fallas activas. Sobre ellas tenemos que actuar. Las fallas activas son aquellos actos inseguros cometidos por las personas que están en contacto directo con los pacientes. Pueden tomar una variedad de formas: fugas, equivocaciones o violaciones de procedimientos. Son generalmente los errores del efector final, la enfermera que realizó mal la medicación o que rasuró a un paciente que no se tenía que hacer una traqueotomía. Las fallas activas tienen un impacto directo en las defensas, pero si son sistémicas tienen la característica de recomponerse. Los procedimientos deben ser cumplibles, prácticos, fáciles de hacer, y los operadores estar bien capacitados y supervisados. Cuidado que luego de un tiempo pueden tornarse rutinarios y repetirse sin pensar en la importancia de la realización del control. La falla humana es generalmente el último eslabón de una cadena de fallas. Cuando continuamos recorriendo hacia atrás el camino de los por qué, es posible identificar otro tipo de fallas: aquellas que, en general, permanecen inadvertidas, pero son las que en definitiva generan las condiciones favorables para que ocurran los errores humanos y que se las reconoce como las fallas latentes del sistema.[4] Cuando acontece un evento adverso hay que actuar inmediatamente para disminuir el impacto que ocasiona del daño, evitando la generación de problemas posteriores.

- Los humanos somos falibles.

- El error es inherente a la condición humana.

- No hay que aceptar el error, para ello están los procesos seguros y las barreras.

- Tenemos que desarrollar mejores barreras y alertas.

Ejemplos de condiciones latentes para que ocurra el error:

- No poner las barandas de las camas y el paciente se cae.

- No poner alerta de limpieza en superficie y un familiar se resbala.

- No hacer evaluación de riesgo de caídas y el paciente se cae.

- No rotular correctamente los medicamentos y se administra por error.

- No guardar los medicamentos en lugares adecuados.

- Fatiga en el personal.

- Insuficiente cantidad de personal, que aumenta la infección cruzada.

- No tener en todos los lugares dispensadores de alcohol para lavarse las manos, disminuye la intención de cumplir con la práctica.

- No realizar el checklist prequirúrgico.

- No corroborar las indicaciones médicas.

Los dos productos principales de la toma de decisiones en medicina son el proceso diagnóstico y el plan terapéutico. Si el diagnóstico es correcto, la probabilidad de que el plan terapéutico también lo sea es mayor. Sin embargo, sorprendentemente, nuestros diagnósticos no son correctos con tanta frecuencia como creemos: se estima que la tasa de fallas diagnósticas es del 10-15%. El error en las especialidades visuales, como radiología y anatomía patológica, es considerablemente menor, alrededor del 2%.[1]

Los errores cognitivos[1] son una de las causas principales de los diagnósticos erróneos, más que la incompetencia. En general, no es la falta de conocimiento lo que genera los errores, sino los problemas con el pensamiento del médico.

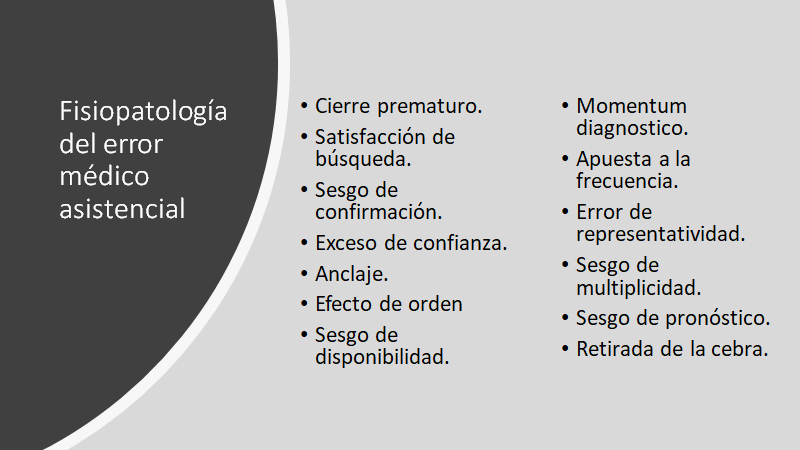

Ocurre el cierre prematuro como uno de errores cognitivos más frecuentes. Consiste en la tendencia a terminar el proceso de razonamiento y toma de decisiones en forma prematura, aceptando el diagnóstico que no ha sido verificado. Sigue la máxima “cuando se hace el diagnóstico, el pensamiento termina”. [3]

La satisfacción de búsqueda es la tendencia a dejar de buscar cuando ya se ha encontrado algo. Por ejemplo, se pasa por alto una segunda fractura en una radiografía, pues la búsqueda se da por satisfecha al encontrar la primera fractura. [4]

El sesgo de la confirmación consiste en la tendencia a buscar y darle más peso a la evidencia que confirma nuestro diagnóstico, y no buscar o darle menos peso a la evidencia que lo refuta. Esto lleva también a la búsqueda sesgada de información para aseverar nuestro diagnóstico. En la recolección de datos diagnósticos existe una tendencia a buscar aquella información que confirme la hipótesis inicial, antes que aquella que mejore la eficiencia en el descarte de la hipótesis que está en competencia. Este sesgo de confirmación implica la adición de pruebas diagnósticas redundantes que puedan incrementar la confianza del médico de su diagnóstico focal aún sin alterar las probabilidades bayesianas de este diagnóstico. En otras palabras, si dos pruebas están muy relacionadas, la segunda no aporta información, pero incrementa falsamente la confianza en el diagnóstico hipotetizado.

El exceso de confianza es la tendencia a creer que sabemos más de lo que realmente sabemos. Cuando hay exceso de confianza se tiende a actuar con la información incompleta, se coloca mucha fe en las impresiones iniciales sin examinar cuidadosamente la evidencia.[5] El grupo con más confianza en sus competencias estaba en el 20% inferior a su rendimiento.[6]

El anclaje es la tendencia a aferrarse a características relevantes que aparecen en forma precoz en el proceso diagnóstico y formarnos una impresión inicial del paciente basados en ellas, sin ajustar la impresión diagnóstica a la luz de la información que va apareciendo después. Este sesgo de anclaje (anchoring) implica que las opiniones finales son sensibles al punto de partida.

El efecto de orden está en relación con el anterior. Tendemos a recordar más el comienzo y el final más reciente. Es el orden de presentación de la información. La aplicación normativa del teorema de Bayes[7] implica que los clínicos con la misma información deberían alcanzar las mismas conclusiones con independencia del orden que hayan recibido esta información. Sin embargo, existen diversas evidencias de que la información presentada más tarde tiene más peso que la presentada al inicio. Esta puede ser una de las razones del mayor peso otorgado a las pruebas de laboratorio, radiología, tomografía, ecografía y resonancia, presentadas al final de complejas secuencias diagnósticas, que además juegan un efecto de enlentecimiento del proceso: pero falta el ecoestress. [8]

El sesgo de disponibilidad es la tendencia a creer que algo es más frecuente o más probable, porque se nos viene fácilmente a la mente. Sobre la enfermedad que diagnosticamos recientemente.

El “momentum” diagnóstico es la tendencia a creer en los diagnósticos ya hechos por otra persona. Una vez que la etiqueta de un diagnóstico se ha colocado en un paciente, se hace cada vez más pegajosa, y es difícil sacarla de nuestra mente. En las instituciones universitarias en general, y exageradamente rechazan diagnósticos realizados en establecimientos de salud que les derivan y le vuelven a realizar todos los estudios nuevamente.

La apuesta a la frecuencia es la tendencia a optar por un diagnóstico sobre la base de que es más frecuente. La apuesta de frecuencia se puede resumir en el aforismo “cuando escuches ruidos de cascos piensa en caballos, no en cebras”.

El error de representatividad consiste en buscar manifestaciones del prototipo de la enfermedad. Este tipo de error hace que las variantes atípicas de una enfermedad no sean diagnosticadas.

El sesgo de la multiplicidad es cuando pensamos en muchas hipótesis al mismo tiempo nos confundimos. Nuestro pensamiento funciona mejor considerando hasta cuatro hipótesis a la vez.

Sesgo de pronóstico es la tendencia a optar por diagnósticos que tienen buen pronostico. Ocurre especialmente cuando el médico tiene un lazo afectivo con el paciente.

La retirada de la cebra ocurre en los diagnósticos raros. A veces el médico carece de confianza suficiente para mantener el diagnóstico.

Un aspecto de interés de cada uno de estos sesgos, es que en agregado tienden a favorecer la solicitud de más pruebas de diagnóstico, con el propósito de disminuir la incertidumbre. El problema es que son desencadenantes de los falsos positivos que determinan conductas, sin tener el paciente esa enfermedad, y por lo tanto no necesitan dichas prestaciones. Tienden a que se soliciten más pruebas que en muchos casos son redundantes y confirman la prueba inicial. Por similitud no sirve de confirmación, sino de aposición, inclusive como confimatoria; forman parte de las tendencias actuales de sobreutilización de pruebas diagnósticas.

[1] Higgins JP, Altman DG, Gøtzsche PC, Ju¨ni P, Moher D, Oxman AD, et al;Cochrane Bias Methods Group. The Cochrane Collaboration’s tool for assessingrisk of bias in randomised trials. BMJ. 2011; 343:d5928.

[2]Camargo CA Jr, Tsai CL, Sullivan AF, et al. Safety climate and medical errors in 62 US emergency departments. Ann Emerg Med 2012; 60:555–63 e20.

[3] Croskerry P. Clinical cognition and diagnostic error: applications of a dual process model of reasoning. Adv in Health SciEduc 2009; 14: 27-35.

[4] Brenner J, Eisenberg RL, Feinstein KA, et al. Risk Management Test and Syllabus. Reston VA: American College of Radiology, 1999.

[5] Romera Romero J. Causalidad del error humano en los accidentes laborales. Modelo psicológico “Queso suizo”. Seguridad y salud en el trabajo. Julio 2007.

[6] Potchen EJ Measuring observer performance in chest radiology: some experiences. J Am Coll Radiol 2006. 3:423-432.

[7] Tajer CD. Una crítica conceptual al teorema de Bayes desde el punto de vista clínico. “el concepto Bayesiano ha sido de extraordinaria utilidad didáctica y conceptual para la selección de estudios y su interpretación. En forma simplificada podríamos enunciar el aporte de este enfoque afirmando que la probabilidad de un diagnóstico determinado luego de conocer el resultado de un test dependería del valor del test y de la probabilidad previa al test de que ese diagnóstico esté presente”. http://gedic.files.wordpress.com/2011/07/bayes-y-la-clinica.pdf 2011. Sin embargo no existe el test perfecto, o sea el que no tiene falsos negativos o positivos.

[8]Peiró S. Innovación en la toma de decisiones diagnósticas en atención primaria. Seminarios de innovación en atención primaria 2009.

[1] Pennsylvania Patient Safety Advisory.2010. Diagnostic Error in acute care.

[1] Croskerry P. From Mindless to Mindful Practice – Cognitive Bias and Clinical Decision Making. New Engl J Med. 2013. Jun. 368. 2445-2448

[1] Takala J. Night –time intensivists-waste of resources or failure of process optimization?. Critical Care 2013.17:472.

[2] Blecker S, Shine D, Park N, Goldfel K, Braithwaite SR Radford MJ Gourevitch MN. Association of weekend continuity of care with hospital length of stay. International Journal for Quality In Health Care 2014 26.5.530-537.

[3] Wrong BM. Etchells EE. Kuper A. Levinson W. Shojania KG Theaching quality improvement and patient safety to trainees: A Systematic Review. Academic Medicine 2010. 85.9.1425-1439

[4] Croskerry P. Achieving quality in clinical decision making: Cognitive strategies and detection of bias. Acad Emerg Med 2002; 9: 1184-204.

[1] Leape Lucian L, MD. Error in Medicine. Special comunication. JAMA 1994; 272(23): 1851 – 1857

[2] Martinez Ques AA. Seguridad y Factor Humano. Tempus Vitalis. Revista Electrónica Internacional de cuidados. Volumen 7 Número 2.