Mark S Bauer 1, 7, ✉ , Laura Damschroder 2 , Hildi Hagedorn 3 , Jeffrey Smith 4 , Amy M Kilbourne 5, 6

PMCID: PMC4573926 PMID: 26376626

Abstract

Fondo

La incorporación de prácticas basadas en la evidencia (PBE) al uso clínico rutinario no es espontánea, sino que requiere esfuerzos específicos. El campo de la ciencia de la implementación se ha desarrollado para facilitar la difusión de las PBE, incluyendo intervenciones psicosociales y médicas para problemas de salud mental y física.

Discusión

Los autores buscan presentar los principios de la ciencia de la implementación a investigadores, administradores y responsables políticos no especializados que deseen familiarizarse con este campo emergente. Esta introducción se basa en la literatura publicada y en la experiencia de los autores como investigadores en este campo, así como en su amplia trayectoria como evaluadores de subvenciones para proyectos de ciencia de la implementación.

La ciencia de la implementación es el estudio científico de métodos para promover la incorporación sistemática de los hallazgos de la investigación y otras prácticas basadas en la evidencia (PBE) a la práctica rutinaria, mejorando así la calidad y la eficacia de los servicios de salud. Si bien se distingue de los métodos de mejora de la calidad y de difusión, comparte características con ellos. Los estudios de implementación pueden evaluar la variabilidad naturalista o medir el cambio en respuesta a una intervención planificada. Estos estudios suelen emplear diseños mixtos cuantitativos-cualitativos, identificando factores que influyen en la adopción en múltiples niveles, incluyendo el paciente, el proveedor, la clínica, el centro, la organización y, a menudo, la comunidad en general y el entorno político. Por consiguiente, la ciencia de la implementación requiere una sólida base teórica y la participación de equipos de investigación transdisciplinarios.

Resumen

La justificación empresarial de la ciencia de la implementación es clara: a medida que los sistemas de salud operan en condiciones cada vez más dinámicas y con recursos limitados, las estrategias basadas en la evidencia son esenciales para garantizar que las inversiones en investigación maximicen el valor de la atención médica y mejoren la salud pública. La ciencia de la implementación desempeña un papel fundamental en el apoyo a estos esfuerzos.

Palabras clave: Implementación, Mejora de la calidad, Servicios de salud, Evaluación de resultados, Práctica basada en la evidencia, Organización de atención médica que aprende

Antecedentes: ¿Qué es la ciencia de la implementación y cómo se desarrolló?

La necesidad de una ciencia de la implementación

Se ha informado ampliamente que las prácticas basadas en la evidencia ( PBE ) tardan en promedio 17 años en incorporarse a la práctica general rutinaria en la atención sanitaria [ 1 – 3 ]. Incluso esta desalentadora estimación presenta una proyección irrealmente optimista, ya que solo alrededor de la mitad de las PBE llegan a un uso clínico generalizado [ 1 ].

Históricamente, esta brecha entre la investigación y la práctica no ha sido una preocupación para los investigadores clínicos académicos. El modelo tradicional de éxito profesional en el ámbito académico se ha centrado principalmente en la realización de estudios descriptivos o de mecanismos y estudios de intervención en poblaciones altamente seleccionadas, generalmente en centros médicos académicos, y en la publicación en revistas académicas de primer nivel. Si estos hallazgos se traducen en un impacto en la salud pública no ha sido, por lo general, una preocupación para los investigadores tradicionales del sector sanitario.

Este paradigma de éxito académico ha sido objeto de críticas, con razón, en los últimos años. Quienes financian la investigación biomédica se han mostrado preocupados por la falta de impacto en la salud pública de sus inversiones [ 4 ]. Además, la disminución de la financiación para la investigación a nivel mundial ha generado debates sobre las ventajas y desventajas de invertir en proyectos más conservadores con resultados predecibles frente a investigaciones más innovadoras, incluyendo proyectos con muestras del mundo real que podrían tener un mayor impacto en la salud pública [ 5 ].

El reconocimiento de la necesidad de investigación que impacte más directamente en la salud pública ha ampliado un poco la mentalidad académica, desde un énfasis exclusivo en estudios de eficacia a ensayos de efectividad más generalizables (Tabla 1 ) [ 6 ]. Se han desarrollado varios nombres superpuestos y estructuras conceptuales para estos últimos tipos de ensayos, incluidos “ensayos de efectividad” [ 7 , 8 ], “ensayos clínicos pragmáticos” [ 9 ], “ensayos clínicos prácticos” [ 10 ] y “ensayos simples a gran escala” [ 11 ].

Tabla 1.

Características de los diseños de ensayos de eficacia frente a ensayos de efectividad (según [ 8 ])

| Ensayo de eficacia | Ensayo de eficacia | |

|---|---|---|

| Prioridad de validez | Interno > Externo | Externo ≥ Interno |

| Población y muestra | • Altamente seleccionado para la condición de interés, definida de forma estricta. | • Seleccionado por su condición de interés, reflejando su presentación en la población de origen. |

| • Pocas comorbilidades | • Las comorbilidades son similares a las de la población a la que se aplicarán los resultados; solo se excluye a quienes no pueden participar por razones prácticas o éticas. | |

| • Participantes dispuestos y motivados | ||

| Intervención | • El personal de intervención está altamente cualificado. | • La selección, capacitación y monitoreo de la fidelidad del personal se asemejan a los que probablemente serían factibles en sitios objetivo fuera del protocolo propiamente dicho. |

| • El entrenamiento puede ser intensivo | ||

| • La monitorización de la fidelidad puede ser igualmente intensiva. | ||

| Medidas de resultados y recopilación de datos | • Las mediciones de resultados pueden ser extensas, abarcando un amplio espectro de posibles efectos secundarios, moderadores y mediadores, o efectos adversos. | • Las baterías de resultados minimizan la carga para el encuestado (tanto en términos de frecuencia como de duración de las evaluaciones) ya que los sujetos son heterogéneos en su disposición y capacidad para participar. |

| • Dado que los sujetos están motivados, la carga para los encuestados es una preocupación menor. | • Por consiguiente, las medidas de resultados deben elegirse cuidadosamente para abarcar menos resultados y deben ser fáciles de completar. | |

| Análisis de datos | • Los métodos estadísticos estándar son suficientes, y los análisis intensivos en datos pueden ser factibles. | • Análisis para tener en cuenta una mayor heterogeneidad de la muestra. |

| • Los análisis tienen en cuenta una mayor cantidad de datos faltantes y datos que no faltan al azar. |

Sin embargo, tales ensayos en sí mismos ofrecen pocas garantías de impacto en la salud pública. Los ensayos de efectividad suelen depender, al igual que los ensayos de eficacia, de recursos de investigación que están separados de la infraestructura clínica y que son financiados externamente, limitados en el tiempo y efímeros al final del protocolo [ 8 ]. Los recursos respaldados por la investigación rara vez permanecen en los centros locales para respaldar el uso continuado incluso de las intervenciones exitosas; por lo general, hay poca memoria institucional para la intervención y no hay transferencia de tecnología. Además, las PBE a menudo tienen características que hacen improbable la traducción sin asistencia a la práctica, especialmente si la intervención requiere incorporar un cambio en la rutina de un clínico [ 12 ].

Una conceptualización útil del proceso de investigación biomédica ha sido como un “canal” [ 13 ] en el que una intervención pasa de ensayos de eficacia a ensayos de efectividad y, finalmente, a su aplicación sostenida en la práctica general. Pueden surgir obstáculos en diversas etapas, lo que genera brechas de calidad a medida que las PBE se aplican en entornos menos controlados. Muchos factores pueden impedir la adopción de las PBE, incluyendo las demandas contrapuestas de los profesionales de primera línea; la falta de conocimientos, habilidades y recursos; y la falta de alineación entre la evidencia de la investigación y las prioridades operativas. Por consiguiente, existe una clara necesidad de desarrollar estrategias específicas para promover la adopción de las PBE en el uso clínico general [ 14 ]. La ciencia de la implementación se ha desarrollado para abordar estas necesidades.

La organización de este resumen

El objetivo de esta revisión es introducir a investigadores, administradores y responsables políticos no especializados en los principios y métodos de la ciencia de la implementación. Esta revisión se elaboró a partir de la literatura publicada, nuestra experiencia como investigadores en implementación y nuestra amplia participación en comités de evaluación de subvenciones para la ciencia de la implementación. Incluimos ejemplos para ilustrar principios clave, utilizando principalmente estudios de prácticas basadas en la evidencia psicosociales. La mayoría de estos ejemplos provienen de estudios financiados por el Departamento de Asuntos de Veteranos de los Estados Unidos (USVA), ya que podemos presentar estos casos con una perspectiva interna que ofrece información que no resulta evidente con la simple lectura de los resultados publicados. Sin embargo, es importante destacar que el campo de la ciencia de la implementación es global, como se evidencia al consultar algunas de las principales publicaciones, como Implementation Science , BMC Health Services Research y diversas revistas especializadas.

En esta revisión, primero definimos la ciencia de la implementación, comparándola con los métodos de mejora de la calidad y difusión. A continuación, analizamos el desarrollo de la ciencia de la implementación como campo de estudio, ilustrando esta trayectoria con la experiencia de la USVA. Posteriormente, profundizamos en el campo, comenzando con los fundamentos de los métodos descriptivos, incluyendo el papel fundamental que desempeñan las teorías, los modelos y los marcos conceptuales. Luego, presentamos los fundamentos de los ensayos de intervención controlados, incluyendo el área en rápido desarrollo de los diseños híbridos de efectividad e implementación. Finalmente, proporcionamos una descripción detallada de dos estudios de implementación reales y concluimos situando la ciencia de la implementación en el contexto de las políticas de salud global.

Definición de la ciencia de la implementación

La ciencia de la implementación puede definirse como “el estudio científico de métodos para promover la incorporación sistemática de los hallazgos de la investigación y otras prácticas basadas en la evidencia a la práctica rutinaria y, por lo tanto, para mejorar la calidad y la eficacia de los servicios de salud” [ 15 ]. Este campo abarca un alcance más amplio que la investigación clínica tradicional, centrándose no solo en el paciente, sino también en el proveedor, la organización y las políticas de atención médica (Tabla 2 ). En consecuencia, la investigación de la implementación requiere equipos de investigación transdisciplinarios que incluyan miembros que no suelen formar parte de la mayoría de los ensayos clínicos, como investigadores de servicios de salud, economistas, sociólogos, antropólogos, científicos organizacionales y socios operativos, incluidos administradores, profesionales clínicos de primera línea y pacientes.

Tabla 2.

Tipos de estudios para abordar los obstáculos en el proceso de implementación

| Brecha en el proceso de implementación | Tipos de estudios |

|---|---|

| Validez externa limitada de los estudios de eficacia/efectividad. | • Diseñar intervenciones clínicas listas para su implementación en las primeras etapas del proceso de investigación, haciendo hincapié en herramientas, productos y estrategias que mitiguen las variaciones en la adopción en los diferentes contextos de consumidores, proveedores y/o organizaciones. |

| Brechas de calidad entre sistemas debido a variaciones en la capacidad organizativa (por ejemplo, recursos, liderazgo). | • Evaluar las variaciones y personalizar las estrategias de implementación en función del contexto organizacional. |

| • Desarrollo de infraestructura de datos para capturar o evaluar de forma rutinaria la fidelidad de la implementación, los procesos/resultados de atención a nivel del paciente y las medidas de valor/retorno de la inversión. | |

| • Perfeccionamiento adicional de las estrategias de implementación que implican cambios en el comportamiento organizacional y/o del proveedor. | |

| • Desarrollo de redes de proveedores/prácticas para llevar a cabo estudios de implementación o evaluación de programas nacionales. | |

| Demandas contrapuestas del personal sanitario de primera línea (por ejemplo, múltiples recordatorios clínicos). | • Perfeccionamiento de las estrategias de implementación mediante métodos interdisciplinarios que aborden el comportamiento del proveedor y el cambio organizacional (por ejemplo, negocios, economía, políticas, investigación operativa, etc.). |

| • Estudios de desviación positiva o adaptación, especialmente para mejorar la implementación en sitios con menos recursos y de adopción tardía. | |

| Desajuste con las prioridades nacionales o regionales | • Implementación de políticas/prácticas a nivel nacional |

| • Evaluaciones aleatorias de programas o políticas nacionales |

Ciencias de la implementación, mejora de la calidad y difusión.

Tanto la ciencia de la implementación como los esfuerzos de mejora de la calidad (MC) comparten el objetivo final de mejorar la calidad de la atención médica. Los métodos utilizados en ambos campos a menudo se superponen, aunque existen algunas diferencias. Los esfuerzos de MC generalmente comienzan con un problema específico en un sistema de atención médica específico, reconocido a nivel del proveedor, la clínica o el sistema de salud, y conducen al diseño y la prueba de estrategias para mejorar un problema específico para ese sistema de atención médica específico. Se han desarrollado diversos enfoques de MC, a menudo tomados de otras industrias como Toyota Lean, Six Sigma y otros [ 16 , 17 ].

En cambio, la ciencia de la implementación suele partir de una práctica basada en la evidencia (PBE) subutilizada, para luego identificar y abordar las deficiencias de calidad resultantes a nivel del proveedor, la clínica o el sistema de salud. Además, la ciencia de la implementación, como disciplina científica, tiene como objetivo explícito desarrollar conocimiento generalizable que pueda aplicarse ampliamente más allá del sistema individual estudiado. No obstante, ambos enfoques comparten un objetivo común, un sistema de valores, un afán de rigor, un enfoque en los resultados y muchos métodos comunes.

La difusión, a diferencia de la implementación, se refiere a la propagación de información sobre una intervención, apoyada, como máximo, por esfuerzos educativos [ 18 ]. Sin embargo, existe cierta superposición, ya que los esfuerzos de implementación pueden incorporar técnicas de difusión, pero generalmente están integrados en iniciativas más amplias, específicas y activas para difundir la práctica basada en la evidencia (PBE).

Desarrollo de la ciencia de la implementación

En los últimos 10-15 años, los sistemas de salud responsables de administrar presupuestos fijos para atender a sus poblaciones se han vuelto cada vez más conscientes de los problemas de implementación para maximizar el valor de sus fondos de salud [ 19 ]. Estas organizaciones incluyen los servicios nacionales de salud de varios países y la USVA en Estados Unidos. Más recientemente, en EE. UU., nuevas leyes como la Ley de Cuidado de Salud Asequible han llevado al desarrollo de organizaciones de atención responsable, que alinean a los proveedores de atención, a menudo en diferentes sistemas hospitalarios, y que frecuentemente administran la atención para una población determinada bajo un límite de reembolso fijo o restringido [ 20 ]. Como resultado, las organizaciones federales de financiamiento de investigación de EE. UU. han desarrollado recientemente una inversión en ciencia de la implementación [ 21 , 22 ]. Otro programa norteamericano, Knowledge Translation Canada [ 23 ], se esfuerza por mejorar el impacto de los hallazgos de la investigación a través de estrategias de ciencia de la implementación.

Entre los programas científicos más antiguos y extensos centrados en la implementación se encuentra la Iniciativa de Investigación para la Mejora de la Calidad (QUERI; [ 13 ]) del Departamento de Asuntos de Veteranos de EE. UU. (USVA), que presentamos como un estudio de caso en el desarrollo de la ciencia de la implementación como campo de estudio. Desde su creación en 1998, el objetivo de QUERI ha sido mejorar la salud de los veteranos militares apoyando la rápida implementación de intervenciones efectivas en la práctica [ 24 ]. QUERI combina el rigor científico proporcionado por investigadores académicos líderes con asociaciones con líderes de operaciones del USVA que enfrentan problemas urgentes de implementación. QUERI se encuentra en una posición única como recurso de ciencia de la implementación dentro de un sistema nacional de atención médica y, como resultado, proporciona importantes sinergias entre el ámbito académico y el operativo: QUERI se centra en aumentar el impacto en el sistema de salud de las prácticas basadas en la evidencia (PBE) de importancia clínica y política para las operaciones del VA, y a través del rigor científico contribuye con conocimientos fundamentales al campo de la ciencia de la implementación que pueden tener un impacto mucho más allá del propio sistema del USVA.

Como reflejo del desarrollo de la ciencia de la implementación como campo, el primer salto evolutivo de QUERI fue su transición de la inversión en estudios de investigación de servicios de salud convencionales a la investigación centrada en la descripción de las brechas en el uso de las PBE y la descripción de las barreras y facilitadores relevantes. El segundo salto evolutivo, que actualmente está en curso, es una transición de los estudios descriptivos de barreras/facilitadores a la especificación y prueba de estrategias óptimas para la implementación, incluyendo tanto ensayos controlados como estudios observacionales que evalúan experimentos naturales de iniciativas de mejora basadas en la práctica. Más recientemente, la misión de QUERI se ha extendido para apoyar la implementación de las PBE, como lo promueve la Oficina de Administración y Presupuesto de los Estados Unidos [ 25 ] mediante el uso de una evaluación rigurosa para estudiar y ampliar programas o iniciativas que han demostrado efectividad, o el uso de un diseño de programa aleatorio para probar políticas o programas a nivel poblacional [ 26 , 27 ].

Debate: los principios y métodos de la ciencia de la implementación.

Los estudios de implementación difieren de los estudios clínicos.

El primer paso para comprender los estudios de implementación es distinguir los procesos de implementación de las prácticas basadas en la evidencia (PBE) que buscan implementar. Una intervención de implementación es “un método o técnica única para facilitar el cambio”, mientras que una estrategia de implementación es “un conjunto integrado, paquete o conjunto de intervenciones de implementación discretas, idealmente seleccionadas para abordar barreras específicas identificadas para el éxito de la implementación” [ 13 ]. Las intervenciones de implementación pueden incluir, por ejemplo, esfuerzos para cambiar el comportamiento a nivel del paciente, el proveedor, el sistema o incluso la política. Ejemplos comunes incluyen estrategias a nivel del proveedor, como educación/capacitación, retroalimentación de auditoría e incentivos de desempeño. Las estrategias dirigidas a los niveles del proveedor, el equipo o la clínica pueden incluir técnicas de mejora de la calidad u otros esfuerzos de rediseño de sistemas, incentivos de desempeño basados en equipos, colaboraciones de aprendizaje o participación comunitaria. La facilitación, esfuerzos guiados por personal organizacional interno o externo para apoyar múltiples niveles de cambio del sistema a través del coaching basado en el proveedor o el equipo, se reconoce cada vez más como fundamental para el éxito de muchos efectos de implementación [ 28 , 29 ].

A diferencia de la investigación clínica, que generalmente se centra en los efectos en la salud de una PBE, los estudios de implementación generalmente se centran en las tasas y la calidad del uso de las PBE en lugar de sus efectos. Dichas PBE pueden ser tan «simples» como aumentar el uso de un solo medicamento, como los betabloqueantes, en personas que han sufrido un infarto de miocardio o el uso de la monitorización de los efectos secundarios metabólicos para personas que toman medicamentos antipsicóticos, o tan complejas como instituir psicoterapias como la terapia cognitivo-conductual o incluso paradigmas de atención multicomponente como el modelo de atención crónica colaborativa [ 30 ].

Si bien la distinción entre la estrategia de implementación y la práctica basada en la evidencia (PBE) parece clara en teoría, es fundamental prestar atención a sus funciones específicas para formular hipótesis precisas y tomar decisiones sobre el diseño de la evaluación. Por ejemplo, al estudiar los efectos de un programa para aumentar el uso efectivo de la terapia cognitivo-conductual en el trastorno bipolar, el impacto de la terapia cognitivo-conductual en el estado de salud sería un resultado de la PBE (y, por lo general, el foco de un estudio clínico), mientras que medir la proporción de profesionales que brindan terapia cognitivo-conductual, o la proporción de pacientes que asisten a un mínimo de sesiones de terapia cognitivo-conductual, sería un resultado más típico de un estudio de implementación.

Evaluación del proceso de implementación y su impacto

Por lo tanto, el punto clave de los estudios de implementación es su enfoque en evaluar el proceso de implementación y su impacto en la PBE de interés. Estos estudios pueden incluir uno o más de tres tipos generales de evaluación: evaluación de procesos , evaluación formativa y evaluación sumativa [ 13 , 31 ].

La evaluación de procesos simplemente describe las características del uso de una práctica basada en la evidencia (o su ausencia). Los datos se recopilan antes, durante y/o después de la implementación y son analizados por el equipo de investigación sin proporcionar retroalimentación al equipo de implementación y sin intención de modificar el proceso en curso. La evaluación de procesos puede realizarse en un estudio puramente observacional (por ejemplo, como preparación para el desarrollo de una estrategia de implementación) o durante un cambio de sistema o política, ya sea espontáneo o planificado.

La evaluación formativa utiliza los mismos métodos que la evaluación de procesos, pero se diferencia en que los datos se retroalimentan al equipo de implementación o al personal del sistema objetivo durante el estudio para adaptar y mejorar el proceso de implementación a lo largo del protocolo. La evaluación formativa es conceptualmente similar al monitoreo de fidelidad que se realiza como parte de cualquier ensayo clínico tradicional, pero se diferencia en que se especifica a priori en una hipótesis de estudio o pregunta de investigación.

Una versión cuantitativa de la evaluación formativa en ensayos clínicos es el uso de ensayos aleatorizados de asignación múltiple secuencial (SMART) o diseños de intervención adaptativa, que se utilizan para aumentar o cambiar los tratamientos en puntos de decisión críticos donde hay evidencia de falta de respuesta inicial [ 32 , 33 ]. Como se analiza más adelante, el uso de la evaluación formativa tiene implicaciones para la validez de los ensayos controlados, que pueden diferir entre los ensayos clínicos y los de implementación.

La evaluación sumativa es una recopilación, al final del estudio, del impacto de la estrategia de implementación. Las medidas de evaluación sumativa suelen evaluar los impactos en los procesos de atención (por ejemplo, mayor uso o calidad de la práctica basada en la evidencia dirigida). Otro componente común de la evaluación sumativa es caracterizar el impacto económico de una estrategia de implementación y sus efectos. Los estudios de implementación generalmente no emplean análisis formales de costo-efectividad, sino que realizan análisis de impacto empresarial focalizados [ 34 ]. Dichos análisis se centran en estimar las consecuencias financieras de la adopción de una práctica clínica dentro de un entorno o sistema de atención médica específico. Por lo general, esto incluye los costos para el sistema asociados tanto con la estrategia de implementación como con la utilización de la práctica basada en la evidencia.

Tipos de datos de evaluación

Los datos para la evaluación formativa, de proceso o sumativa pueden provenir de diversas fuentes e incluir datos cuantitativos, cualitativos o ambos. Estos datos pueden recopilarse en distintos niveles de observación, como pacientes, proveedores, sistemas y factores ambientales más amplios, como la comunidad, las políticas o los indicadores económicos.

Las medidas cuantitativas comunes incluyen encuestas estructuradas y herramientas que evalúan, por ejemplo, el contexto organizacional, las actitudes y comportamientos de los proveedores o la receptividad de los pacientes al cambio. Los datos administrativos se utilizan con frecuencia, ya sea en poblaciones objetivo específicas o a nivel del sistema en general, para caracterizar, por ejemplo, los niveles iniciales y los cambios en las tasas de utilización de prácticas particulares. Las medidas de fidelidad a la práctica basada en la evidencia suelen ser componentes centrales del plan de evaluación, y pueden ser cuantitativas, cualitativas o ambas.

Los métodos comunes de recopilación de datos cualitativos incluyen entrevistas semiestructuradas con pacientes, proveedores u otras partes interesadas; grupos focales; observación directa de procesos clínicos; y revisión de documentos. La recopilación y el análisis de datos cualitativos pueden estructurarse como una exploración sin hipótesis utilizando la teoría fundamentada o enfoques relacionados [ 35 ] o pueden utilizar el análisis de contenido dirigido [ 36 ] para abordar cuestiones preespecificadas como la comprobación de hipótesis o la medición de la fidelidad de la intervención. La mayoría de los procesos de evaluación de la implementación incluyen medidas cualitativas y cuantitativas mixtas, y requieren una atención cuidadosa en el diseño del estudio a las diversas formas de combinar dichos datos [ 37 ].

El papel de la teoría y su vínculo con decisiones de diseño específicas.

La necesidad de una implementación basada en la teoría

Describir, implementar y luego mantener cualquier innovación es una tarea compleja [ 38 ], compleja porque las estrategias de implementación (a) suelen ser multicomponentes y (b) deben adaptarse a los contextos locales. Los contextos en los que se realizan los esfuerzos de implementación son complejos debido a los múltiples niveles de interacción (p. ej., pacientes, proveedores, equipos, unidades de servicio), con una amplia variación de un entorno a otro [ 39 ]. Sin una comprensión profunda del contexto, una PBE puede no ser adoptada o puede ser adoptada de forma adaptada con fidelidad comprometida debido a las presiones contextuales. El esfuerzo requiere un uso claro, colectivo y consistente de la teoría para construir conocimiento sobre qué funciona, dónde y por qué [ 40 ].

Teorías, modelos y marcos conceptuales

Los términos teoría , modelo y marco se utilizan, lamentablemente, a menudo de forma intercambiable e imprecisa. En este artículo, el término teoría se refiere a cualquier propuesta sobre relaciones significativas entre constructos (variables) o sobre cómo un mecanismo o constructo puede modificar el comportamiento de otro constructo o resultado [ 41 , 42 ].

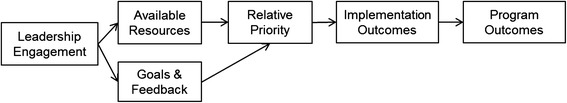

Una teoría puede operacionalizarse dentro de un modelo , que es una representación simplificada de un mundo más complejo con supuestos relativamente precisos sobre causa y efecto. Por ejemplo, el modelo de la Figura 1 representa una única vía hipotética de cambio para la implementación de un programa de control de peso [ 43 , 44 ]. Este modelo plantea la hipótesis de que el compromiso del liderazgo dará como resultado recursos suficientes para la implementación y que los líderes articularán objetivos de implementación que se alineen con las prioridades organizacionales. Estas acciones de liderazgo sirven para elevar la percepción de prioridad dentro de la organización, lo que a su vez conduce a resultados de implementación positivos (por ejemplo, alta fidelidad del programa a su diseño previsto) y, por lo tanto, a una mejor pérdida de peso para los pacientes. Cada constructo del modelo puede evaluarse y el modelo puede someterse a prueba para confirmar o refutar esta vía de cambio. Con base en los resultados, el modelo puede requerir refinamiento o ser rechazado por completo.

Los marcos proporcionan un amplio conjunto de constructos que organizan conceptos y datos de forma descriptiva sin especificar relaciones causales. También pueden proporcionar una serie de pasos prescriptivos que resumen cómo debería planificarse y llevarse a cabo la implementación idealmente [ 13 , 45 ]. Por ejemplo, el Marco Consolidado para la Investigación de la Implementación (CFIR, [ 46 ]) clasifica 39 constructos de implementación en cinco dominios considerados moderadores o mediadores influyentes de los resultados de la implementación, proporcionando una estructura para evaluar sistemáticamente el contexto en el que se produce la implementación [ 47 ]. Idealmente, los investigadores también volverán y utilizarán datos empíricos para evaluar la utilidad de las teorías, modelos o marcos que guiaron el diseño del estudio y ofrecerán recomendaciones para mejorarlos [ 48 ]. El uso consistente de constructos en diferentes estudios permite además síntesis más eficientes mediante el uso de, por ejemplo, técnicas de análisis comparativos cualitativos [ 49 ]. La operacionalización explícita de constructos teóricos también puede guiar el desarrollo de medidas cuantitativas robustas [ 50 , 51 ].

Ejemplo: utilizar un marco de trabajo para guiar la recopilación y el análisis de datos.

Un ejemplo ilustrará el papel de estos marcos. Damschroder y Lowery realizaron una evaluación de un programa de control de peso en la USVA, financiado por el programa QUERI descrito anteriormente [ 43 , 44 ]. Hubo una amplia variación en la implementación del programa 1,5 años después de su difusión inicial. Se utilizó el CFIR para desarrollar una guía para entrevistar al personal de las instalaciones locales y comprender qué contribuía a esta variación. Se aplicaron calificaciones cuantitativas a los datos de las entrevistas codificadas cualitativamente [ 36 ] y se utilizaron para identificar constructos que distinguían entre los sitios con mejores y peores resultados de implementación. Se encontraron diez constructos relacionados con una implementación exitosa. Por ejemplo, los sitios con los peores resultados de implementación tenían calificaciones más bajas para «Objetivos y retroalimentación» porque el personal de estos sitios no tenía el tiempo ni las habilidades para identificar los objetivos del programa o monitorear el progreso hacia esos objetivos. Esta información se puede utilizar para desarrollar modelos más específicos que guíen futuras implementaciones e identifiquen estrategias de implementación discretas (por ejemplo, auditoría-retroalimentación [ 52 ], identificación de promotores [ 53 ]).

Ensayos de implementación controlados

Tipos de ensayos de implementación controlados

Muchos estudios de implementación buscan identificar barreras y facilitadores de la adopción de la PBE en condiciones naturales. Sin embargo, otros estudios buscan mejorar la adopción de la PBE empleando estrategias de implementación específicas en ensayos controlados. Los diseños de ensayos de implementación controlados son de dos tipos principales: grupos paralelos y series temporales interrumpidas. Los diseños de grupos paralelos son aleatorizados y prospectivos, similares a otros tipos de servicios de salud o ensayos clínicos. La unidad de aleatorización depende de la estrategia y el resultado de interés, y puede ser el paciente, el proveedor, la clínica, el centro o el sistema. Algunos diseños creativos responden a las limitaciones del mundo real combinando características de estudios de control históricos con una verdadera aleatorización emparejada [ 28 ]. Se han empleado diseños innovadores adicionales, como los diseños de cuña escalonada en los que todos los sitios participantes reciben apoyo para la implementación, aunque escalonado en el tiempo [ 54 , 55 ], que se asemejan a los diseños de bloques incompletos tradicionales. Además, los ensayos de implementación controlados a veces aleatorizan un pequeño número de sitios y miden los resultados a nivel de paciente individual, utilizando análisis anidados multivariados [ 56 ]. Finalmente, los diseños de aleatorización SMART, como se mencionó anteriormente [ 32 ], pueden aportar un grado adicional de rigor al uso de la evaluación formativa dentro del estudio.

En el mundo real de la implementación de políticas y los cambios de programas, los diseños de grupos paralelos pueden no ser factibles por razones pragmáticas, políticas o éticas. En tales situaciones, se pueden utilizar diseños de series temporales interrumpidas . Estos también se asemejan a sus contrapartes en los servicios de salud y los ensayos clínicos, idealmente con el resultado de implementación de interés medido en múltiples momentos antes y después de un esfuerzo de implementación. Dichos diseños son más factibles cuando la estrategia de implementación es un evento discreto, como un cambio de política [ 57 ], ya que las estrategias de implementación más típicas ejercen su efecto durante meses, lo que hace que la «interrupción» en la serie temporal sea más difícil de determinar.

Implementación frente a servicios de salud tradicionales y ensayos clínicos

Los ensayos de implementación controlados se diferencian de otros tipos de servicios de salud y ensayos clínicos en dos aspectos principales. En primer lugar, y como se mencionó anteriormente, se centran en el impacto de la estrategia de implementación en el uso de una práctica basada en la evidencia (PBE), en lugar del impacto en la salud de la PBE en sí misma. En segundo lugar, adoptan un enfoque de validez fundamentalmente diferente, como se ilustra a continuación.

Consideremos un ensayo hipotético de entrevista motivacional ( EM ) para trastornos por consumo de sustancias en la población sin hogar (Tabla 3 ). Los diseños de implementación difieren de los ensayos de intervención en un nivel básico: el de la hipótesis . Mientras que los ensayos de intervención se centran en comparar la intervención con un grupo de comparación, los ensayos de implementación se centran en la capacidad del equipo de investigación para aumentar la adopción de la EM. Si bien la población y el entorno pueden ser similares a los de los ensayos de efectividad, la unidad de observación en los ensayos de implementación pueden ser los proveedores o las clínicas, según el enfoque de los esfuerzos de implementación. A medida que la población se vuelve más heterogénea, las medidas de resultado deben ser más breves y sencillas para minimizar la carga de los participantes y retener en el protocolo a los sujetos menos tolerantes a la investigación. A medida que se avanza de izquierda a derecha en la Tabla 3 , los clínicos de intervención se vuelven progresivamente menos especializados y los esfuerzos de desarrollo de habilidades se asemejan más a la capacitación que normalmente sería factible en condiciones clínicas; la medición de la fidelidad a la intervención varía de manera similar.

Tabla 3.

Perspectivas del diseño de ensayos de intervención frente a ensayos de implementación: un ejemplo hipotético del uso de la entrevista motivacional (EM) para los trastornos por consumo de sustancias en la población sin hogar.

| Principios de diseño de eficacia | Principios de diseño para la eficacia | Principios de diseño para la implementación | |

|---|---|---|---|

| Hipótesis | MI supera el control | MI supera el control | La MI será adoptada y mantenida. |

| Población y entorno | Excluir psicosis, trastorno bipolar, ansiedad; cualquier entorno con pacientes cooperativos. | Incluye la mayoría de las comorbilidades; el entorno típico son los centros de práctica no especializados. | La unidad de observación puede ser pacientes, proveedores o clínicas; el entorno típico son los centros de práctica no especializados. |

| Medidas de resultados | Resultados de salud, muchos: «por si acaso…» | Resultados de salud, breves y concisos. | Hacer hincapié en las medidas de adopción de la inteligencia múltiple. |

| Intervención: médicos | Doctores en Filosofía y Trabajadores Sociales con Maestría contratados y capacitados por el investigador principal. | Se contrató a consejeros especializados en adicciones como personal de estudio. | Consejeros de adicciones endógenas |

| Intervención: fidelidad | Entrenado según criterios específicos, grabado en audio para garantizar la fidelidad. | Capacitado según criterios, monitoreo de tipo QI como en el sistema clínico. | La evaluación formativa es el foco |

| Contexto | Asegúrese de que el ensayo sea un éxito, cueste lo que cueste. | Trabajar en condiciones “típicas” | Mantener las condiciones típicas |

| Apoyo a la investigación | Gestión de casos de criptomonedas | Apoyo a la investigación, pero con «cortafuegos». | El apoyo a la investigación es limitado; por ejemplo, solo para formación. |

| Énfasis en la validez | Interno > > externo | Externo > interno | Planificar la optimización del protocolo en tiempo real mediante evaluación formativa, en contra de las consideraciones “tradicionales” de validez interna, documentando sistemáticamente las adaptaciones. |

La consideración del contexto de la investigación también difiere sustancialmente. Los ensayos de eficacia valoran la realización de un ensayo invariable de principio a fin. Esto implica, en ocasiones, esfuerzos extraordinarios en la formación de clínicos y el seguimiento de los participantes, de modo que los esfuerzos del equipo de investigación se reducen a veces a una gestión de casos compleja, lo cual no supone un problema, ya que el objetivo del ensayo es únicamente probar la intervención en condiciones óptimas. Sin embargo, dado que los estudios de efectividad se centran más en el desempeño de una intervención eficaz en entornos reales, se presta especial atención a limitar la cantidad de recursos financiados por la investigación que se incorporan al protocolo, a menudo restringiendo dichos recursos con parámetros definidos de forma precisa y explícita (p. ej., 8). Además, en los ensayos de implementación, intentar optimizar el contexto natural en el que se mide la adopción supone una amenaza para la validez del ensayo. Por lo tanto, la participación del investigador en el lugar de adopción se limita drásticamente, e incluso algunos ensayos de implementación restringen el apoyo a la investigación a la formación de clínicos locales y al uso de evaluaciones de resultados remotas y sencillas para pacientes y proveedores.

Estas diferencias se deben a prioridades radicalmente distintas respecto a la validez del ensayo [ 58 ]. La validez interna prioriza establecer una conexión causal entre la intervención y el resultado; para lograr este objetivo, la muestra, las mediciones de resultados y la intervención se controlan rigurosamente sin considerar su aplicabilidad a otros contextos ajenos al ensayo. La validez externa prioriza la generalización de los resultados del ensayo a otras poblaciones y situaciones relevantes. Si bien los estudios de eficacia valoran la validez interna sobre la externa, el equilibrio cambia en los estudios de efectividad: aunque el ensayo de efectividad debe tener suficiente validez interna para llevarse a cabo con éxito, se toman decisiones de diseño explícitas que valoran la generalización más allá del ensayo.

Finalmente, los ensayos de implementación, a diferencia de ambos tipos de ensayos de intervención, buscan alcanzar la estrategia de implementación óptima y el máximo impacto de la práctica basada en la evidencia (PBE) al final del estudio, en lugar de aislar mecanismos específicos. Cabe señalar, sin embargo, que de manera sutil esto se aplica a todos los tipos de estudios, incluidos los ensayos de eficacia, en los que se recopilan diligentemente datos de fidelidad de la intervención a lo largo del estudio y se realizan ajustes en la capacitación e incluso en el personal para garantizar la validez interna. La diferencia con los ensayos de implementación es que dichas modificaciones se planifican mediante la evaluación formativa y, a menudo, se plantean hipótesis específicas al respecto [ 31 ].

Diseños de ensayos híbridos de efectividad e implementación

Aunque un protocolo de investigación de implementación puede demostrar mejoras en la adopción de prácticas basadas en la evidencia (PBE), el impacto de dichas prácticas en los resultados de salud no ha sido tradicionalmente una preocupación de la ciencia de la implementación. Sin embargo, muchos estudios demuestran que la suposición de que la mejora de los procesos implica una mejora en los resultados de salud es errónea [ 59 , 60 ]. Además, incluso si las PBE se implementan según lo previsto con la fidelidad adecuada, puede haber una disminución en su efectividad cuando una PBE pasa del entorno de los ensayos clínicos de efectividad a la implementación en la práctica clínica real. Asimismo, es importante conocer el grado en que una PBE, al utilizarse en la práctica clínica general, conserva los mecanismos activos al tiempo que se adapta a las necesidades y prioridades locales [ 61 , 62 ].

Conscientes de estas necesidades, un grupo de investigadores de implementación y ensayos clínicos codificó el concepto de diseños híbridos de efectividad e implementación [ 63 ]. El término correcto es «codificar», en lugar de «desarrollar», ya que todos los conceptos y metodologías involucrados en los diseños híbridos ya existían en campos científicos a menudo dispares; el propósito del documento conceptual del diseño híbrido era reunir esos conceptos y metodologías en un marco único y explorar la utilidad de dicho marco para las necesidades de los investigadores del mundo real y las partes interesadas en la salud pública. En pocos años, este marco ha comenzado a ser adoptado por investigadores y financiadores [ 64 ].

Los diseños de investigación híbridos se definen como diseños de ensayos que adoptan un doble enfoque a priori para evaluar tanto la efectividad de la estrategia de implementación en la mejora del uso de la PBE como el impacto en la salud de la PBE [ 63 ]. Por lo tanto, los diseños híbridos plantean hipótesis sobre la PBE y los efectos de la implementación, midiendo típicamente tanto los procesos de atención médica (resultados de la implementación) como el estado de salud (resultados de la intervención). No todos los diseños híbridos aplican metodologías de ensayos controlados a ambos aspectos del resultado simultáneamente, pero todos incorporan a priori la evaluación de ambos dominios explícitamente durante el desarrollo del diseño de investigación. Hay tres tipos de diseños híbridos.

Los diseños híbridos de tipo I evalúan el impacto en la salud de una práctica basada en la evidencia (PBE) al tiempo que recopilan datos explícitos sobre el proceso de implementación para facilitar los esfuerzos de implementación posteriores. Estos diseños se suelen utilizar como paso previo a un ensayo de implementación. Algunos defensores afirman que todos los ensayos de efectividad deberían ser híbridos de tipo I.

Los diseños híbridos de tipo III evalúan la capacidad de una estrategia de implementación para mejorar el uso de una práctica basada en la evidencia (PBE) mientras se recopilan datos sobre el impacto de la PBE en la salud durante su implementación. Estos diseños son útiles cuando la efectividad de una intervención está bien establecida, pero no está claro cuán robustos serán sus efectos en condiciones de implementación. Algunos defensores afirman que todos los ensayos de implementación que involucren procesos para mejorar los resultados de salud deberían ser híbridos de tipo III.

Los diseños híbridos de tipo II son una combinación de diseños híbridos: evalúan tanto los efectos de la práctica basada en la evidencia (PBE) en los resultados de salud como los efectos de la estrategia de implementación en el uso de la PBE. Estos diseños se utilizan cuando existe un impulso significativo en la implementación dentro de un sistema clínico, pero los datos sobre la efectividad de la intervención son menos extensos o solo indirectos. Por lo tanto, tanto el impacto de la estrategia de implementación en el uso de la PBE como el impacto de la PBE en el estado de salud constituyen el doble enfoque de los diseños híbridos de tipo II.

Dos ejemplos de estudios de implementación en el mundo real

Una breve descripción de dos proyectos de USVA QUERI ilustrará algunos de los conceptos tratados en esta revisión.

Incentivos en trastornos por consumo de sustancias (Ilustración de un diseño híbrido de tipo I)

El primer ejemplo [ 65 , 66 ] es un ensayo de efectividad con un componente de implementación observacional totalmente integrado en su diseño (Tipo I híbrido). La razón para agregar el componente de implementación a este ensayo fue que si la intervención demostraba ser efectiva, la información sobre las estrategias más factibles para la implementación y las barreras más significativas que probablemente se encontrarían ya estarían recopiladas, informando los esfuerzos de implementación futuros. Como los métodos de la parte del estudio del ensayo de efectividad controlado y aleatorizado son estándar y familiares para la mayoría de los investigadores (ver también la Tabla 3 ), esta descripción se centrará en la evaluación del proceso. La evaluación del proceso fue guiada por dos marcos. RE-AIM [ 67 ] guió al investigador para examinar el alcance , la efectividad, la adopción, la implementación y el mantenimiento de la intervención, planteando preguntas como cuántos pacientes estarán interesados en recibir la intervención, qué información requerirá una clínica para considerar la adopción de la intervención, qué capacitación, herramientas y/o recursos requerirá la clínica para implementar la intervención propuesta con alta fidelidad y qué recursos se requerirán para que la clínica mantenga la intervención a largo plazo. De manera complementaria, el marco PARIHS ( Promoting Action on Research Implementation in Health Services [ 68 ] ; revisado recientemente [ 69 ]) propone que la implementación exitosa es una función de la solidez de la evidencia que respalda la intervención, el contexto en el que se implementa la intervención y la facilitación proporcionada para respaldar la implementación. Estos constructos guiaron a los investigadores para determinar cómo perciben los profesionales la base de evidencia de la intervención, qué características del contexto impidieron o facilitaron la implementación y qué herramientas y apoyos facilitaron el abordaje de las barreras identificadas.

La evaluación del proceso para este estudio combinó múltiples herramientas y estrategias de recolección de datos con el fin de identificar las principales barreras y facilitadores relacionados con cada uno de estos constructos. Las herramientas de recolección de datos incluyeron datos administrativos, encuestas a pacientes, encuestas y entrevistas al personal, entrevistas con el liderazgo de la clínica y datos de seguimiento de costos. La información de estas múltiples fuentes permitió identificar las principales barreras y facilitadores que probablemente se encuentren en cualquier esfuerzo por implementar la intervención de incentivos en otras clínicas y permitió la creación de estrategias de implementación recomendadas (Tabla 4 ).

Tabla 4.

Mejora de la implementación de la terapia de incentivos para los trastornos por consumo de sustancias guiada por los marcos RE-AIM y PARIHS (Sección VI.A)

| Marco RE-AIM [ 67 ] | |

|---|---|

| Alcanzar | • Dirigir la intervención a los pacientes que asistirán a tratamiento al menos dos veces por semana para otros servicios de tratamiento. |

| Adopción | • Solicitar el apoyo explícito de los niveles más altos de la organización, por ejemplo, mediante indicadores de desempeño o recomendaciones de tratamiento. |

| • Identificar o crear indicadores de la eficacia de la clínica que puedan utilizarse para identificar deficiencias en el desempeño y monitorear el impacto de la implementación. | |

| • Solicitar la aprobación previa para la financiación designada. | |

| • Capacitar a los líderes sobre posibles estrategias para integrar la intervención en las prácticas actuales. | |

| • Adopción gradual. Comience con un programa de tratamiento o clínica específicos para reducir la carga de personal y financiación hasta que se disponga de evidencia local de eficacia y viabilidad que respalde su difusión. | |

| Implementación | • Capacitar al personal sobre los recipientes para análisis de orina y el alcoholímetro, incluyendo la sensibilidad y la especificidad de los resultados de la prueba. |

| • Proporcionar guiones para comunicar a los pacientes los resultados positivos y negativos de las pruebas. | |

| • Proporcionar una base de datos de seguimiento para garantizar la coherencia en la asignación de los premios. | |

| • Proporcionar un protocolo de cita de intervención paso a paso. | |

| • Facilitar la documentación en la historia clínica electrónica. | |

| Mantenimiento | • Asegúrese de que todo el personal conozca sus responsabilidades en relación con la incorporación de la información de la intervención en las interacciones clínicas con los pacientes para facilitar su integración en la clínica. |

| • Considere la opción de que los gestores de casos administren la intervención a sus propios pacientes en lugar de que una o dos personas sean responsables de la intervención. | |

| Marco PARIHS [ 68 , 69 ] | |

| Evidencia | • Es posible que el personal no esté al tanto de la solidez de la evidencia o que exprese desacuerdos filosóficos con las intervenciones de incentivos: involucre al personal desde el principio para comprender y abordar sus inquietudes. |

| • Es posible que el personal necesite formación sobre la evidencia y/o sobre cómo funcionan los refuerzos conductuales en diversos entornos. | |

| • El personal podría beneficiarse al colaborar con clínicas que ya hayan implementado la intervención o que estén dispuestas a participar en una breve prueba de la misma. | |

| Contexto | • Incluso en contextos que ofrecen un gran apoyo, existen barreras importantes y la implementación tiene una alta probabilidad de fracasar si dichas barreras no se identifican y abordan desde el principio. |

Implementación de la farmacoterapia para los trastornos por consumo de alcohol (ejemplo de evaluación formativa)

El segundo ejemplo es un ensayo de implementación en curso que utiliza técnicas de evaluación formativa para refinar y probar una estrategia de implementación basada en la teoría para aumentar el acceso a la farmacoterapia para el trastorno por consumo de alcohol en entornos de atención primaria. La justificación para incluir la evaluación formativa fue que, por muy cuidadosamente que se planifique una estrategia de implementación con antelación, la experiencia de la implementación real genera conocimientos que pueden utilizarse para mejorar aún más la estrategia. El desarrollo de la estrategia inicial se basó en trabajos previos de QUERI formativa, así como en la Teoría del Comportamiento Planificado [ 70 ]. Entrevistas cualitativas previas con proveedores habían documentado: (1) falta de confianza de los proveedores en la eficacia de la medicación, (2) falta de habilidades y conocimientos de los proveedores sobre el uso de los medicamentos, y (3) percepción de baja demanda por parte de los pacientes como las tres principales barreras para la implementación. Este trabajo sugirió que las intervenciones de implementación tendrían que centrarse no solo en la educación, sino también en el «marketing», y que las intervenciones tendrían que centrarse no solo en los proveedores, sino también en los pacientes.

La Teoría del Comportamiento Planificado se utilizó como teoría guía porque el cambio de comportamiento deseado se produce principalmente a nivel individual, por ejemplo, convencer a los proveedores y pacientes de que consideren la farmacoterapia como una opción de intervención viable para los trastornos por consumo de alcohol. La Teoría del Comportamiento Planificado establece que las intenciones conductuales están guiadas por las actitudes hacia el comportamiento, las normas subjetivas de los pares y el control conductual percibido, y se seleccionaron intervenciones de implementación para abordar cada uno de estos constructos. Las estrategias de implementación seleccionadas para los proveedores incluyen marketing social, acceso a consultores expertos pares, retroalimentación sobre las tasas de prescripción y herramientas de educación y apoyo a la toma de decisiones. Se seleccionaron envíos postales directos al consumidor como intervención para abordar la falta de conocimiento de los pacientes sobre las opciones de medicación y las posibles actitudes negativas de los pares hacia el tratamiento farmacológico del trastorno por consumo de alcohol, y para alentar a los pacientes a hablar sobre el consumo de alcohol con su médico de atención primaria. La estrategia de implementación se está evaluando utilizando un diseño de series temporales interrumpidas con controles. Se están monitoreando las tasas de prescripción durante las fases de preimplementación, implementación y postimplementación de 9 meses para los centros de intervención y los centros de control emparejados. Ya en el estudio, la evaluación formativa ha llevado a perfeccionamientos de la estrategia de implementación (Tabla 5 ).

Tabla 5.

Evaluación formativa del desarrollo: El ejemplo de la farmacoterapia para los trastornos por consumo de alcohol (Sección VI.B)

| Principales obstáculos identificados (cita de ejemplo) | Perfeccionamientos de la implementación resultantes |

|---|---|

| Falta de tiempo: “No tengo tiempo para esto. Los pacientes no vienen pidiendo hablar sobre su consumo de alcohol. Con suerte, tendría 5 minutos para discutirlo”. | • Condensar los materiales educativos. |

| • Poner los materiales a disposición a través del enlace que el proveedor de registros informatizados ya tendrá abierto. | |

| • Presentamos investigaciones que demuestran que las conversaciones breves pueden reducir el consumo de alcohol por parte de los pacientes. | |

| No consideren que el sistema actual sea problemático: “El sistema funciona bien tal como está. Tenemos excelentes especialistas en trastornos por consumo de sustancias a quienes podemos derivarlos”. | • Datos que demuestren que la mayoría de los pacientes no siguen las indicaciones médicas. |

| • Educación desde la perspectiva del paciente: Los pacientes que no se sienten cómodos acudiendo a una clínica de «adicciones» o de «salud mental» pueden abordar el consumo de alcohol como parte de un plan general para mejorar su salud. | |

| Percepción de falta de interés por parte de los pacientes: “Los pacientes no estarán contentos conmigo si saco el tema. No quieren hablar de ello”. | • Presentar los resultados de la entrevista con el paciente: Los pacientes desean más información y la aceptarían de su médico de atención primaria. |

| Falta de competencia: “Nunca me capacitaron para tratar adicciones. Esto no entra dentro de mis competencias”. | • Formación integral y asesoramiento por parte de especialistas pares. |

| • Destacar el impacto del consumo de alcohol en las principales enfermedades que luchan por controlar a diario. |

Resumen

Los entornos sanitarios en todo el mundo son cada vez más dinámicos, con recursos limitados e interconectados, y están condicionados por entornos políticos y económicos igualmente complejos. Por consiguiente, maximizar el valor de la atención sanitaria [ 19 ] se ha convertido en un imperativo político a nivel mundial. Las ciencias de la salud deben evolucionar en paralelo para satisfacer esta necesidad.

Con este fin, la ciencia de la implementación se está convirtiendo en una herramienta fundamental para promover lo que el Instituto de Medicina de los Estados Unidos ha denominado el “Sistema de Atención Médica de Aprendizaje”. El sistema de atención médica de aprendizaje puede definirse como un sistema de atención médica que emplea un conjunto de procesos continuos para proporcionar una atención médica de mayor valor a través de la revisión sistemática de análisis de datos de atención médica y la aplicación de dichos datos para informar la promoción de estrategias generales y esfuerzos de mejora específicos [ 71 , 72 ].

Hasta la fecha, la mayor parte de la atención en los sistemas de aprendizaje de la atención médica se ha centrado en la adquisición y el análisis de grandes conjuntos de datos recopilados de prácticas clínicas reales en tiempo casi real [ 73 ]. Sin embargo, dicha recopilación de datos representa solo el componente inicial de la organización de aprendizaje de la atención médica. Los sistemas de atención médica también necesitan actuar sobre estos datos para mejorar la práctica. La ciencia de la implementación proporciona un conjunto sistemático de principios y métodos para lograrlo.

El comportamiento de los proveedores y del sistema no cambia por sí solo, y las intervenciones unimodales no suelen producir cambios efectivos o duraderos en sistemas tan complejos como el de la atención médica [ 39 ]. Sin una atención concertada a las estrategias de implementación basadas en la evidencia, los sistemas de atención médica que aprenden corren el riesgo de desarrollar repositorios de información masivos y costosos sin estrategias adecuadas para utilizar realmente esos datos para el cambio del sistema. Al igual que con las suposiciones anteriores de que la mera publicación de los resultados de un ensayo de eficacia o efectividad conduciría a la adopción automática de la práctica basada en la evidencia, la suposición de que los conjuntos de datos completos, elegantes y en tiempo real conducirán, por sí solos, a un cambio en la práctica es, en el mejor de los casos, una aspiración optimista y, en el peor, un error sumamente costoso.

Más bien, para que los sistemas de atención médica basados en el aprendizaje cumplan con sus promesas, es necesario combinar sistemas sofisticados de recopilación de datos con estrategias de implementación igualmente sofisticadas. La ciencia emergente de la implementación proporciona un enfoque sistematizado para identificar y abordar las barreras y los facilitadores del cambio sistémico, y por lo tanto representa un componente fundamental de cualquier sistema de atención médica basado en el aprendizaje.